目录

2.2.2.手动安装 Kubeflow Manifests 16

3.1.1.1.Kubeflow 用户界面(UI)概述 23

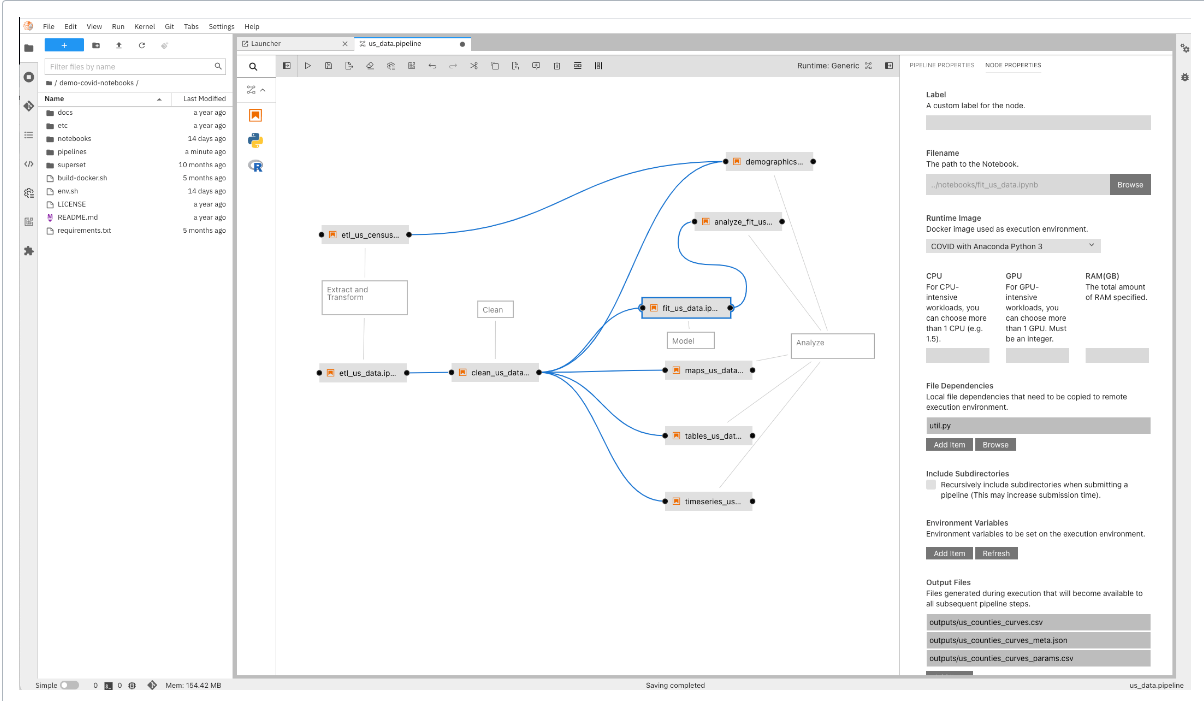

3.2.4.Jupyter TensorFlow 实例 37

3.3.1.Kubeflow Pipelines v1 Documentation 40

3.3.1.1.6.Kubeflow Pipelines UI 上的管道输入数据 44

3.3.1.2.1.1.部署 Kubeflow 并打开 Kubeflow Pipelines UI 48

3.3.1.3.2.3.集装箱化组件(Containerizing components) 62

3.3.1.3.5.运行和定期运行(Run and Recurring Run) 63

3.3.1.3.6.运行触发器(Run Trigger) 63

3.1.4.1.3.1.2.Kubeflow 独立管道 65

3.3.1.4.1.3.2.部署 Kubeflow 管道 73

3.3.1.4.1.3.3.升级 Kubeflow 管道 74

3.3.1.4.1.3.4.自定义 Kubeflow 管道 75

3.3.1.4.1.3.5.卸载 Kubeflow 管道 76

为 Docker Executor 准备 GKE 集群 78

3.3.1.5.1.2.Kubeflow Pipelines CLI 工具 82

3.3.1.5.1.5.安装 Kubeflow Pipelines SDK 83

3.3.1.5.1.6.将 Pipelines SDK 连接到 Kubeflow Pipelines 85

3.3.1.5.1.10.构建基于 Python 函数的组件 100

3.4.2.4.3.7.Parzen 估计树(TPE) 118

3.4.2.4.3.9.协方差矩阵自适应进化策略(CMA-ES) 119

3.4.2.4.3.10.Sobol 的 Quasirandom 序列 119

3.4.2.4.3.11.基于 ENAS 的神经结构搜索 120

3.4.2.4.3.12.可区分体系结构搜索(DARTS) 121

3.4.5.1.3.使用自定义 Kubernetes 资源作为试用模板 130

3.4.9.1.TensorFlow Training (TFJob) 138

3.4.9.1.2.安装 TensorFlow 运算符 141

验证 Kubeflow 部署中是否包含 TFJob 支持 141

3.4.9.1.8.tfReplicaStatus(tf 复制状态) 146

3.4.9.1.11.GKE 上的 Stackdriver 149

3.4.9.1.12.Troubleshooting 150

3.4.9.2.PaddlePaddle Training (PaddleJob) 151

验证 Kubeflow 部署中是否包含 PaddleJob 支持 151

3.4.9.3.PyTorch Training (PyTorchJob) 154

3.4.9.3.1.1.验证 Kubeflow 部署中是否包含 PyTorchJob 支持 154

3.4.9.4.MXNet Training (MXJob) 157

验证您的 Kubeflow 部署中是否包含 MXJob 支持 157

3.4.9.4.XGBoost 训练 (XGBoostJob) 162

3.4.9.4.2.验证 Kubeflow 部署中是否包含 XGBoost 支持 162

3.4.9.5.MPI Training (MPIJob) 165

3.4.9.6.2.关于火山调度程序和帮派调度(About volcano scheduler and gang-scheduling) 171

前提条件:授予用户最少的 Kubernetes 集群访问权限 176

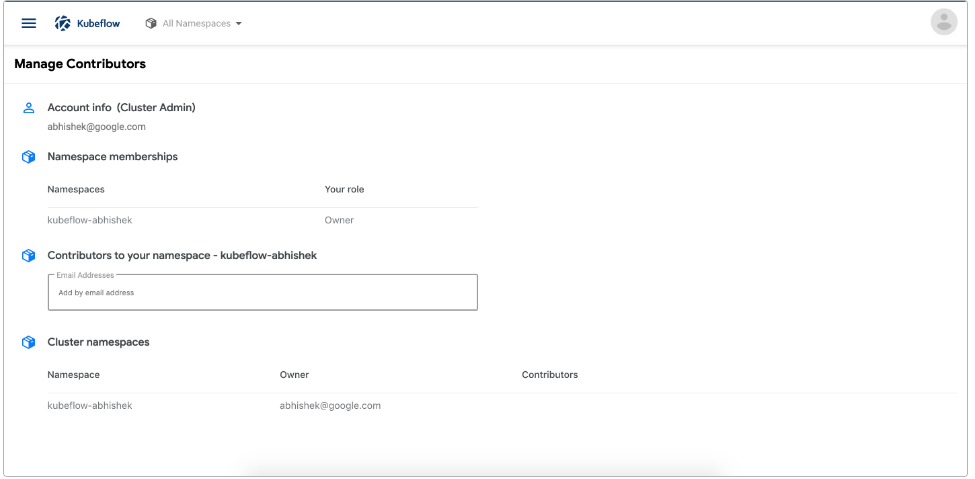

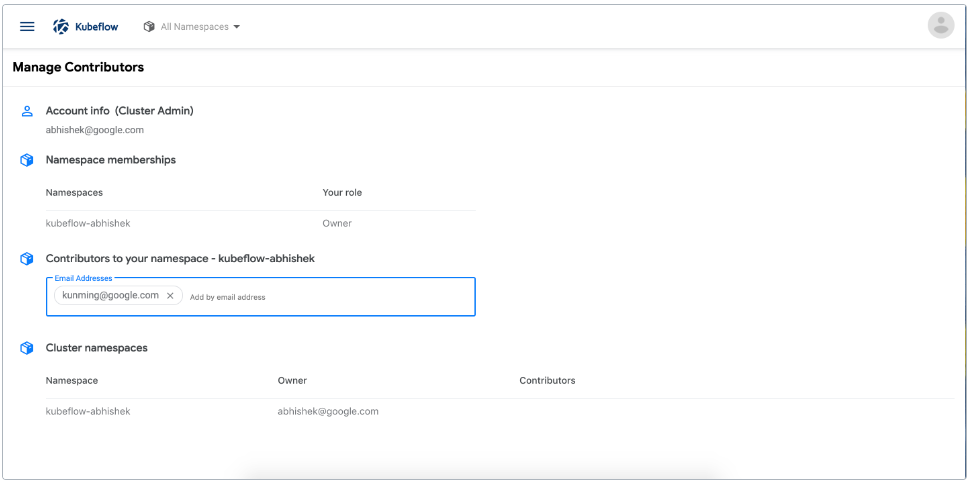

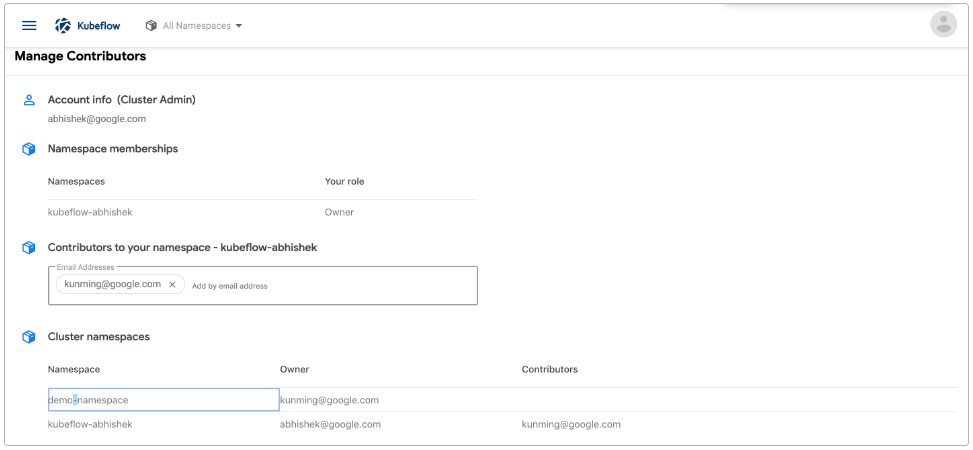

3.4.10.3.9.通过 Kubeflow UI 管理贡献者 180

# 1.Kubeflow 简介

Kubeflow 项目致力于使机器学习(ML)工作流在 Kubernetes 上的部署变得简单、可移植和可扩展。我们的目标不是重新创建其他服务,而是提供一种直接的方式,将最佳的 ML 开源系统部署到不同的基础设施中。无论您在哪里运行 Kubernetes,都应该能够运行 Kuberlow。

# 1.1.Kubeflow 入门

阅读体系结构概述,了解 Kubeflow 的体系结构介绍,并了解如何使用 Kubeflow 管理 ML 工作流。

按照 Installing Kubeflow 设置环境并安装 Kubeflow。

观看以下视频,其中介绍了库贝洛。

# 1.2.Kubeflow 是什么?

Kubeflow 是 Kubernetes 的机器学习工具包。要使用 Kubeflow,基本工作流程是:

- 下载并运行 Kubeflow 部署二进制文件。

- 自定义生成的配置文件。

- 运行指定的脚本将容器部署到特定环境。

您可以调整配置以选择要用于 ML 工作流每个阶段的平台和服务:

- 数据准备

- 模型训练,

- 预测服务

- 服务管理

您可以选择在本地、本地或云环境中部署 Kubernetes 工作负载。

# 1.3.Kubeflow 的使命

我们的目标是通过让 Kubernetes 做它擅长的事情,尽可能简单地扩展机器学习(ML)模型并将其部署到生产环境中:

- 在不同的基础架构上进行简单、可重复、可移植的部署(例如,在笔记本电脑上进行实验,然后移动到本地集群或云)

- 部署和管理松散耦合的微服务

- 根据需求进行扩展

因为 ML 从业者使用了一组不同的工具,所以关键目标之一是根据用户需求(在合理范围内)定制堆栈,并让系统处理“无聊的东西”。虽然我们从一系列的技术开始,但我们正在与许多不同的项目合作,以包括更多的工具。

最终,我们希望有一组简单的清单,在 Kubernetes 已经运行的任何地方为您提供一个易于使用的 ML 堆栈,并且可以根据它部署到的集群进行自我配置。

# 2.架构

# 2.1.Kubeflow 架构概述

本指南介绍了 Kubeflow 作为开发和部署机器学习(ML)系统的平台。Kubeflow 是一个数据科学家的平台,他们希望构建和实验 ML 管道。Kubeflow 也适用于希望将 ML 系统部署到各种环境中进行开发、测试和生产级服务的 ML 工程师和运营团队。

# 2.1.1.概念性概述

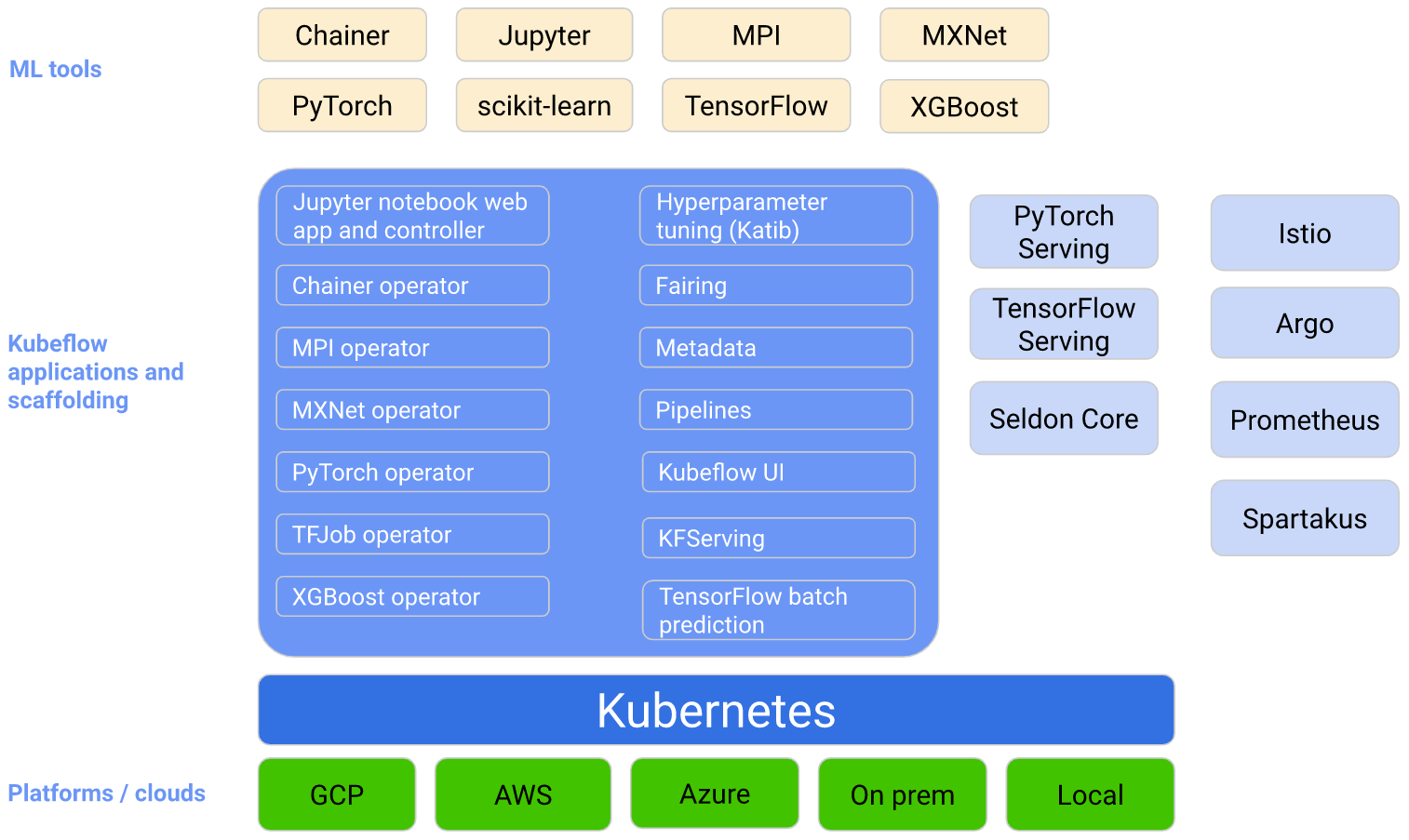

Kubeflow 是 Kubernetes 的 ML 工具包。下图显示了 Kubeflow 作为一个平台,用于在 Kubernetes 上安排 ML 系统的组件:

Kubeflow 基于 Kubernetes 构建,作为一个用于部署、扩展和管理复杂系统的系统。使用 Kubeflow 配置界面(见下文),您可以指定工作流所需的 ML 工具。然后,您可以将工作流部署到各种云、本地和本地平台,以供实验和生产使用。

# 2.1.2.介绍 ML 工作流

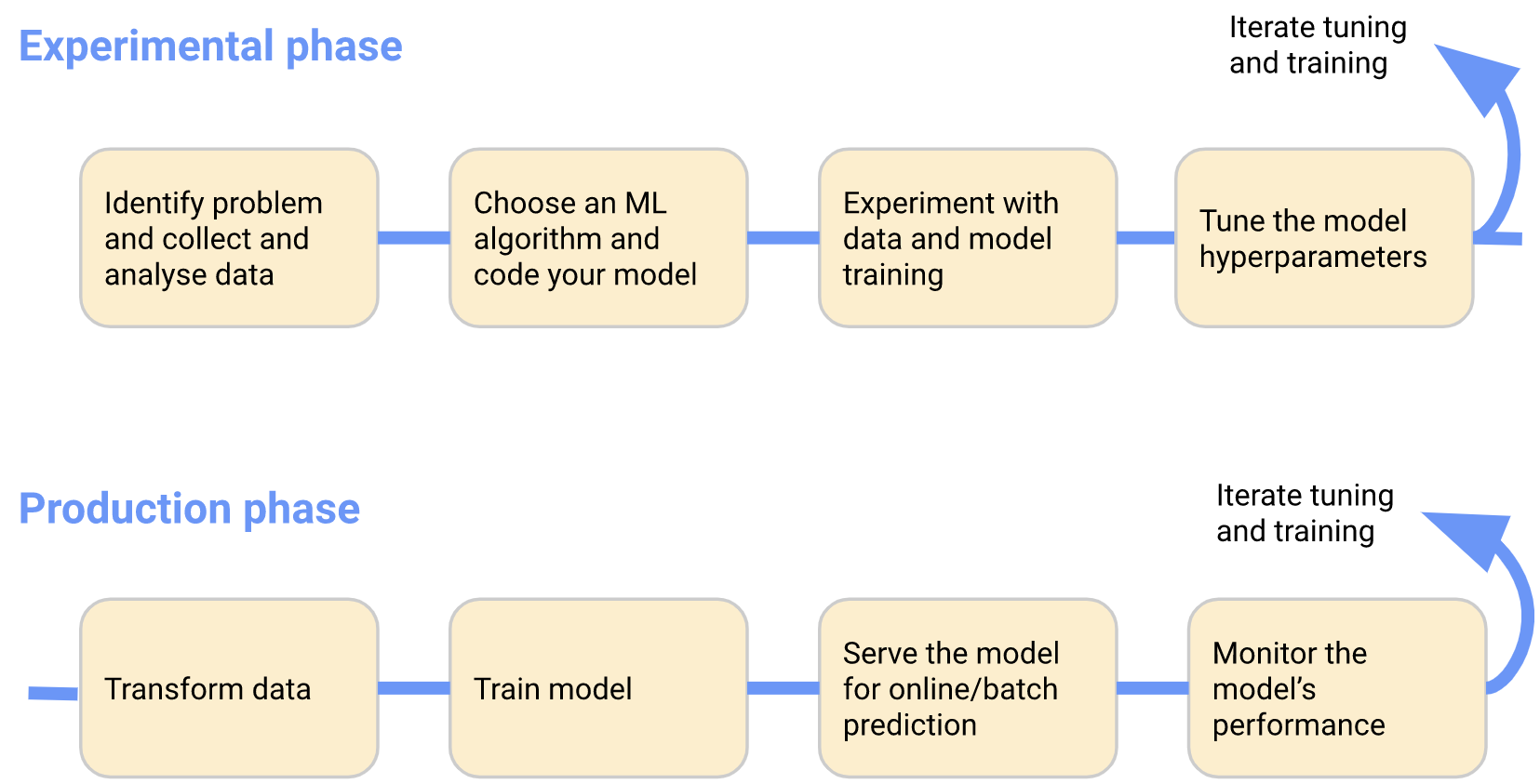

当您开发和部署 ML 系统时,ML 工作流通常由几个阶段组成。开发 ML 系统是一个迭代过程。您需要评估 ML 工作流各个阶段的输出,并在必要时对模型和参数进行更改,以确保模型始终产生所需的结果。

为了简单起见,下图按顺序显示了工作流阶段。工作流末尾的箭头指向流程,以指示流程的迭代性质:

更详细地了解各阶段:

- 在实验阶段,您基于初始假设开发模型,并迭代测试和更新模型,以产生您想要的结果:

- 确定您希望 ML 系统解决的问题。

- 收集并分析训练 ML 模型所需的数据。

- 选择 ML 框架和算法,并对模型的初始版本进行编码。

- 实验数据和训练模型。

- 调整模型超参数以确保最有效的处理和最准确的结果。

- 在生产阶段,部署执行以下过程的系统:

- 将数据转换为训练系统所需的格式。为了确保模型在训练和预测过程中表现一致,转换过程在实验和生产阶段必须相同。

- 训练 ML 模型。

- 为在线预测或以批处理模式运行提供模型。

- 监控模型的性能,并将结果反馈到您的过程中,以调整或重新训练模型。

# 2.1.3.ML 工作流中的 Kubeflow 组件

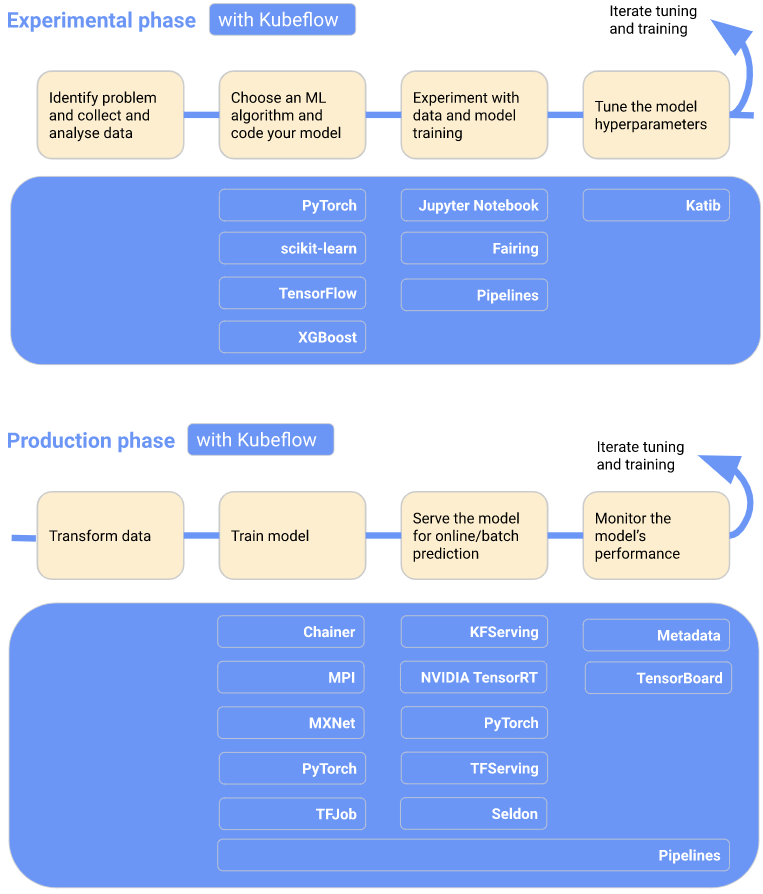

下一个图表将 Kubeflow 添加到工作流中,显示了哪些 Kubeflow 组件在每个阶段都有用:

要了解更多信息,请阅读以下 Kubeflow 组件指南:

- Kubeflow 包括用于生成和管理 Jupyter 笔记本的服务。使用笔记本进行交互式数据科学和 ML 工作流实验。

- Kubeflow Pipelines 是一个基于 Docker 容器构建、部署和管理多步骤 ML 工作流的平台。

- Kubeflow 提供了几个组件,您可以使用这些组件来构建 ML 训练、超参数调优和跨多个平台服务工作负载。

# 2.1.4.特定 ML 工作流示例

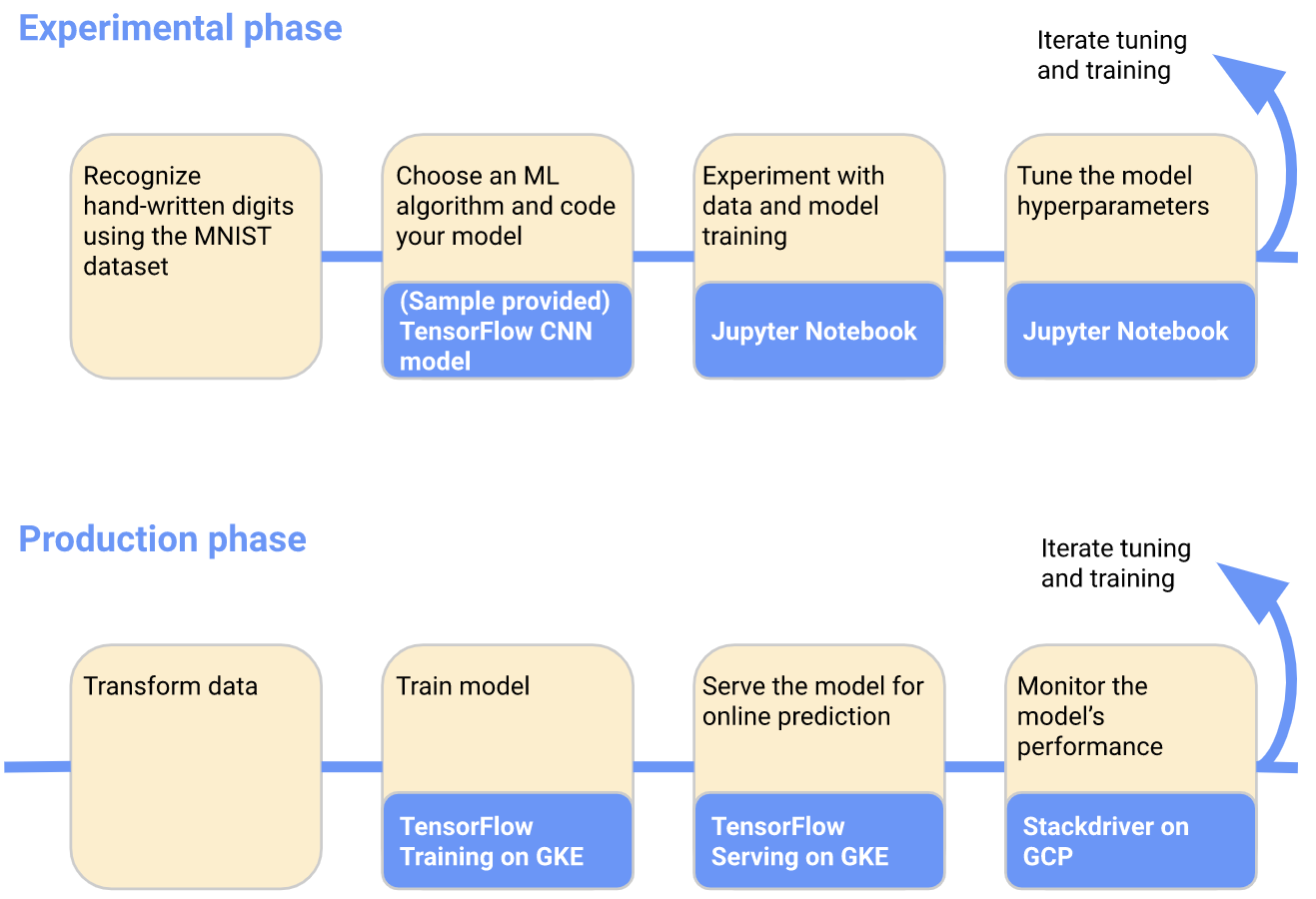

下图显示了一个特定 ML 工作流的简单示例,您可以使用该工作流来训练和服务在 MNIST 数据集上训练的模型:

有关工作流的详细信息,以及如何自己运行系统,请参阅 GCP 上 Kubeflow 的端到端教程。

# 2.1.5.Kubeflow 接口

本节介绍可用于与 Kubeflow 交互以及在 Kubeflow 上构建和运行 ML 工作流的接口。

# 2.1.5.1.Kubeflow 用户界面(UI)

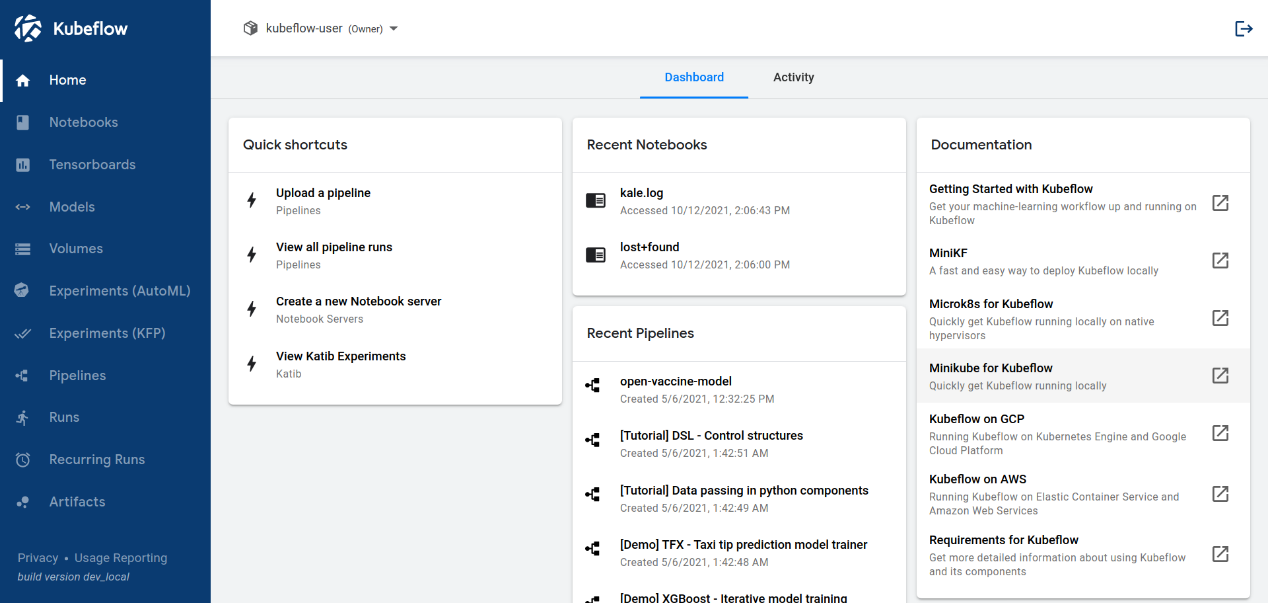

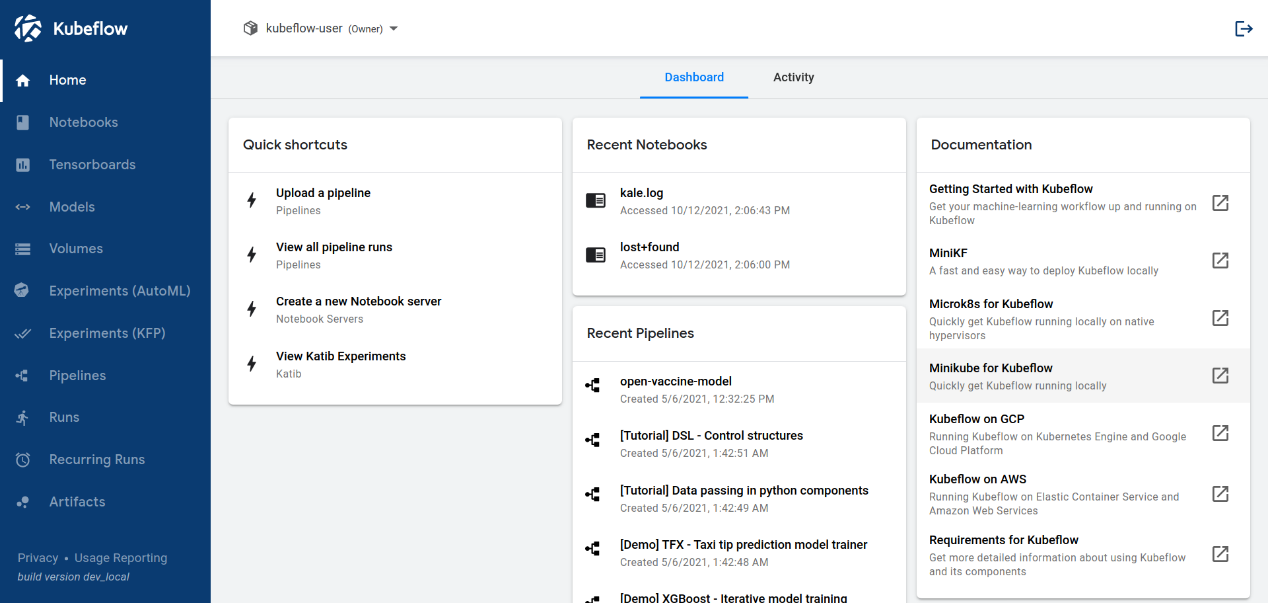

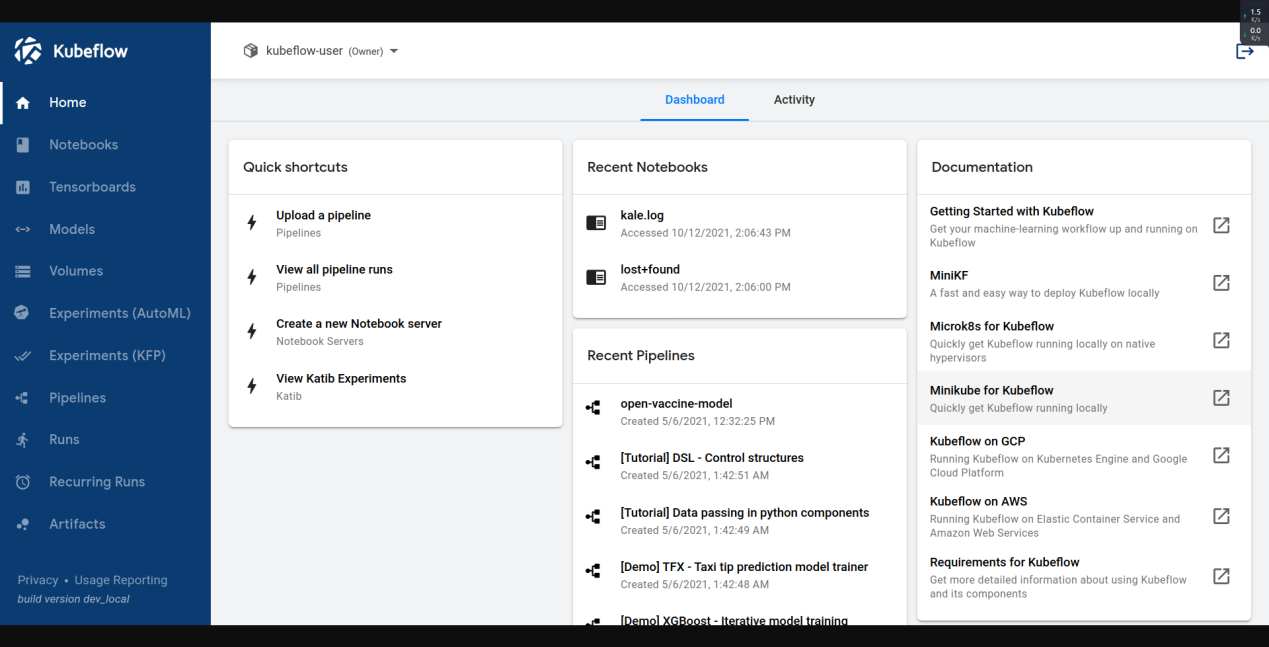

Kubeflow UI 如下所示:

UI 提供了一个中央仪表板,您可以使用它访问 Kubeflow 部署的组件。阅读如何访问中央仪表板。

# 2.1.5.2.Kubeflow API 和 SDK

Kubeflow 的各种组件提供 API 和 Python SDK。请参阅以下参考文档集:

- Kubeflow Pipelines API 和 SDK 的 Pipelines 参考文档,包括 Kubeflow Pipelines 领域特定语言(DSL)。

- Kubeflow Fairing SDK 的 Fairing 参考文档。

# 2.2.安装 Kubeflow

Kubeflow 是 Kubernetes 的端到端机器学习(ML)平台,它为 ML 生命周期的每个阶段提供组件,从探索到训练和部署。操作员可以选择最适合其用户的组件,无需部署每个组件。要阅读更多有关 Kubeflow 组件和架构的信息,请参阅 Kubeflow 架构页面。

有两种途径可以与 Kubeflow 一起启动和运行,您可以选择:

- 使用打包分发

- 使用 manifests(高级)

# 2.2.1.安装打包的 Kubeflow 发行版

打包发行版由各自的维护人员开发和支持,Kubeflow 社区目前不认可或认证任何发行版。

| Name | Maintainer | Platform | Version | Docs | Website |

|---|---|---|---|---|---|

| Kubeflow on AWS | Amazon Web Services (AWS) | Amazon Elastic Kubernetes Service (EKS) | 1.6.1 | Docs (opens new window) | External Website (opens new window) |

| Kubeflow on Azure | Microsoft Azure | Azure Kubernetes Service (AKS) | 1.2 | Docs (opens new window) | |

| Kubeflow on Google Cloud | Google Cloud | Google Kubernetes Engine (GKE) | 1.6.1 | Docs (opens new window) | |

| Kubeflow on IBM Cloud | IBM Cloud | IBM Cloud Kubernetes Service (IKS) | 1.6 | Docs (opens new window) | External Website (opens new window) |

| Kubeflow on Nutanix | Nutanix | Nutanix Karbon | 1.6.0 | Docs (opens new window) | |

| Kubeflow on OpenShift | Red Hat | OpenShift | 1.6 | Docs (opens new window) | External Website (opens new window) |

| Argoflow | Argoflow Community | Conformant Kubernetes | 1.3 | N/A | External Website (opens new window) |

| Arrikto Kubeflow as a Service | Arrikto | Fully Managed | 1.5 | N/A | External Website (opens new window) |

| Arrikto Enterprise Kubeflow | Arrikto | EKS, AKS, GKE | 1.5 | Docs (opens new window) | External Website (opens new window) |

| Charmed Kubeflow | Canonical | Conformant Kubernetes | 1.6 | Docs (opens new window) | External Website (opens new window) |

| Kubeflow on Oracle Container Engine for Kubernetes | Oracle | Oracle Cloud Infrastructure (OCI) | 1.6 | N/A | External Website (opens new window) |

| Kubeflow on vSphere | VMware | vSphere | 1.6 | N/A | External Website (opens new window) |

# 2.2.2.手动安装 Kubeflow Manifests

此方法适用于高级用户。库贝洛社区不会支持特定环境问题。如果您需要支持,请考虑使用 Kubeflow 的打包发行版。

Manifests Working Group 负责汇总每个 Kubeflow 官方组成部分的权威 Manifests。虽然这些清单旨在作为打包发行版的基础,但高级用户可以选择按照这些说明直接安装它们。

# 2.2.2.1.Kubeflow Manifests

# 2.2.2.1.1.概述

该协议归宣言工作组所有。如果您是编写或编辑软件包的撰稿人,请参阅最佳实践。Kubeflow Manifests 存储库组织在三(3)个主目录下,其中包括用于安装的清单:

| Directory | Purpose |

|---|---|

| apps | Kubeflow 的官方组成部分,由各自的 Kubeflow 工作组维护 |

| common | 共同服务,由 Manifests 工作组维护 |

| contrib | 第三方贡献的应用程序,由外部维护,不属于 Kubeflow 工作组 |

发行版目录包含 Kubeflow 特定的、原有的发行版的清单,并将在 1.4 版本中逐步淘汰,因为未来的发行版将在各自的外部存储库中维护其清单。文档、hack 和测试目录也将逐步淘汰。从 Kubeflow1.3 开始,所有组件都应该只能使用 kustomize 进行部署。任何部署在清单之上的自动化工具都应该由分发所有者在外部维护。

# 2.2.2.1.2.Kubeflow 组件版本

该 repo 周期性地从其各自的上游 repo 中同步所有官方 Kubeflow 组件。下面的矩阵显示了我们为每个组件提供的 git 版本:

| Component | Local Manifests Path | Upstream Revision |

|---|---|---|

| Training Operator | apps/training-operator/upstream | v1.5.0 (opens new window) |

| Notebook Controller | apps/jupyter/notebook-controller/upstream | v1.6.0-rc.1 (opens new window) |

| Tensorboard Controller | apps/tensorboard/tensorboard-controller/upstream | v1.6.0-rc.1 (opens new window) |

| Central Dashboard | apps/centraldashboard/upstream | v1.6.0-rc.1 (opens new window) |

| Profiles + KFAM | apps/profiles/upstream | v1.6.0-rc.1 (opens new window) |

| PodDefaults Webhook | apps/admission-webhook/upstream | v1.6.0-rc.1 (opens new window) |

| Jupyter Web App | apps/jupyter/jupyter-web-app/upstream | v1.6.0-rc.1 (opens new window) |

| Tensorboards Web App | apps/tensorboard/tensorboards-web-app/upstream | v1.6.0-rc.1 (opens new window) |

| Volumes Web App | apps/volumes-web-app/upstream | v1.6.0-rc.1 (opens new window) |

| Katib | apps/katib/upstream | v0.14.0-rc.0 (opens new window) |

| KServe | contrib/kserve/kserve | release-0.8 (opens new window) |

| KServe Models Web App | contrib/kserve/models-web-app | v0.8.1 (opens new window) |

| Kubeflow Pipelines | apps/pipeline/upstream | 2.0.0-alpha.3 (opens new window) |

| Kubeflow Tekton Pipelines | apps/kfp-tekton/upstream | v1.2.1 (opens new window) |

以下也是 Kubeflow 不同项目中使用的通用组件版本的矩阵:

| Component | Local Manifests Path | Upstream Revision |

|---|---|---|

| Istio | common/istio-1-16 | 1.16.0 (opens new window) |

| Knative | common/knative | 0.22.1 (opens new window) |

| Cert Manager | common/cert-manager | 1.10.1 (opens new window) |

# 2.2.2.1.3.安装

从 Kubeflow1.3 开始,Manifests WG 提供了两个选项,用于安装 Kubeflow 官方组件和 kustomize 通用服务。其目的是帮助最终用户轻松安装,并帮助发行所有者从经过测试的出发点构建他们的有见解的发行版:

- app 和 common 下所有组件的单命令安装

- app 和 common 的多命令、单独组件安装

选项 1 的目标是方便最终用户部署。

选项 2 的目标是定制和选择单个组件的能力。

示例目录包含一个示例 kustomization,用于运行单个命令。

在这两个选项中,我们都使用默认电子邮件(user@example.com)和密码(12341234)。对于任何生产 Kubeflow 部署,您都应该按照相关章节更改默认密码。

# 2.2.2.1.4.先决条件

- 具有默认 StorageClass 的 Kubernetes(最高 1.21)

- ⚠️ Kubeflow 1.5.0 与 1.22 及更高版本不兼容。您可以在 Kubeflow/Kubeflow#6353 中跟踪 K8s 1.22 支持的剩余工作

- kustosize(版本 3.2.0)(下载链接)

- ⚠️ Kubeflow 1.5.0 与 kustomize 4.x 的最新版本不兼容。这是由于资源排序和打印顺序发生了变化。请参阅 kubernetes sigs/kustomize#3794 和 Kubeflow/manifest#1797。我们知道这并不理想,我们正在与上游的 kustomiize 团队合作,尽快为最新版本的 kustosize 添加支持。

kubectl apply 命令在第一次尝试时可能会失败。这是 Kubernetes 和 kubectl 工作方式固有的(例如,必须在 CRD 就绪后创建 CR)。解决方案是简单地重新运行命令,直到它成功。对于单行命令,我们包含了一个 bash-one 命令行来重试该命令。

# 2.2.2.1.5.使用单个命令安装

您可以使用以下命令安装所有 Kubeflow 官方组件(驻留在 app 下)和所有公共服务(驻留在 common 下):

while ! kustomize build example | kubectl apply -f -; do echo "Retrying to apply resources"; sleep 10; done

一旦一切安装成功,您就可以通过登录集群访问 Kubeflow Central Dashboard。祝贺现在,您可以开始使用 Kubeflow 测试和运行端到端 ML 工作流。

# 2.2.2.1.6.安装单个组件^1 (opens new window)

在本节中,我们将分别使用 kubectl 和 kustosize 安装每个 Kubeflow 官方组件(在 app 下)和每个公共服务(在 common 下)。

如果执行了以下所有命令,则结果与单命令安装的上述部分相同。本节的目的是:

- 提供每个组件的描述,并深入了解其安装方式。

- 允许用户或分发所有者仅选择所需的组件。

证书管理器

许多 Kubeflow 组件使用证书管理器为准入 webhook 提供证书。安装证书管理器:

Istio

许多 Kubeflow 组件使用 Istio 来保护其流量、强制网络授权和实现路由策略。安装 Istio:

Dex

Dex 是一个具有多个身份验证后端的 OpenID Connect Identity(OIDC)。在这个默认安装中,它包括一个带有电子邮件的静态用户user@example.com.默认情况下,用户的密码为 12341234。对于任何生产 Kubeflow 部署,您都应该按照相关章节更改默认密码。用如下命令安装 Dex:

OIDC 身份验证服务

OIDC AuthService 扩展了您的 Istio Ingress 网关功能,能够作为 OIDC 客户端运行:

Knative

Knative 由 KServe 官方 Kubeflow 组件使用。安装 Knative Serving:

或者,您可以安装可用于推理请求日志记录的 Knative Eventing:

Kubeflow Namespace

创建 Kubeflow 组件所在的命名空间。此命名空间名为 Kubeflow。安装 Kubeflow 命名空间:

Kubeflow Roles

创建 Kubeflow ClusterRoles、Kubeflow 视图、Kubeflowedit 和 Kubeflowadmin。Kubeflow 组件聚合对这些 ClusterRoles 的权限。安装 Kubeflow 角色:

Kubeflow Istio 资源

创建 Kubeflow 所需的 Istio 资源。这个 kustomization 当前在名称空间 Kubeflow 中创建了一个名为 Kubeflow Gateway 的 Istio 网关。如果你想用自己的 Istio 安装,那么你也需要这个 kustomization。安装 istio 资源:

# 2.3.获得支持

从何处获得 Kubeflow 的支持,本页介绍了当您遇到问题、有问题或想对 Kubeflow 提出建议时,可以探索的 Kubeflow 资源和支持选项。

# 2.3.1.应用程序状态

从 Kubeflow v1.0 发布开始,Kubeflow 社区将稳定状态归因于那些满足定义的稳定性、可支持性和可升级性级别的应用程序和组件。

当您将 Kubeflow 部署到 Kubernetes 集群时,您的部署包括许多应用程序。应用程序版本控制独立于 Kubeflow 版本控制。当应用程序在稳定性、可升级性和提供服务(如日志记录和监视)方面满足某些标准时,应用程序将移至 1.0 版。

当应用程序迁移到 1.0 版本时,Kubeflow 社区将决定是否在 Kubeflow 的下一个主要或次要版本中将该应用程序版本标记为稳定版本。

Kubeflow 的应用程序状态指示器:

- 稳定意味着应用程序符合达到应用程序版本 1.0 的标准,并且 Kubeflow 社区认为该应用程序对于 Kubeflow 的这个版本是稳定的。

- Beta 意味着应用程序正在朝着 1.0 版本的版本发展,其维护人员已经传达了满足稳定状态标准的时间表。Alpha 表示应用程序处于开发和/或集成到 Kubeflow 的早期阶段。

# 2.3.2.支持级别

下表描述了根据应用程序的状态可以预期的支持级别:

| Application status | Level of support |

|---|---|

| Stable | Kubeflow 社区为稳定的应用程序提供了最佳支持。请参阅下面关于社区支持的部分,了解尽力支持的定义以及您可以报告和讨论问题的社区渠道。您还可以考虑向 Kubeflow 社区提供商或云提供商请求支持。 |

| Beta | Kubeflow 社区为测试版应用程序提供了最佳支持。请参阅下面关于社区支持的部分,了解尽力支持的定义以及您可以报告和讨论问题的社区渠道。 |

| Alpha | 每个应用程序的 alpha 状态响应不同,这取决于该应用程序的社区规模和当前应用程序的活跃开发级别。 |

# 2.3.3.Kubeflow 社区的支持

Kubeflow 拥有一个活跃而乐于助人的用户和贡献者社区。Kubeflow 社区为稳定和测试版应用程序提供了尽最大努力的支持。尽力支持意味着没有解决问题的正式协议或承诺,但社区意识到尽快解决问题的重要性。如果以下所有情况属实,社区承诺帮助您诊断和解决问题:

- 原因属于 Kubeflow 控制的技术框架。例如,如果问题是由组织内的特定网络配置引起的,Kubeflow 社区可能无法提供帮助。

- 社区成员可以重现问题。

- 问题的报告者可以帮助进一步诊断和排除故障。

您可以在以下地方提出问题和建议:

- 轻松进行在线聊天和消息传递。查看 Kubeflow 的 Slack 工作区和频道的详细信息。

- Kubeflow 讨论基于电子邮件的小组讨论。加入 kubef low 讨论小组。

- Kubeflow 文档提供概述和操作指南。在排除问题时,请特别参考以下文档:

- Kubeflow 安装和设置

- Kubeflow 组件

- 进一步设置和故障排除

- Kubeflow 发布已知问题、问题和功能请求的跟踪器。搜索打开的问题,看看是否有其他人已经记录了您遇到的问题,并了解迄今为止的任何解决方法。如果没有人记录您的问题,请创建一个新问题来描述问题。

每个 Kubeflow 应用程序在 GitHub 上的 Kubeflow 组织中都有自己的问题跟踪程序。要开始,以下是主要的问题跟踪程序:

- Kubeflow core^2 (opens new window)

- kfctl 命令行工具^3 (opens new window)

- Kustomize manifests^4 (opens new window)

- Kubeflow 管道^5 (opens new window)

- Katib AutoML

- 元数据

- Fairing 笔记本 SDK

- Kubeflow 训练(TFJob、PyTorchJob、MXJob、XGBoostJob)

- KF 服务

- 示例

- 文档

# 2.3.4.Kubeflow 生态系统供应商的支持

以下组织为 Kubeflow 部署提供建议和支持:

# 2.3.5.来自云或平台提供商的支持

如果您使用云提供商的服务来托管 Kubeflow,云提供商可能能够帮助您诊断和解决问题。

请参阅您正在使用的云服务或平台的支持页面:

- 亚马逊 Web 服务(AWS)

- 标准 Ubuntu

- 谷歌云平台(GCP)

- IBM 云

- Microsoft Azure

- 红帽 OpenShift

# 2.3.6.其他提问地点

您还可以尝试在堆栈溢出上搜索答案或提问。查看标有“Kubeflow”的问题。

# 2.3.7.参与 Kubeflow 社区

你可以通过多种方式参与库贝洛。例如,您可以为 Kubeflow 代码或文档提供帮助。您可以参加社区会议,与维护人员讨论特定主题。有关更多信息,请参见 Kubeflow 社区页面。

# 2.3.8.关注新闻

关注库贝洛新闻:

- Kubeflow 博客是发布新版本、事件和技术演练的主要渠道。

- 请在 Twitter 上关注 Kubeflow 以获取共享的技术提示。

- 发行说明详细介绍了每个 Kubeflow 应用程序的最新更新。

- 每个 Kubeflow 应用程序在 GitHub 上的 Kubeflow 组织中都有自己的存储库。一些应用程序发布发行说明。要开始,以下是主要应用程序的发行说明:

- Kubeflow Core

- Kubeflow 管道

- Katib AutoML

- 元数据

- Fairing 笔记本 SDK

- 库贝洛训练操作员

- KF 服务

# 2.3.9.示例

使用 Kubeflow 演示机器学习的示例

警告

Kubeflow/examples 存储库中的一些示例尚未使用更新版本的 Kubeflow 进行测试。请参阅所选示例的自述文件。

MNIST 图像分类

使用 MNIST 数据集训练和服务图像分类模型。本教程采用在 Kubeflow 集群中运行的 Jupyter 笔记本的形式。您可以选择在各种云上部署 Kubeflow 并训练模型,包括 Amazon Web Services(AWS)、Google Cloud Platform(GCP)、IBM Cloud、Microsoft Azure 和内部部署。使用 TensorFlow Serving 为模型提供服务。

财务时间序列

在谷歌云平台(GCP)上使用 TensorFlow 训练和服务金融时间序列分析模型。使用 Kubeflow Pipelines SDK 自动化工作流。

# 3.部件

# 3.1.中央仪表板

# 3.1.1.中央仪表板

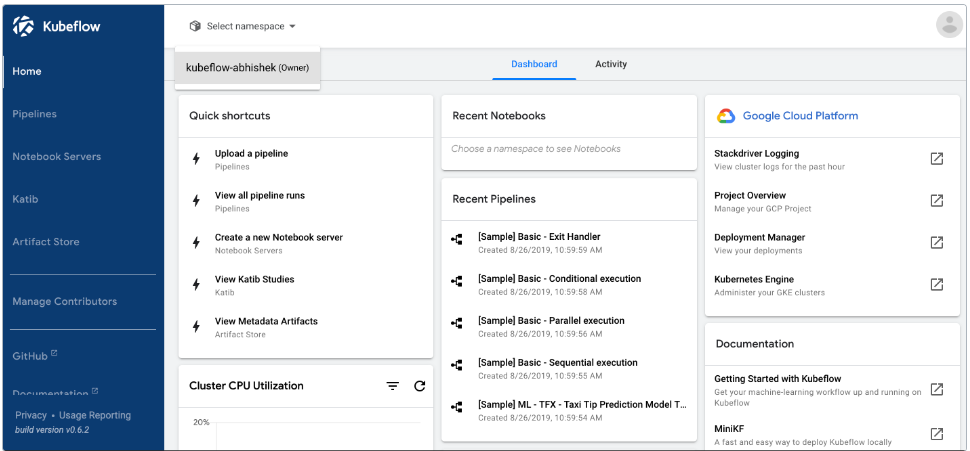

# 3.1.1.1.Kubeflow 用户界面(UI)概述

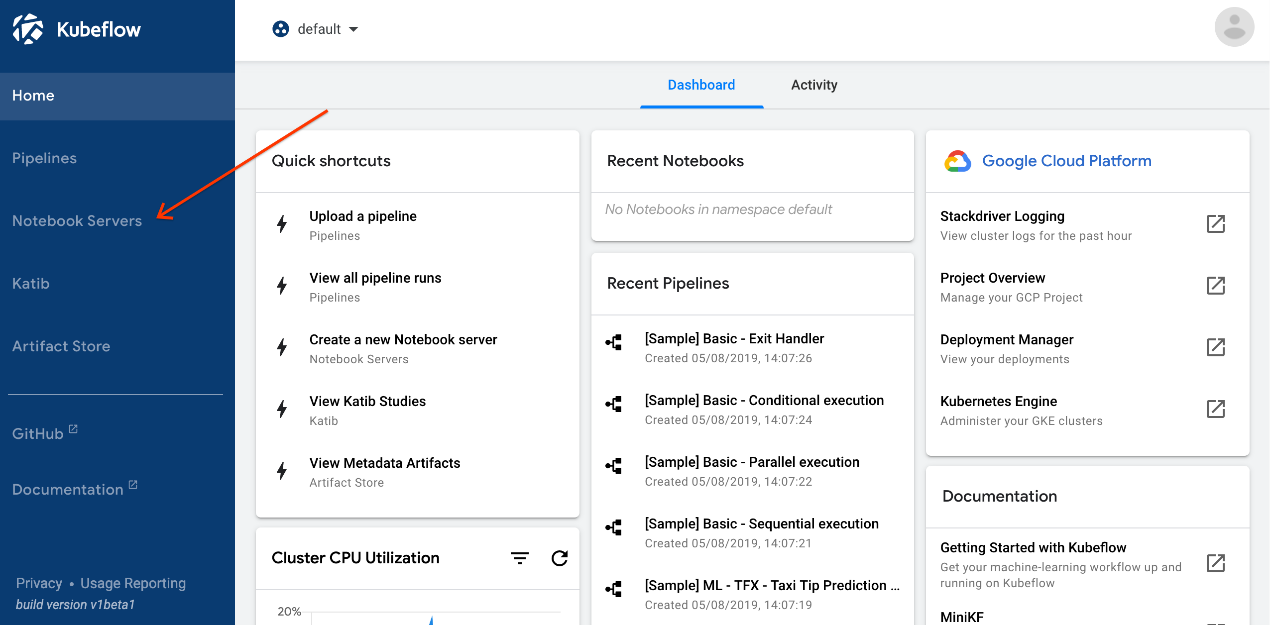

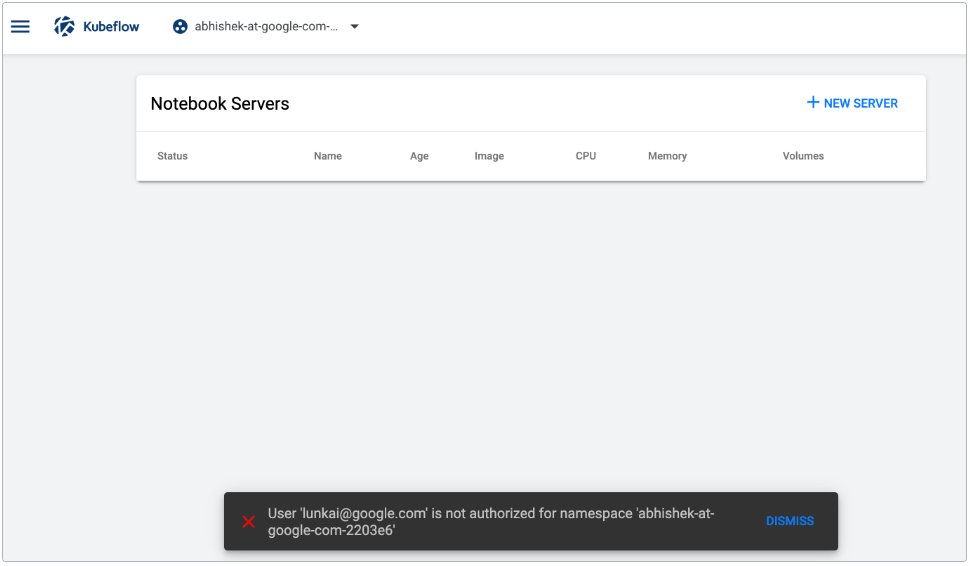

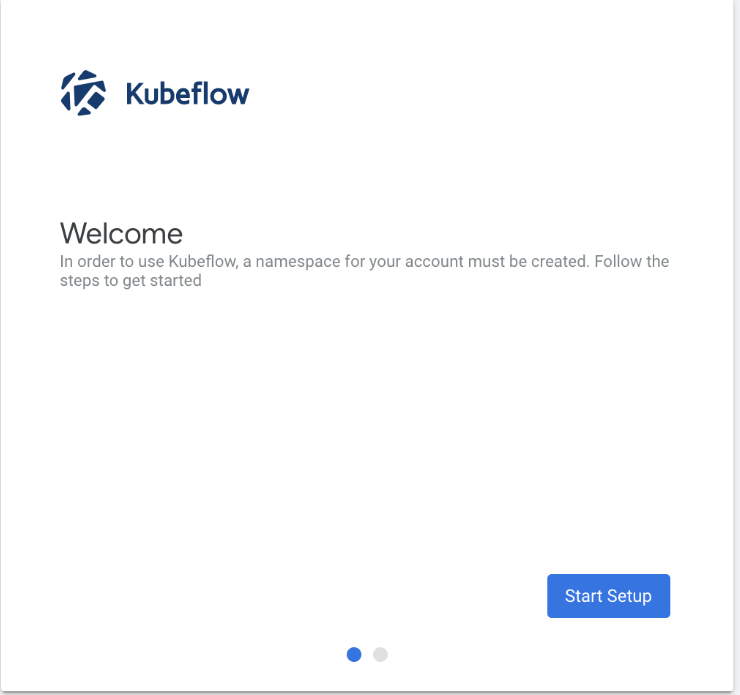

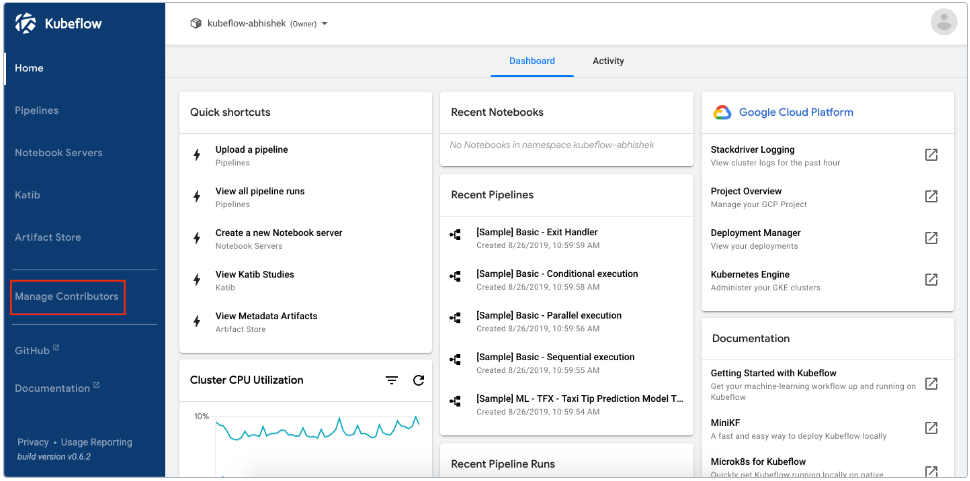

Kubeflow 组件状态稳定。请参阅 Kubeflow 版本控制策略。Kubeflow 部署包括一个中央仪表板,可快速访问部署在集群中的 Kubeflow 组件。仪表板包括以下功能:

特定操作的快捷方式,最近的管道和笔记本列表,以及度量,在一个视图中提供您的作业和集群概览。

集群中运行的组件的 UI 的外壳,包括 Pipelines、Katib、Notebook 等。

一个注册流,提示新用户在必要时设置其命名空间。

# 3.1.1.2.Kubeflow UI 概述

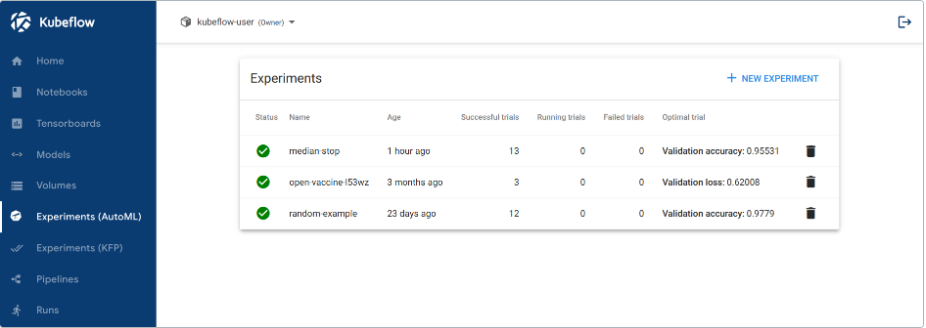

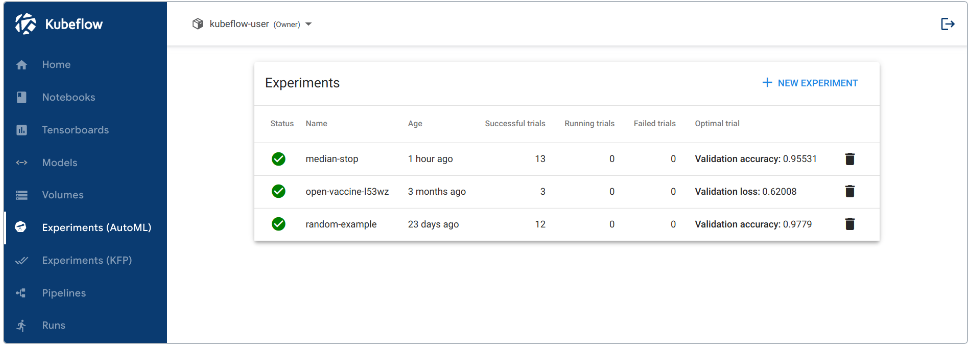

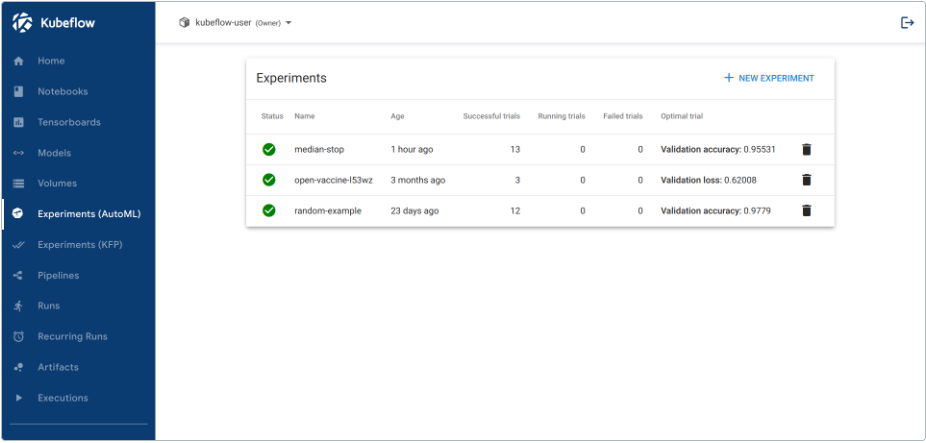

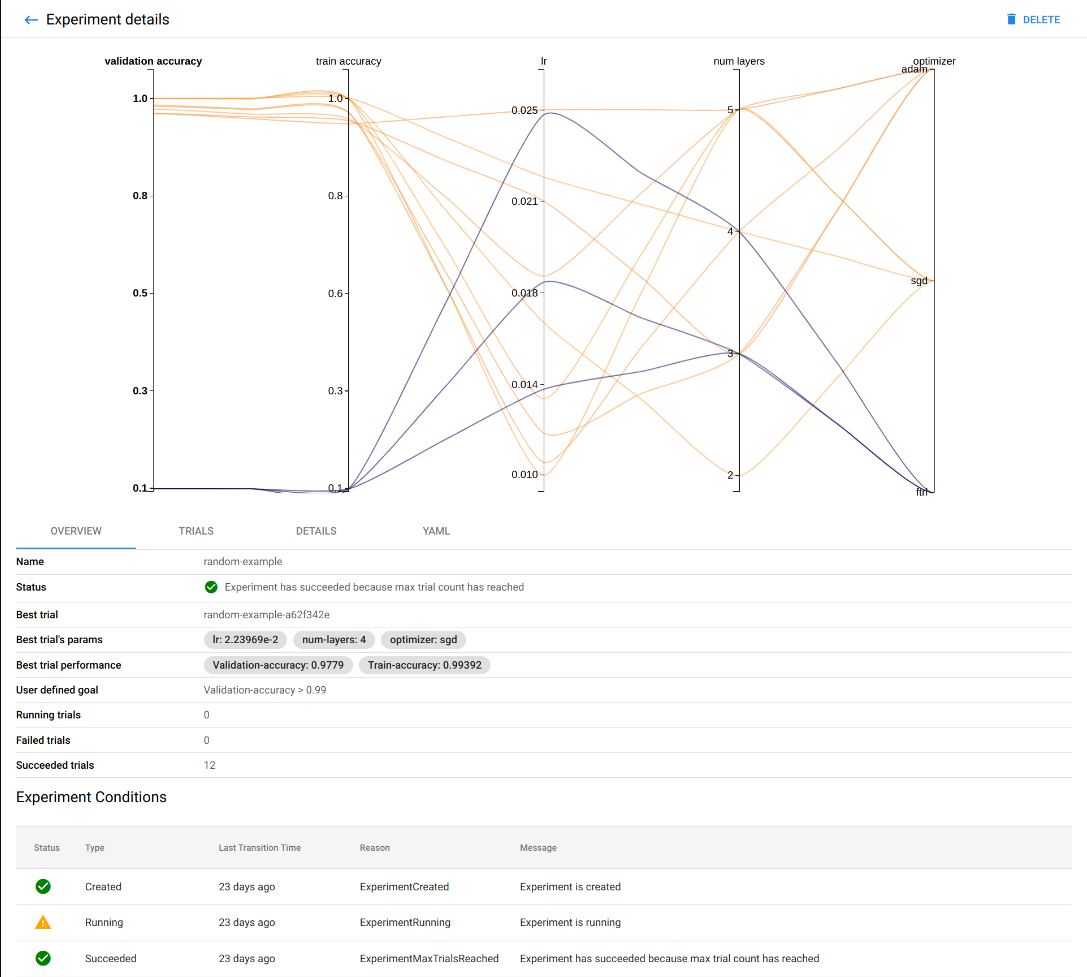

Kubeflow UI 包括以下内容:

- 主页:主页,访问最新资源、活动实验和有用文档的中心。

- 笔记本服务器:管理笔记本服务器。

- TensorBoard:管理 TensorBoard 服务器。

- 模型:管理部署的 KFServing 模型。

- 卷:管理群集的卷。

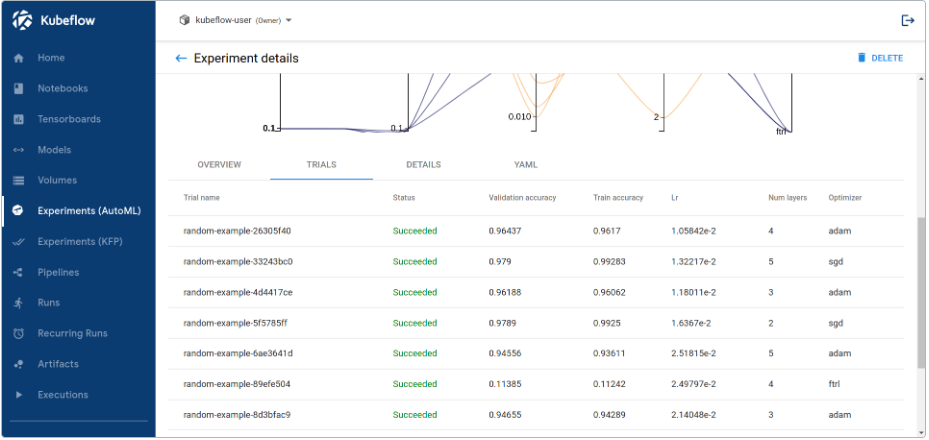

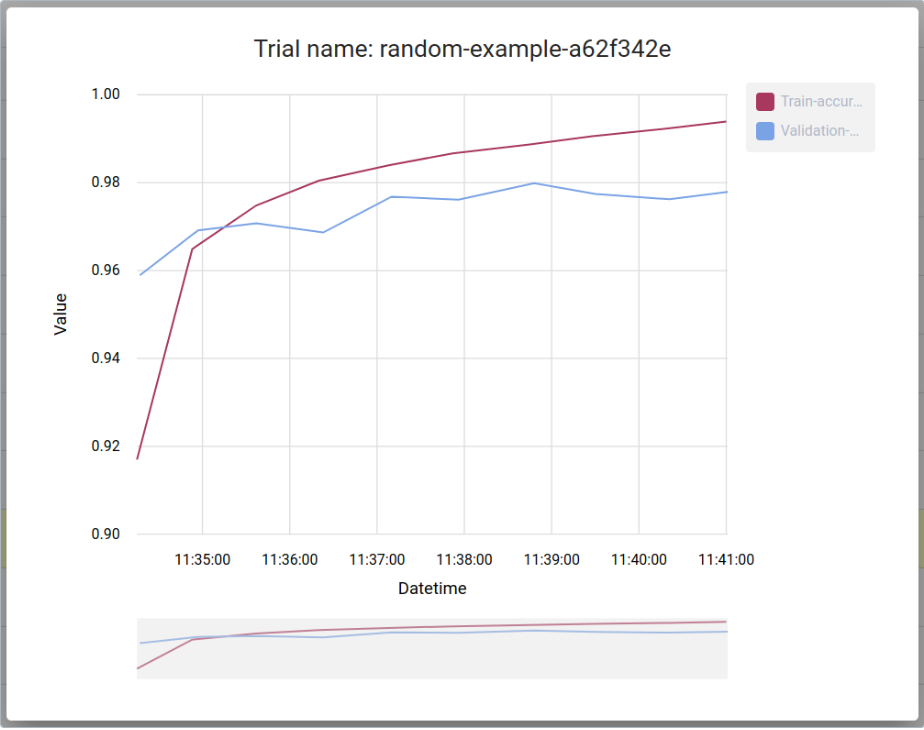

- 实验(AutoML):管理 Katib 实验。

- 实验(KFP):管理 Kubeflow Pipelines(KFP)实验。

- 管道:管理 KFP 管道。

- 运行:管理 KFP 运行。

- 定期运行:管理 KFP 定期运行。

- 工件:跟踪 ML 元数据(MLMD)工件。

- 执行:跟踪 MLMD 中的各种组件执行。

- 管理贡献者:在 Kubeflow 部署中配置跨命名空间的用户访问共享。

中央仪表板如下所示:

# 3.1.1.3.访问中央仪表板

要访问中央仪表板,您需要连接到 Istio 网关,该网关提供对 Kubeflow 服务网格的访问。

如何访问 Istio 网关取决于您如何配置它。

# 3.1.1.4.谷歌云平台(GCP)的 URL 模式

如果您按照指南在 GCP 上部署 Kubeflow,则可以通过以下模式的 URL 访问 Kubeflow 中央 UI:

# 3.1.1.5.URL 将显示上面所示的仪表板

如果您使用云身份感知代理(IAP)部署 Kubeflow,Kubeflow 将使用 Let's Encrypt 服务为 Kubeflow UI 提供 SSL 证书。有关证书问题的疑难解答,请参阅监控云 IAP 设置的指南。

# 3.1.1.6.使用 kubectl 和端口转发

如果您没有将 Kubeflow 配置为与身份提供者集成,那么您可以直接转发到 Istio 网关。

如果以下任一项为真,则端口转发通常不起作用:

- 您已经使用 CLI 部署的默认设置在 GCP 上部署了 Kubeflow。

- 您已将 Istio 入口配置为仅接受特定域或 IP 地址上的 HTTPS 流量。

- 您已经将 Istio 入口配置为执行授权检查(例如,使用 CloudIAP 或 Dex)。

您可以通过 kubectl 和端口转发访问 Kubeflow,如下所示:

- 如果尚未安装 kubectl,请安装:

- 如果您在 GCP 上使用 Kubeflow,请在命令行上运行以下命令:gcloud components install kubectl。

- 或者,遵循 kubectl 安装指南。

- 使用以下命令设置到 Istio 网关的端口转发。

- 在以下位置访问中央导航仪表板:

根据您配置 Kubeflow 的方式,并非所有 UI 都在端口转发到反向代理之后工作。对于某些 web 应用程序,您需要配置应用程序服务的基本 URL。

# 3.1.2.自定义菜单项

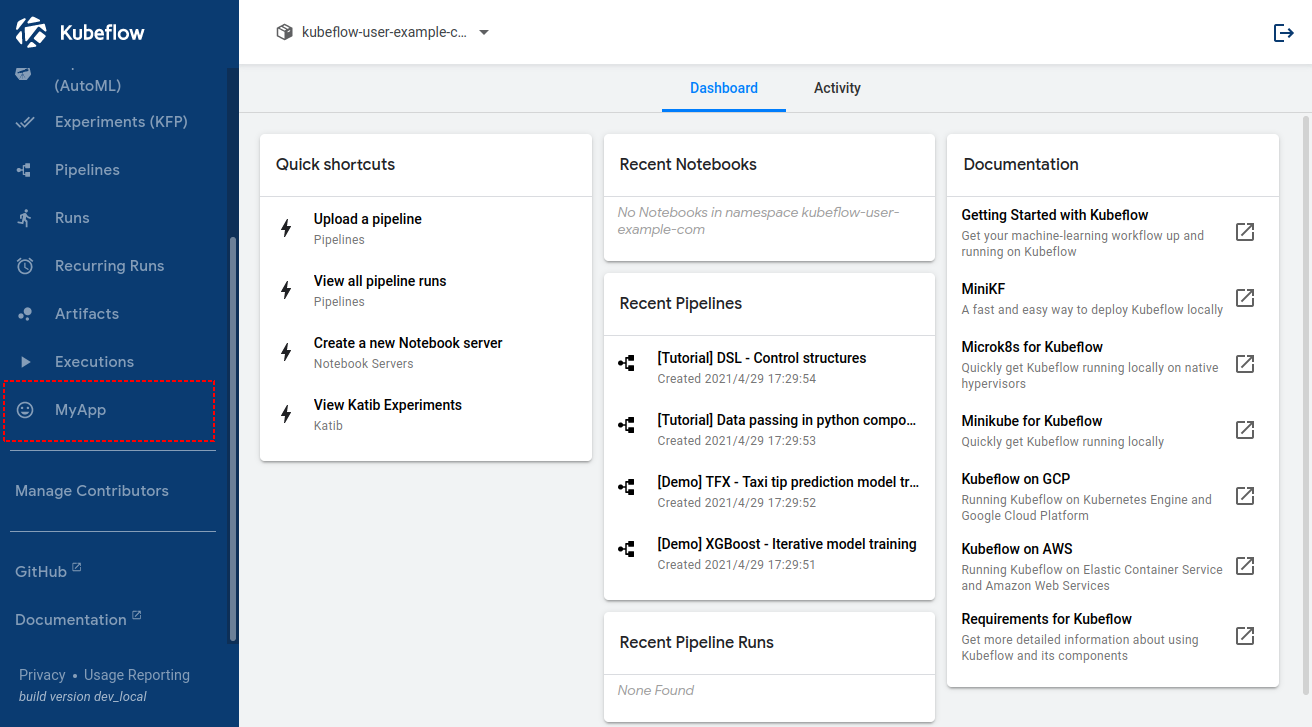

自定义菜单项以集成第三方应用程序。集群管理员可以将第三方应用程序与 Kubeflow 集成。在下面的示例中,“My App”被添加到侧菜单栏上。

# 3.1.2.1.添加共享项目

本节介绍了添加所有用户共享的项目的方法。首先,集群管理员应该将应用程序部署为 Kubernetes 中的微服务。应用程序的流量应设置为 Istio 的 VirtualService。

使用特定前缀进行部署并通过它控制流量是一种即时的方法。在这种情况下,可以从以下 URL 访问新应用程序。

接下来,菜单栏的配置可以如下打开。

您将看到当前设置。请根据需要添加新项目。

“图标”可以从铁图标^6 (opens new window)中选择。你可以在这个图标演示中看到铁图标列表。配置的变化很快就会反映出来。如果没有,请展开 centraldashboard 并重新加载 web 浏览器。

您将在菜单栏上看到一个新项目(在本例中为 MyApp)。通过单击该按钮,您可以跳转到 http://gateway/\_\_/myapp/并通过 (opens new window) Kubeflow 仪表板访问第三方应用程序。

# 3.1.2.2.添加名称空间项目

本节介绍了分割其他应用资源的方法。尽管 Kubeflow 具有多租户功能,但一些第三方应用程序无法与 Kubeflow 配置文件交互,或者不支持多租户。处理此问题的通用方法是为每个命名空间部署应用程序。集群管理员为每个命名空间和 URL 部署应用程序如下所示。

在这种情况下,您可以如下配置中央仪表板。当用户打开仪表板时,{ns}应替换为命名空间。

用户可以在菜单栏上看到一个新项目(在本例中,也是 MyApp)。它们可以根据名称空间选择跳到 http://gateway/\__/myapp/profile1/或 (opens new window) http://gateway/_/myapp/profile (opens new window) 2/。iframe 的实际内部内容由命名空间切换。

如果启用了 sidecar 注入,则对应用程序的授权由 istio 完成。e、 g)不属于 profile2 的用户无法访问http://gateway/__/myapp/profile2/ (opens new window)。

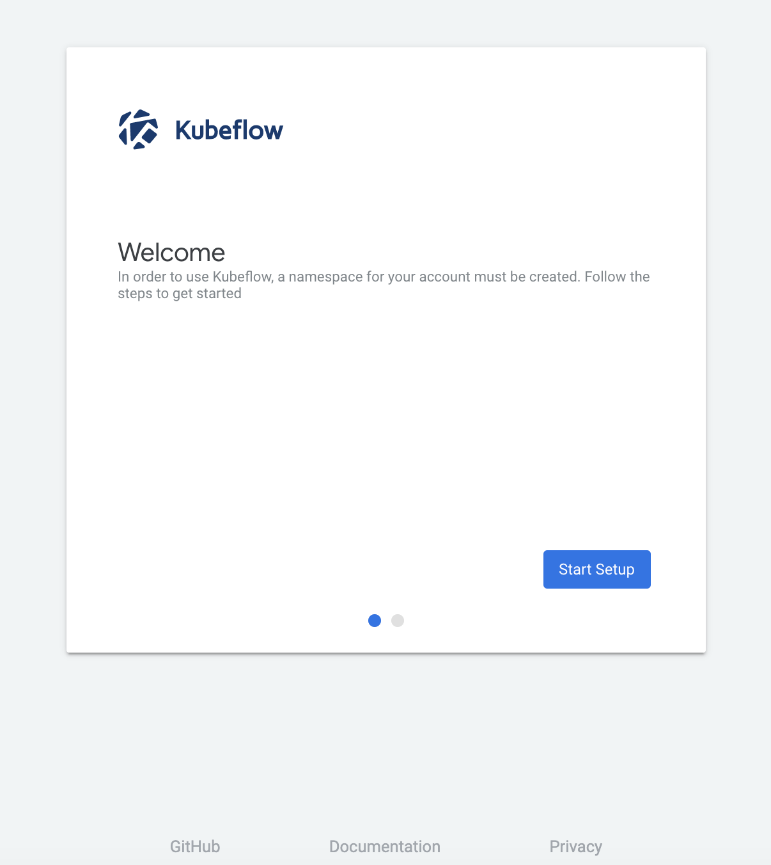

# 3.1.2.3.注册流程

在 Kubeflow 中设置命名空间。本指南适用于首次登录 Kubeflow 的 Kubeflow 用户。用户可以是部署 Kubeflow 的人,也可以是具有访问 Kubeflow 集群和使用 Kubeflow 权限的其他人。

# 3.1.2.4.命名空间简介

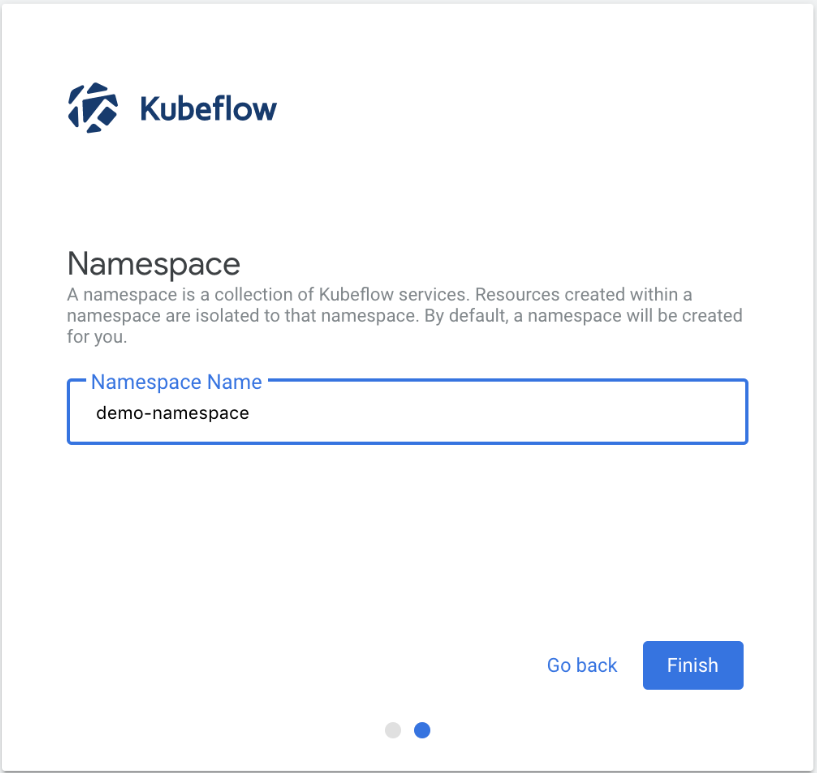

根据 Kubeflow 集群的设置,您可能需要在首次登录 Kubeflow 时创建一个命名空间。命名空间有时被称为概要文件或工作组。

Kubeflow 在以下情况下提示您创建命名空间:

- 对于支持多用户隔离的 Kubeflow 部署:您的用户名还没有与角色绑定相关联的命名空间,这些角色绑定为您提供了对命名空间的管理(所有者)访问权限。

- 对于支持单用户隔离的 Kubeflow 部署:Kubeflow 集群没有命名空间角色绑定。

如果 Kubeflow 没有提示您创建名称空间,那么 Kubeflow 管理员可能已经为您创建了名称空间。您应该能够看到 Kubeflow 中央仪表板并开始使用 Kubeflow。

# 3.1.2.5.先决条件

Kubeflow 管理员必须执行以下步骤:

- 按照 Kubeflow 入门指南,将 Kubeflow 部署到 Kubernetes 集群。

- 让您访问 Kubernetes 集群。请参阅多租户指南。

# 3.1.2.6.创建命名空间

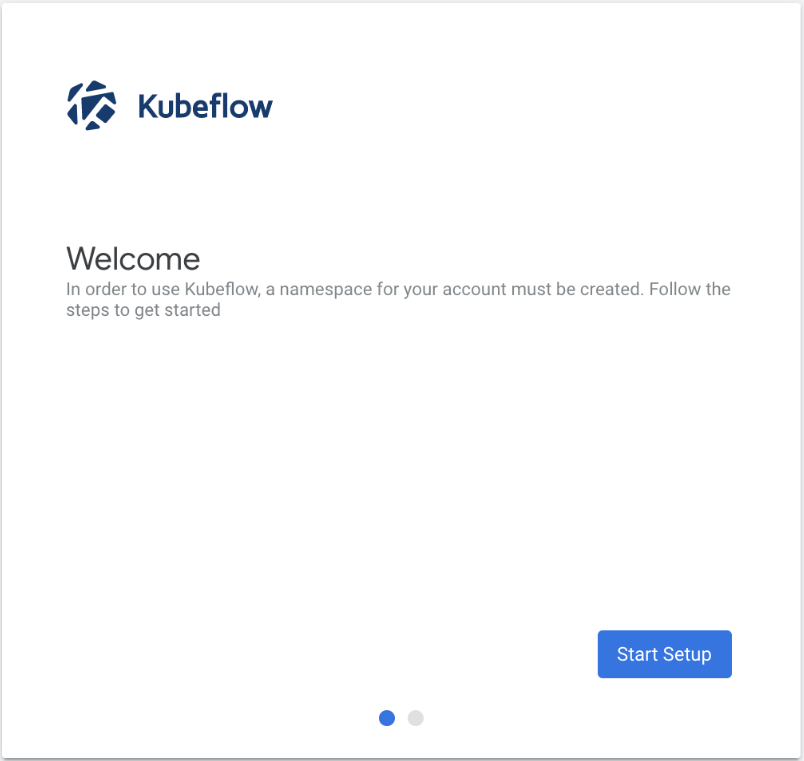

如果您还没有与用户名关联的合适名称空间,Kubeflow 将在您首次登录时显示以下屏幕:

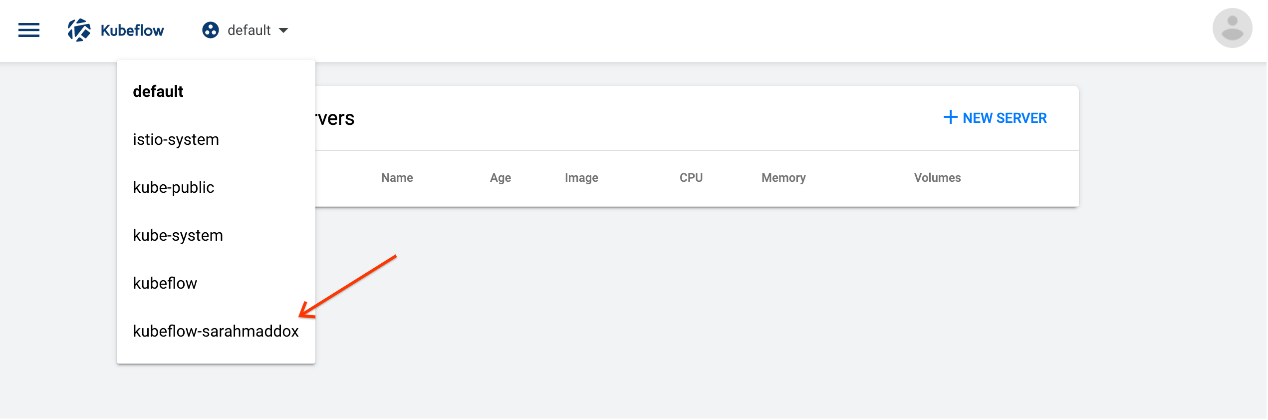

单击开始设置并按照屏幕上的说明设置命名空间。命名空间的默认名称是用户名。创建名称空间后,您应该看到 Kubeflow 中央仪表板,屏幕顶部的下拉列表中显示了您的名称空间:

# 3.1.3.注册一个流程

本指南适用于首次登录 Kubeflow 的 Kubeflow 用户。用户可以是部署 Kubeflow 的人,也可以是具有访问 Kubeflow 集群和使用 Kubeflow 权限的其他人。

# 3.1.3.1.命名空间简介

根据 Kubeflow 集群的设置,您可能需要在首次登录 Kubeflow 时创建一个命名空间。命名空间有时被称为概要文件或工作组。

Kubeflow 在以下情况下提示您创建命名空间:

- 对于支持多用户隔离的 Kubeflow 部署:您的用户名还没有与角色绑定相关联的命名空间,这些角色绑定为您提供了对命名空间的管理(所有者)访问权限。

- 对于支持单用户隔离的 Kubeflow 部署:Kubeflow 集群没有命名空间角色绑定。

如果 Kubeflow 没有提示您创建名称空间,那么 Kubeflow 管理员可能已经为您创建了名称空间。您应该能够看到 Kubeflow 中央仪表板并开始使用 Kubeflow。

# 3.1.3.2.先决条件

Kubeflow 管理员必须执行以下步骤:

- 按照 Kubeflow 入门指南^7 (opens new window),将 Kubeflow 部署到 Kubernetes 集群。

- 让您访问 Kubernetes 集群^8 (opens new window)。请参阅多租户指南。

# 3.1.3.3.创建命名空间

如果您还没有与用户名关联的合适名称空间,Kubeflow 将在您首次登录时显示以下屏幕:

单击开始设置并按照屏幕上的说明设置命名空间。命名空间的默认名称是用户名。

创建名称空间后,您应该看到 Kubeflow 中央仪表板,屏幕顶部的下拉列表中显示了您的名称空间:

# 3.2.Kubeflow Notebooks

# 3.2.1.概述

# 3.2.1.1.什么是 Kubeflow 笔记本?

Kubeflow Notebook 提供了一种在 Kubernetes 集群中运行基于 web 的开发环境的方法,方法是在 Pods 中运行它们。

一些关键功能包括:

- 本机支持 Jupyter Lab、RStudio 和 Visual Studio Code(代码服务器)。

- 用户可以直接在集群中创建笔记本容器,而不是在工作站上本地创建。

- 管理员可以为他们的组织提供标准笔记本图像,并预先安装所需的软件包。

- 访问控制由 Kubeflow 的 RBAC 管理,使整个组织更容易共享笔记本

# 3.2.2.快速入门指南

# 3.2.2.1.总结

- 按照《入门-安装 Kubeflow》安装 Kubeflow。

- 在浏览器中打开 Kubeflow Central Dashboard。

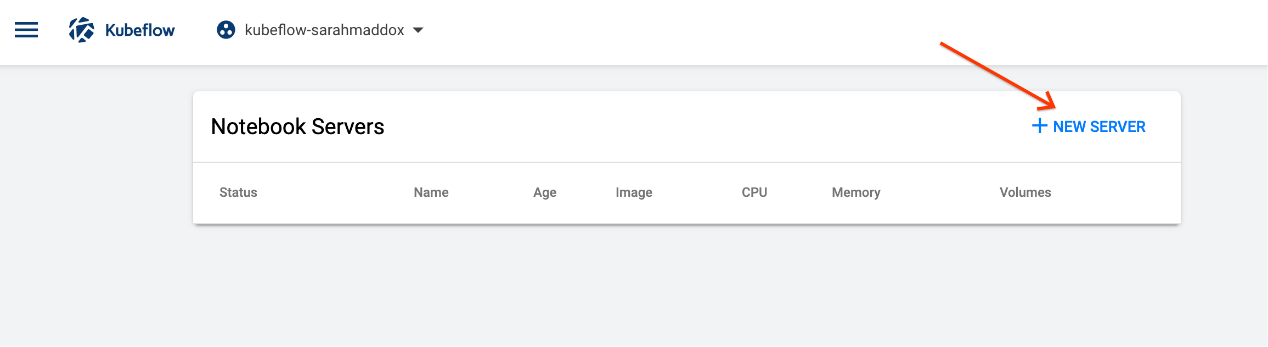

- 单击左侧面板中的“记事本”。

- 单击“新建服务器”以创建新的笔记本服务器。

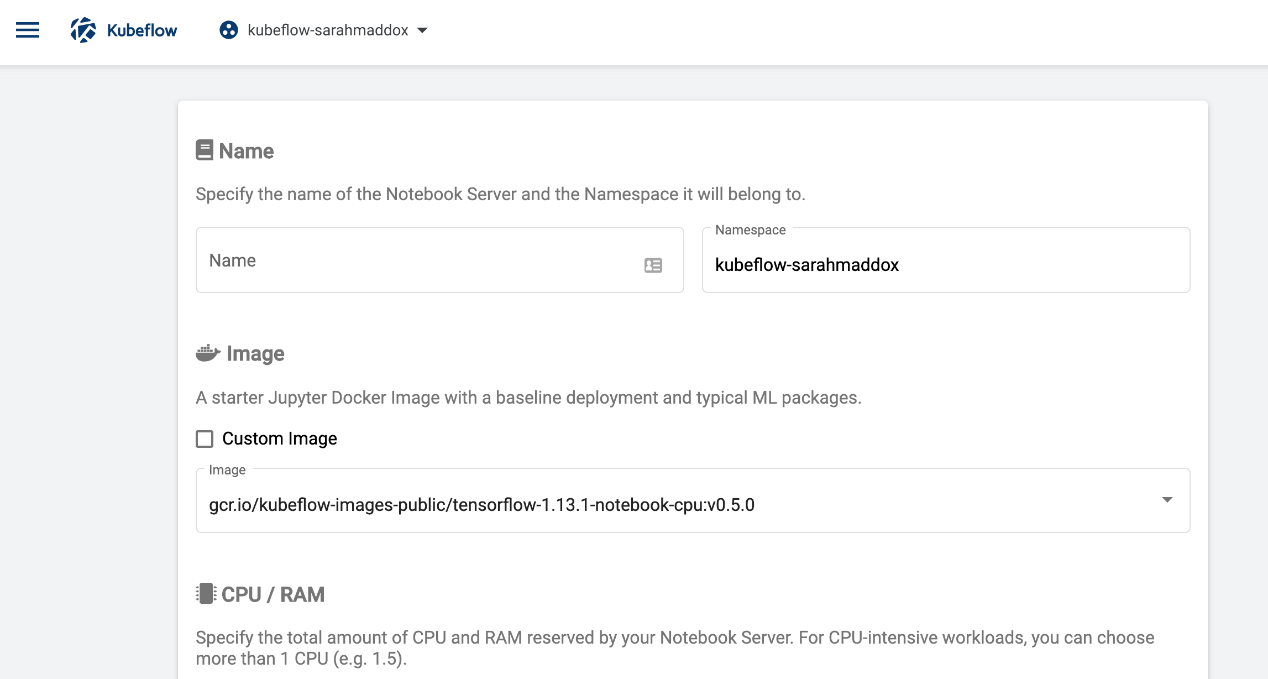

- 指定笔记本服务器的配置。

- 配置笔记本后,单击“连接”

# 3.2.2.2.详细步骤

- 在浏览器中打开 Kubeflow Central Dashboard。

- 选择命名空间:

- 单击名称空间下拉列表以查看可用名称空间的列表。

- 选择与 Kubeflow Profile 对应的命名空间。(有关配置文件的更多信息,请参阅多用户隔离页面。)

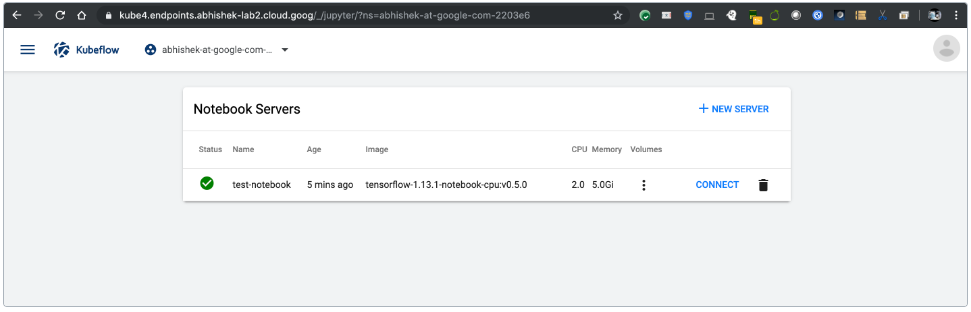

- 单击左侧面板中的“笔记本服务器”:

- 单击“笔记本服务器 Notebook Servers””页面上的“新建服务器 New Server””:

- 输入笔记本服务器的“名称 Name”。名称可以包含字母和数字,但不能包含空格。例如,my-first-notebook。

- 为笔记本服务器选择 Docker“图像”

- 自定义图像:如果选择自定义选项,则必须在表单 registry/image:tag 中指定 Docker 图像。(请参阅容器图像指南^9 (opens new window)。)

- 标准图像:单击“图像”下拉菜单以查看可用图像列表。(您可以从 Kubeflow 管理员配置的列表中选择)

- 指定笔记本服务器将请求的“CPU”数量。

- 指定笔记本服务器将请求的“RAM”数量。

- 指定要作为 PVC 卷安装在主文件夹中的“工作区卷”。

- (可选)指定一个或多个要安装为 PVC 卷的“数据卷”。

- (可选)指定一个或多个其他“配置”

- 这些资源对应于概要文件命名空间中的 PodDefault 资源^10 (opens new window)。

- Kubeflow 将“配置”字段中的标签与 PodDefault 清单中指定的属性进行匹配。

- 例如,在“配置”字段中选择标签 add gcp secret,以匹配包含以下配置的 PodDefault 清单:

- (可选)指定笔记本服务器将请求的任何“GPUs”。Kubeflow 在 Pod 请求中使用“limits”将 GPU 配置到笔记本 Pod 上(有关调度 GPU 的详细信息,请参阅 Kubernetes^11 (opens new window)文档)

- (可选)指定“启用共享内存enable shared memory”的设置。

- 一些库(如 PyTorch)使用共享内存进行多处理。

- 目前,Kubernetes 中没有激活共享内存的实现。

- 作为一种解决方法,Kubeflow 在/dev/shm 上装载一个空目录卷。

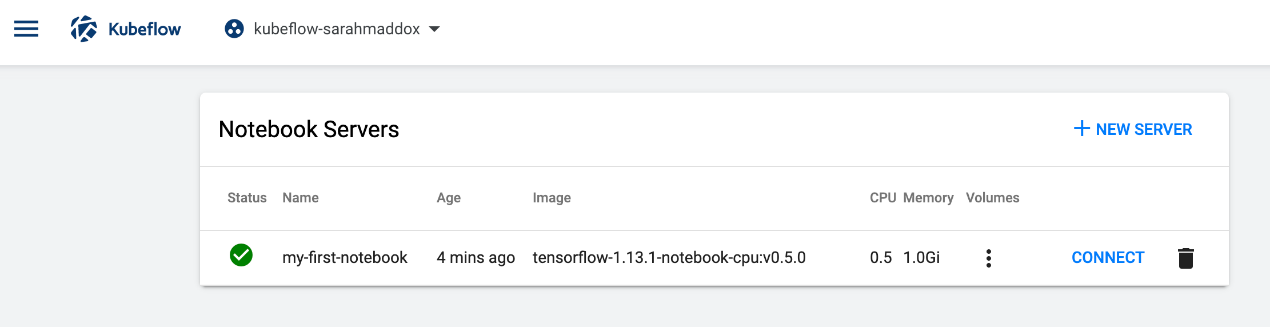

- 单击“启动LAUNCH”以创建具有指定设置的新笔记本 CRD。

- 您应该在“笔记本服务器”页面上看到新笔记本服务器Notebook Servers的条目

- “状态Status”栏中应有一个旋转指示器。

- kubernetes 可能需要几分钟的时间来配置笔记本服务器 pod。

- 您可以通过将鼠标光标悬停在“状态”列中的图标上来检查 Pod 的状态Status。

- 单击“连接CONNECT”以查看笔记本服务器显示的 web 界面。

# 3.2.3.容器图像

Kubeflow Notebook 本机支持三种类型的笔记本,JupyterLab、RStudio 和 Visual Studio Code(代码服务器),但任何基于 web 的 IDE 都应该可以工作。笔记本服务器作为 Kubernetes Pod 中的容器运行,这意味着 IDE 的类型(以及安装的软件包)取决于您为服务器选择的 Docker 映像。

# 3.2.3.1.图像

我们提供了许多示例容器图像来帮助您开始。

# 3.2.3.2.基本图像

这些图像为 Kubeflow Notebook 容器提供了一个共同的起点。查看自定义图像,了解如何使用自己的软件包扩展它们。

# 3.2.3.3.完整图像

这些图像使用数据科学家和 ML 工程师使用的通用包扩展了基础图像。

# 3.2.3.4.图像相关性图表

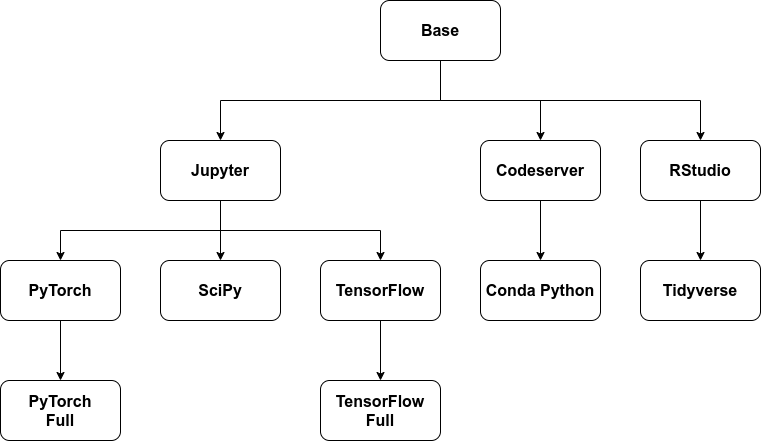

此流程图显示了我们的笔记本容器图像如何相互依赖。

# 3.2.3.5.自定义图像

用户在生成 Kubeflow Notebook 后安装的软件包只会在 pod 的生命周期内使用(除非安装到 PVC 支持的目录中)。

为了确保在 Pod 重启过程中保留软件包,用户需要:

- 生成包含它们的自定义图像,或

- 确保它们安装在 PVC 支持的目录中

图像要求

要使 Kubeflow Notebook 使用容器图像,图像必须:

- 在端口 8888 上公开 HTTP 接口:

- Kubeflow 在运行时使用我们希望容器侦听的 URL 路径设置环境变量 NB_PREFIX

- Kubeflow 使用 IFrames,因此确保您的应用程序在 HTTP 响应头中设置 Access-Control-Allow-Origin:*

- 作为名为 jovyan 的用户运行:

- jovyan 的主目录应为/home/jovyan

- jovyan 的 UID 应该是 1000

- 成功启动安装在/home/jovyan 的空 PVC:

- Kubeflow 在/home/jovyan 安装了一个 PVC,以在 Pod 重启期间保持状态

# 3.2.4.Jupyter TensorFlow 实例

# 3.2.4.1.Mnist 示例

(改编自 tensorflow/tensorflow-mnist_softmax.py)创建笔记本服务器时,选择安装了 Jupyter 和 TensorFlow 的容器映像。使用 Jupyter 的界面创建一个新的 Python3 笔记本。

复制以下代码并将其粘贴到笔记本中:

- 运行代码。您应该会看到 TensorFlow 发出的大量警告消息,后面有一行显示训练精度,如下所示:

# 3.2.5.提交 Kubernetes 资源

从笔记本提交 Kubernetes 资源

# 3.2.5.1.笔记本 Pod 服务帐户

Kubeflow 将 default-editor Kubernetes Service Account 分配给 Notebook Pods。Kubernetes 默认编辑器 Service Account 绑定到 Kubeflow edit-Cluster Role,该角色对许多 Kubernete 资源具有命名空间范围的权限。

您可以使用以下方法获取 Cluster Role/Kubeflow 编辑的 RBAC 的完整列表:

# 3.2.5.2.笔记本 Pod 中的 Kuectl

因为每个 Notebook Pod 都绑定了高度特权的默认编辑器 Kubernetes Service Account,所以您可以在其中运行 kubectl,而无需提供额外的身份验证。

例如,以下命令将创建 test.yaml 中定义的资源:

# 3.2.6.故障排除

Kubeflow Notebook 常见问题及解决方案

# 3.2.6.1.问题:笔记本未启动

解决方案:检查笔记本的事件

运行以下命令,然后检查事件部分以确保没有错误:

kubectl describe notebooks "${MY_NOTEBOOK_NAME}" --namespace "${MY_PROFILE_NAMESPACE}"

解决方案:检查 Pod 的事件

运行以下命令,然后检查事件部分以确保没有错误:

kubectl describe pod "${MY_NOTEBOOK_NAME}-0" --namespace "${MY_PROFILE_NAMESPACE}"

解决方案:检查吊舱的 YAML

运行以下命令并检查 Pod YAML 的外观是否符合预期:

kubectl get pod "${MY_NOTEBOOK_NAME}-0" --namespace "${MY_PROFILE_NAMESPACE}" -o yaml

解决方案:检查 Pod 的日志

运行以下命令从 Pod 获取日志:

kubectl logs "${MY_NOTEBOOK_NAME}-0" --namespace "${MY_PROFILE_NAMESPACE}"

# 3.2.6.2.问题:手动删除笔记本

解决方案:使用 kubectl 删除笔记本资源

运行以下命令手动删除笔记本资源:

kubectl delete notebook "${MY_NOTEBOOK_NAME}" --namespace "${MY_PROFILE_NAMESPACE}"

# 3.2.7.API Reference

# Notebook (v1)

# 3.3.Kubeflow Pipelines

# 3.3.1.Kubeflow Pipelines v1 Documentation

# 3.3.1.1.引言

Kubeflow Pipelines 是一个基于 Docker 容器构建和部署可移植、可扩展的机器学习(ML)工作流的平台。

# 3.3.1.1.1.快速启动

按照管道快速启动指南运行第一个管道。

# 3.3.1.1.2.什么是 Kubeflow 管道?

Kubeflow 管道平台包括:

- 用于管理和跟踪实验、作业和运行的用户界面(UI)。

- 用于调度多步骤 ML 工作流的引擎。

- 用于定义和操作管道和组件的 SDK。

- 使用 SDK 与系统交互的笔记本。

Kubeflow 管道的目标如下:

- 端到端编排:启用和简化机器学习管道的编排。

- 简单的实验:让您轻松尝试各种想法和技术,并管理各种试验/实验。

- 易于重用:使您能够重用组件和管道,从而快速创建端到端解决方案,而无需每次重新构建。

Kubeflow Pipelines 可作为 Kubeflow 的核心组件或独立安装。

- 了解有关安装 Kubeflow 的更多信息。^12 (opens new window)

- 了解有关独立安装 Kubeflow Pipelines 的更多信息。^13 (opens new window)

由于 kubeflow/pipelines#1700^14 (opens new window),Kubeflow pipelines 中的容器生成器目前仅为 Google 云平台(GCP)准备证书。因此,容器生成器仅支持 Google container Registry。但是,如果正确设置了获取图像的凭据,则可以将容器图像存储在其他注册表中。

# 3.3.1.1.3.什么是管道?

管道是对 ML 工作流的描述,包括工作流中的所有组件以及它们如何以图形的形式组合。(请参见下面显示管道图示例的屏幕截图。)管道包括运行管道所需的输入(参数)的定义以及每个组件的输入和输出。

开发完管道后,您可以在 Kubeflow Pipelines UI 上上传和共享它。

管道组件是一组自包含的用户代码,打包为 Docker 映像^15 (opens new window),执行管道中的一个步骤。例如,组件可以负责数据预处理、数据转换、模型训练等。

请参见管道和组件的概念指南。

# 3.3.1.1.4.管道示例

下面的截图和代码显示了 xgboost-training-cm.py 管道,它使用 CSV 格式的结构化数据创建 XGBoost 模型。您可以在 GitHub 上看到源代码^16 (opens new window)和有关管道的其他信息。

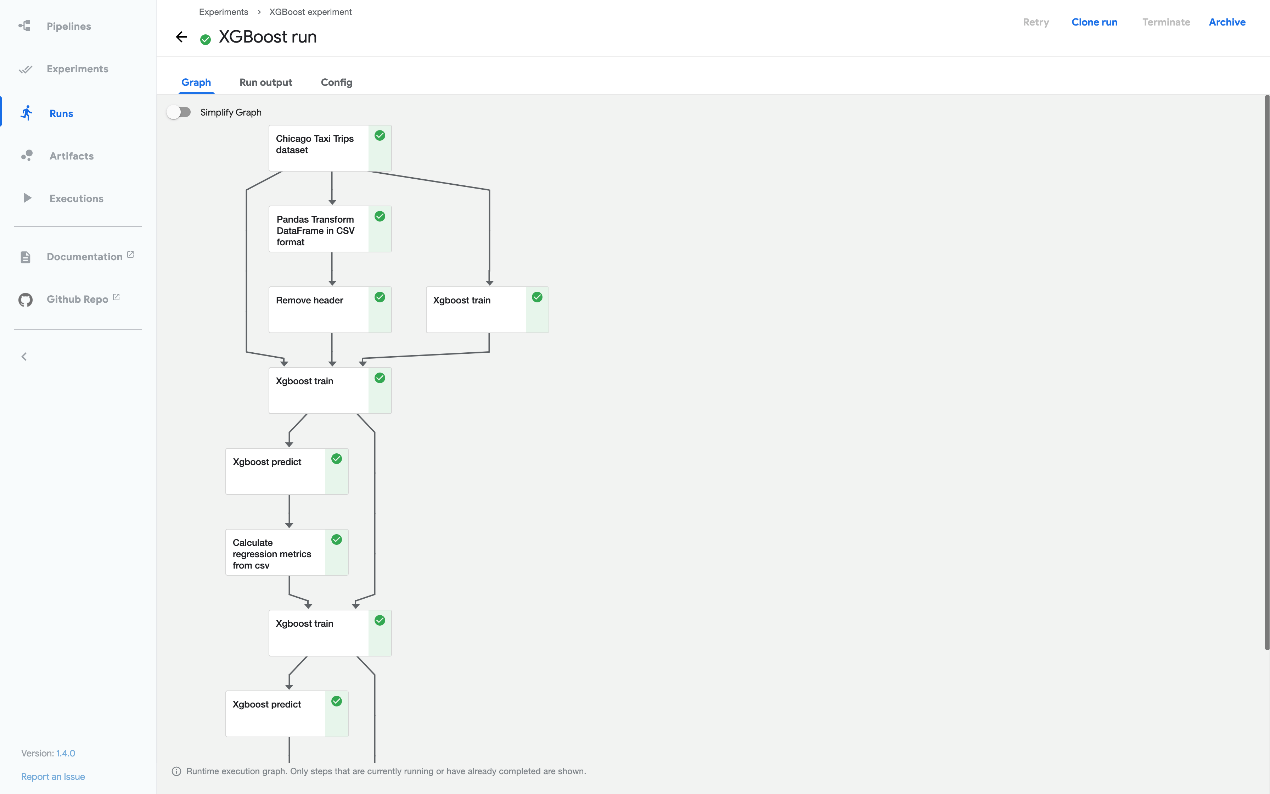

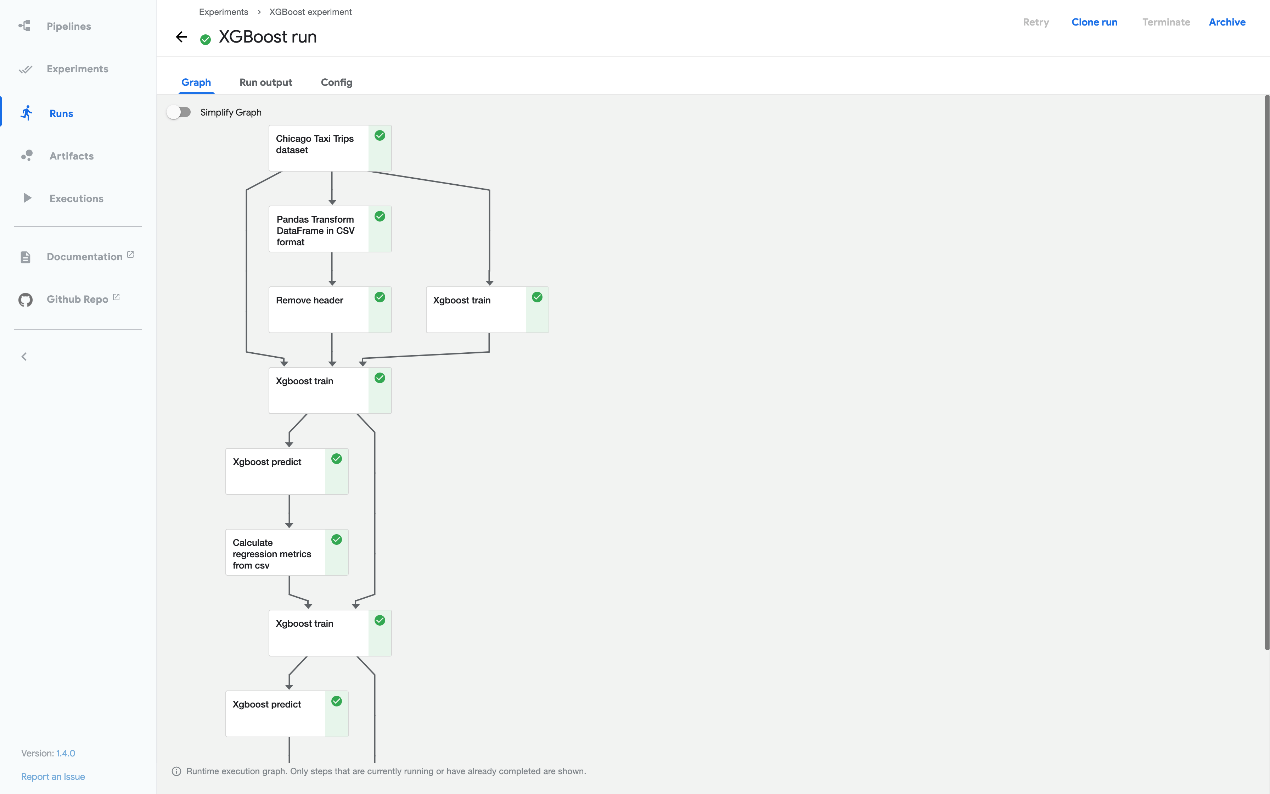

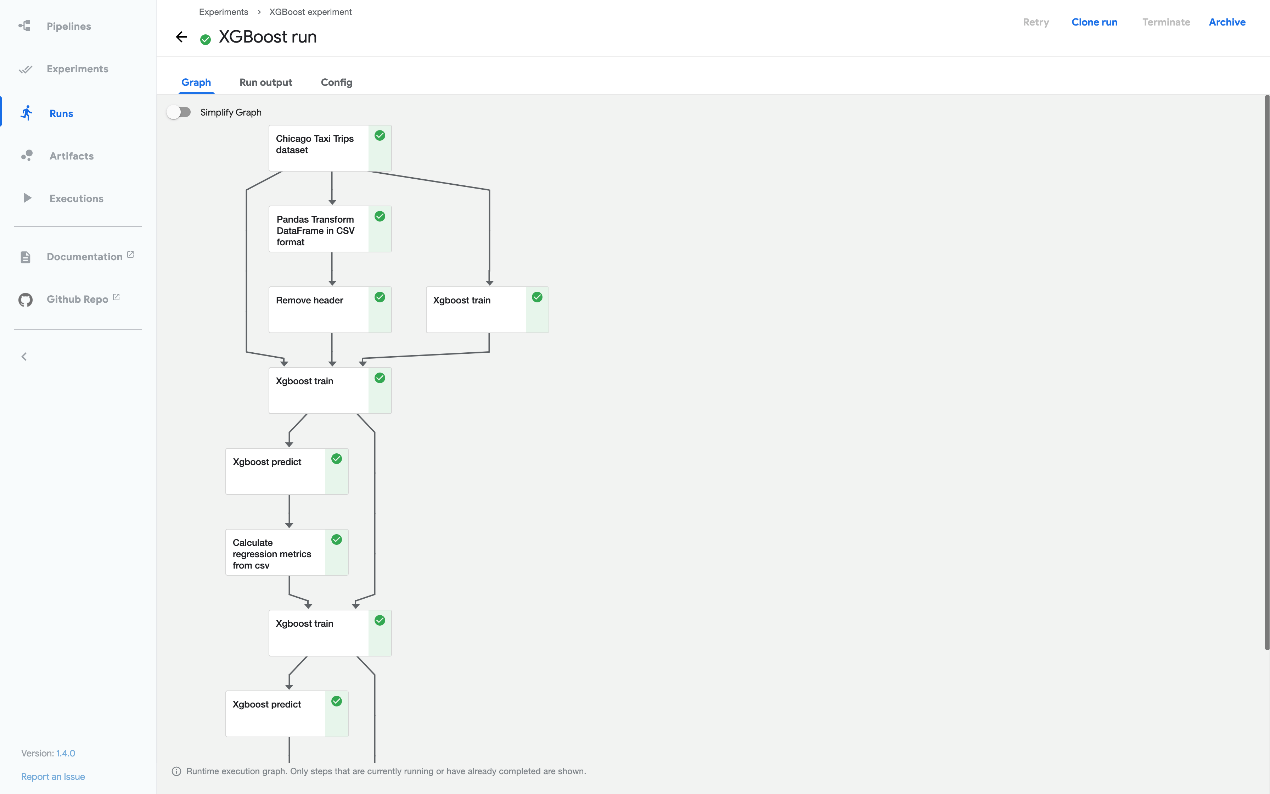

管道的运行时执行图

下面的屏幕截图显示了 Kubeflow Pipelines UI 中示例管道的运行时执行图:

# 3.3.1.1.5.表示管道的 Python 代码

下面是 Python 代码的摘录,其中定义了 xgboost 训练 cm。py 管道。你可以在 GitHub 上看到完整的代码。

@dsl.pipeline(

name='XGBoost Trainer',

description='A trainer that does end-to-end distributed training for XGBoost models.'

)

def xgb_train_pipeline(

output='gs://your-gcs-bucket',

project='your-gcp-project',

cluster_name='xgb-%s' % dsl.RUN_ID_PLACEHOLDER,

region='us-central1',

train_data='gs://ml-pipeline-playground/sfpd/train.csv',

eval_data='gs://ml-pipeline-playground/sfpd/eval.csv',

schema='gs://ml-pipeline-playground/sfpd/schema.json',

target='resolution',

rounds=200,

workers=2,

true_label='ACTION',

):

output_template = str(output) + '/' + dsl.RUN_ID_PLACEHOLDER + '/data'

# Current GCP pyspark/spark op do not provide outputs as return values, instead,

# we need to use strings to pass the uri around.

analyze_output = output_template

transform_output_train = os.path.join(output_template, 'train', 'part-*')

transform_output_eval = os.path.join(output_template, 'eval', 'part-*')

train_output = os.path.join(output_template, 'train_output')

predict_output = os.path.join(output_template, 'predict_output')

with dsl.ExitHandler(exit_op=dataproc_delete_cluster_op(

project_id=project,

region=region,

name=cluster_name

)):

_create_cluster_op = dataproc_create_cluster_op(

project_id=project,

region=region,

name=cluster_name,

initialization_actions=[

os.path.join(_PYSRC_PREFIX,

'initialization_actions.sh'),

],

image_version='1.2'

)

_analyze_op = dataproc_analyze_op(

project=project,

region=region,

cluster_name=cluster_name,

schema=schema,

train_data=train_data,

output=output_template

).after(_create_cluster_op).set_display_name('Analyzer')

_transform_op = dataproc_transform_op(

project=project,

region=region,

cluster_name=cluster_name,

train_data=train_data,

eval_data=eval_data,

target=target,

analysis=analyze_output,

output=output_template

).after(_analyze_op).set_display_name('Transformer')

_train_op = dataproc_train_op(

project=project,

region=region,

cluster_name=cluster_name,

train_data=transform_output_train,

eval_data=transform_output_eval,

target=target,

analysis=analyze_output,

workers=workers,

rounds=rounds,

output=train_output

).after(_transform_op).set_display_name('Trainer')

_predict_op = dataproc_predict_op(

project=project,

region=region,

cluster_name=cluster_name,

data=transform_output_eval,

model=train_output,

target=target,

analysis=analyze_output,

output=predict_output

).after(_train_op).set_display_name('Predictor')

_cm_op = confusion_matrix_op(

predictions=os.path.join(predict_output, 'part-*.csv'),

output_dir=output_template

).after(_predict_op)

_roc_op = roc_op(

predictions_dir=os.path.join(predict_output, 'part-*.csv'),

true_class=true_label,

true_score_column=true_label,

output_dir=output_template

).after(_predict_op)

dsl.get_pipeline_conf().add_op_transformer(

gcp.use_gcp_secret('user-gcp-sa'))

# 3.3.1.1.6.Kubeflow Pipelines UI 上的管道输入数据

下面的部分截图显示了 Kubeflow Pipelines UI,用于启动管道运行。代码中的管道定义决定了 UI 表单中显示的参数。管道定义还可以设置参数的默认值:

# 3.3.1.1.7.管道输出

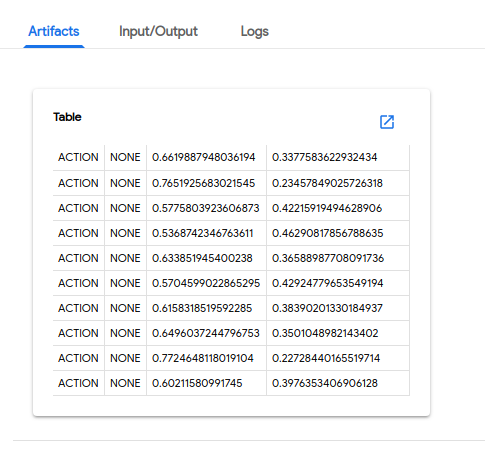

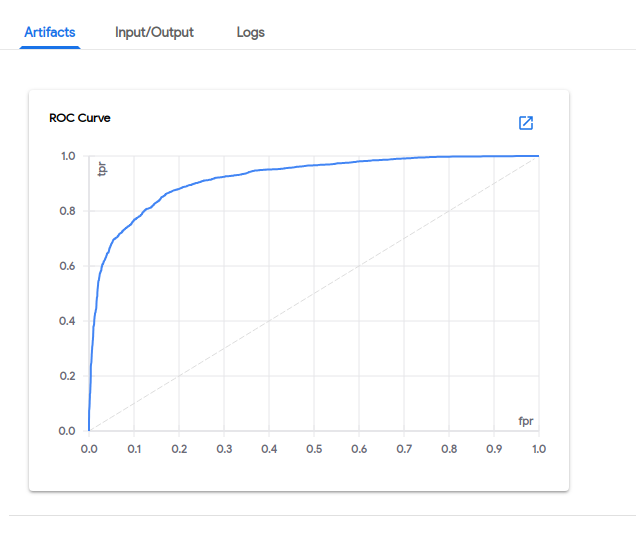

以下屏幕截图显示了 Kubeflow Pipelines UI 上可见的管道输出示例。预测结果:

混淆矩阵:

接收机工作特性(ROC)曲线:

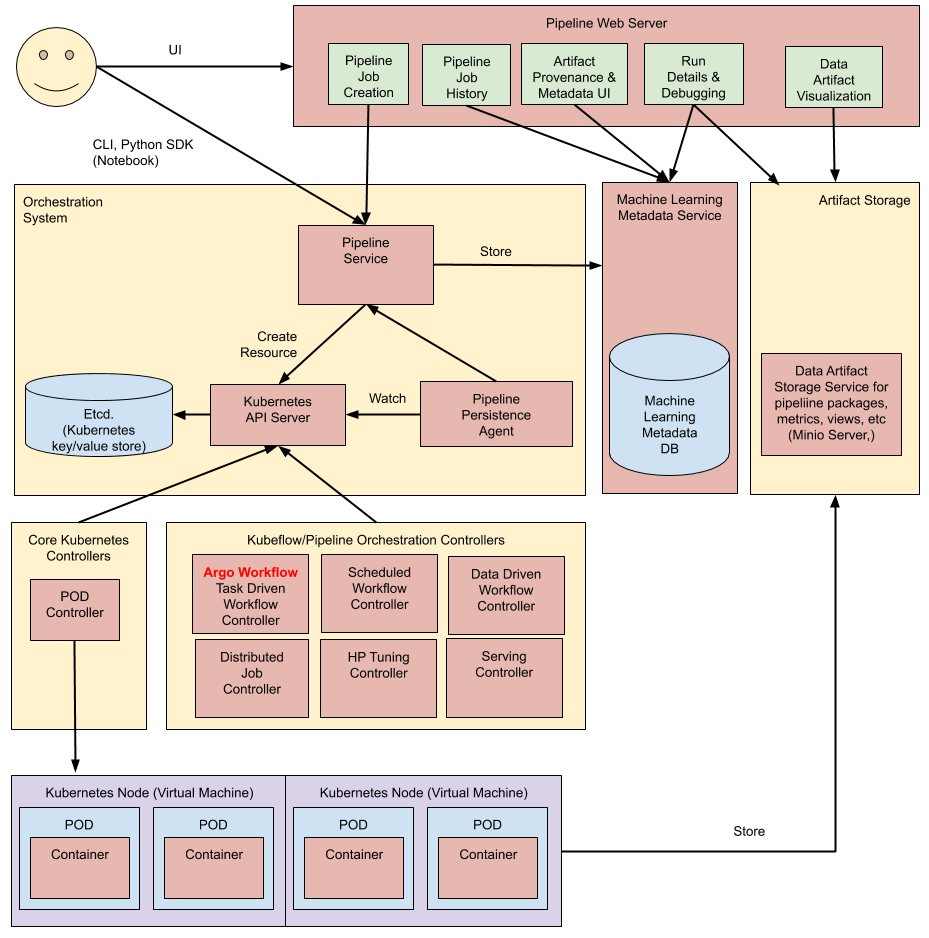

# 3.3.1.1.8.体系架构综述

在高层,管道的执行过程如下:

- **Python SDK:**您可以使用 Kubeflow Pipelines 域特定语言(DSL)创建组件或指定管道。

- **DSL 编译器:**DSL 编译器将管道的 Python 代码转换为静态配置(YAML)。

- 管道服务(Pipeline Service):调用管道服务以从静态配置创建管道运行。

- **Kubernetes 资源(Kubernetes resources):**管道服务调用 Kubernetes API 服务器来创建运行管道所需的 Kubernetes 资源(CRD)。

- **编排控制器(Orchestration controllers):**一组编排控制器执行完成管道所需的容器。容器在虚拟机上的 Kubernetes Pods 中执行。一个示例控制器是 Argo 工作流控制器,它协调任务驱动的工作流。

- 工件存储(Artifact storage):Pods 存储两种数据:

- **元数据(Metadata):**实验、作业、管道运行和单标量度量。度量数据是为了排序和过滤而聚合的。Kubeflow Pipelines 将元数据存储在 MySQL 数据库中。

- 工件(Artifacts):管道包、视图和大规模度量(时间序列)。使用大规模度量来调试管道运行或调查单个运行的性能。Kubeflow Pipelines 将工件存储在工件存储库中,如 Minio 服务器或云存储。

- MySQL 数据库和 Minio 服务器都由 Kubernetes Persistent Volume 子系统支持。

- **持久化代理和 ML 元数据:**Pipeline 持久化代理监视 Pipeline Service 创建的 Kubernetes 资源,并将这些资源的状态持久化在 ML 元数据服务中。Pipeline Persistence Agent 记录执行的容器集及其输入和输出。输入/输出由容器参数或数据工件 URI 组成。

- **管道 web 服务器:**管道 web 服务器从各种服务收集数据,以显示相关视图:当前运行的管道列表、管道执行历史、数据工件列表、有关单个管道运行的调试信息、有关单个管程运行的执行状态。

# 3.3.1.2.概述

# 3.3.1.2.1.快速启动

如果您想了解 Kubeflow Pipelines 用户界面(UI)并快速运行简单的管道,请使用本指南。

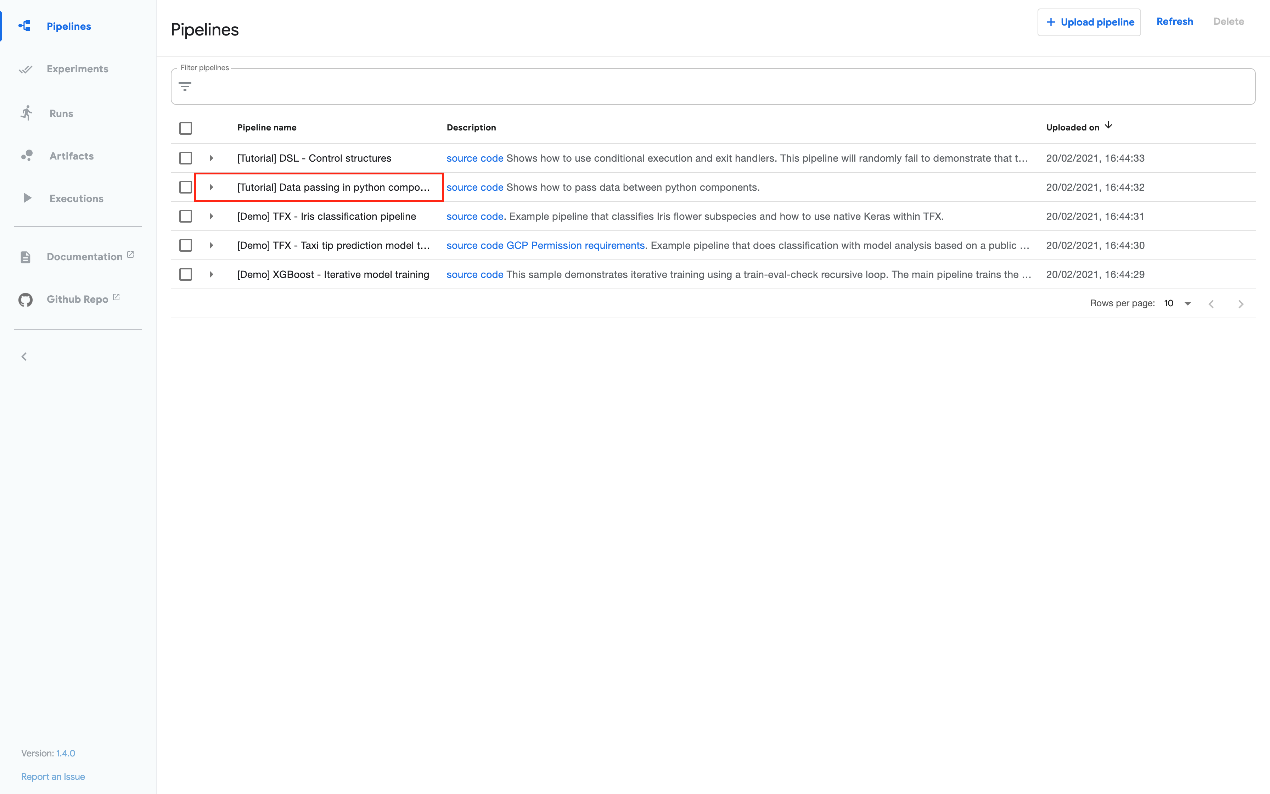

本快速入门指南的目的是展示如何使用 Kubeflow Pipelines 安装附带的两个示例,这些示例在 Kubeflow Pipelines UI 上可见。您可以使用本指南作为 Kubeflow Pipelines UI 的介绍。

3.3.1.2.1.1.部署 Kubeflow 并打开 Kubeflow Pipelines UI

有几种部署 Kubeflow Pipelines 的选项,请选择最适合您需要的选项。如果您不确定,只想尝试 Kubeflow 管道,建议从独立部署开始。

一旦您部署了 Kubeflow Pipelines,请确保您可以访问 UI。访问 UI 的步骤因用于部署 Kubeflow Pipelines 的方法而异。

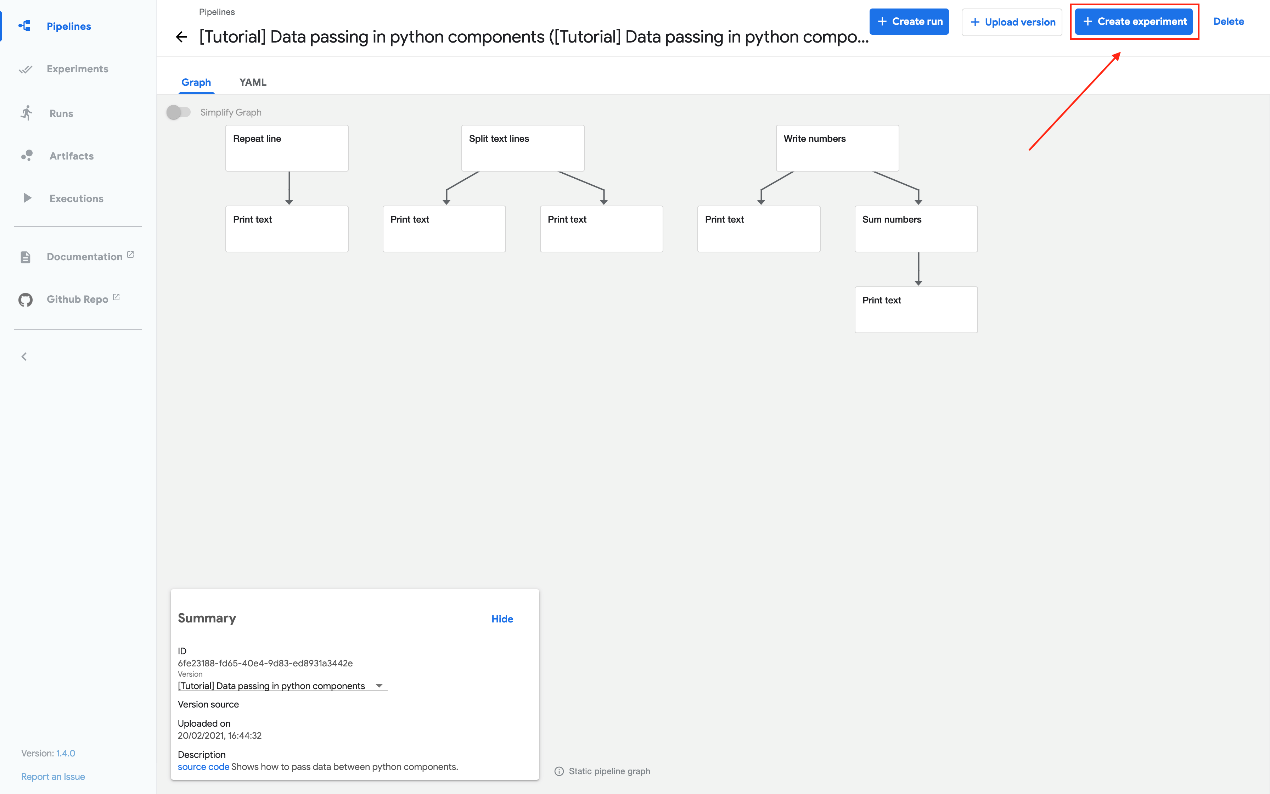

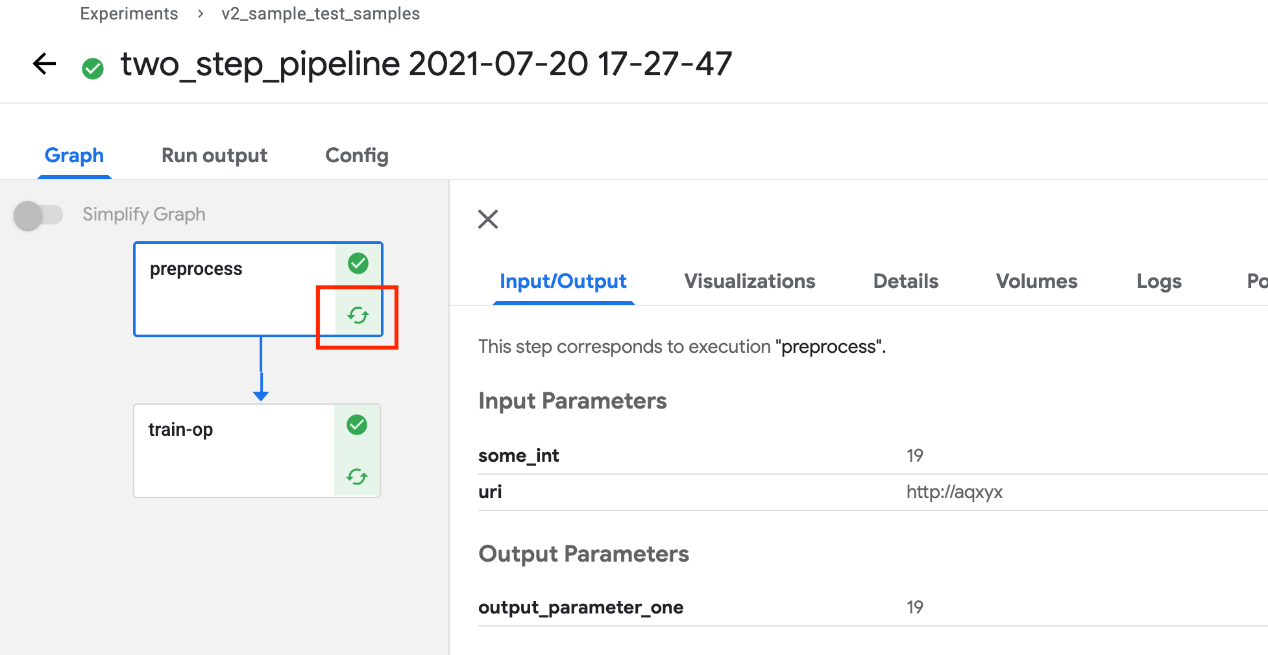

3.3.1.2.1.2.运行基本管道

Kubeflow Pipelines 提供了一些示例,您可以使用它们快速试用 Kubeflow Pipelines。下面的步骤向您展示了如何运行包含一些 Python 操作但不包含机器学习(ML)工作负载的基本示例:

- 在管道 UI 上单击示例的名称[Tutorial]Data passing in python components:

- 单击创建实验(Create experiment):

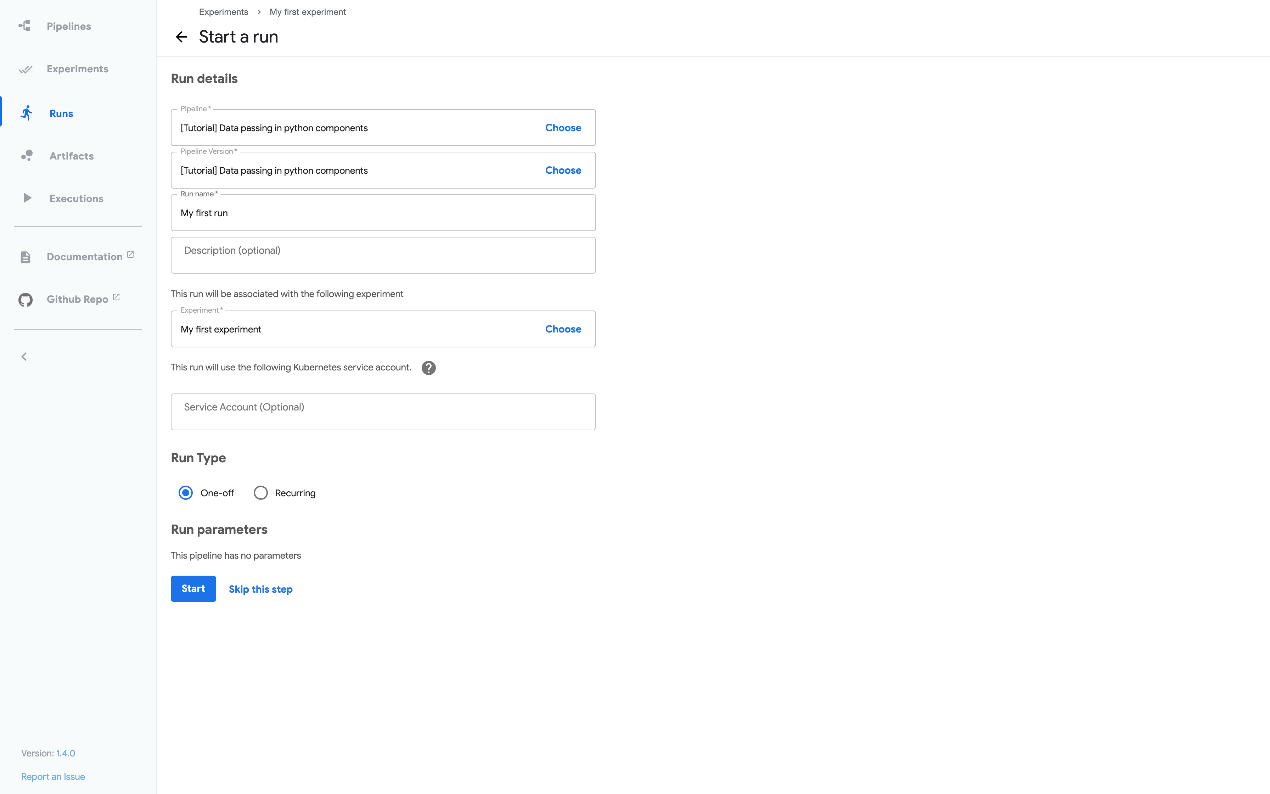

- 按照提示创建实验,然后创建运行。该示例为您所需的所有参数提供默认值。以下屏幕截图假设您已经创建了名为 My experience 的实验,现在正在创建名为 My first run 的运行(run):

- 单击“开始(Start)”以运行管道。

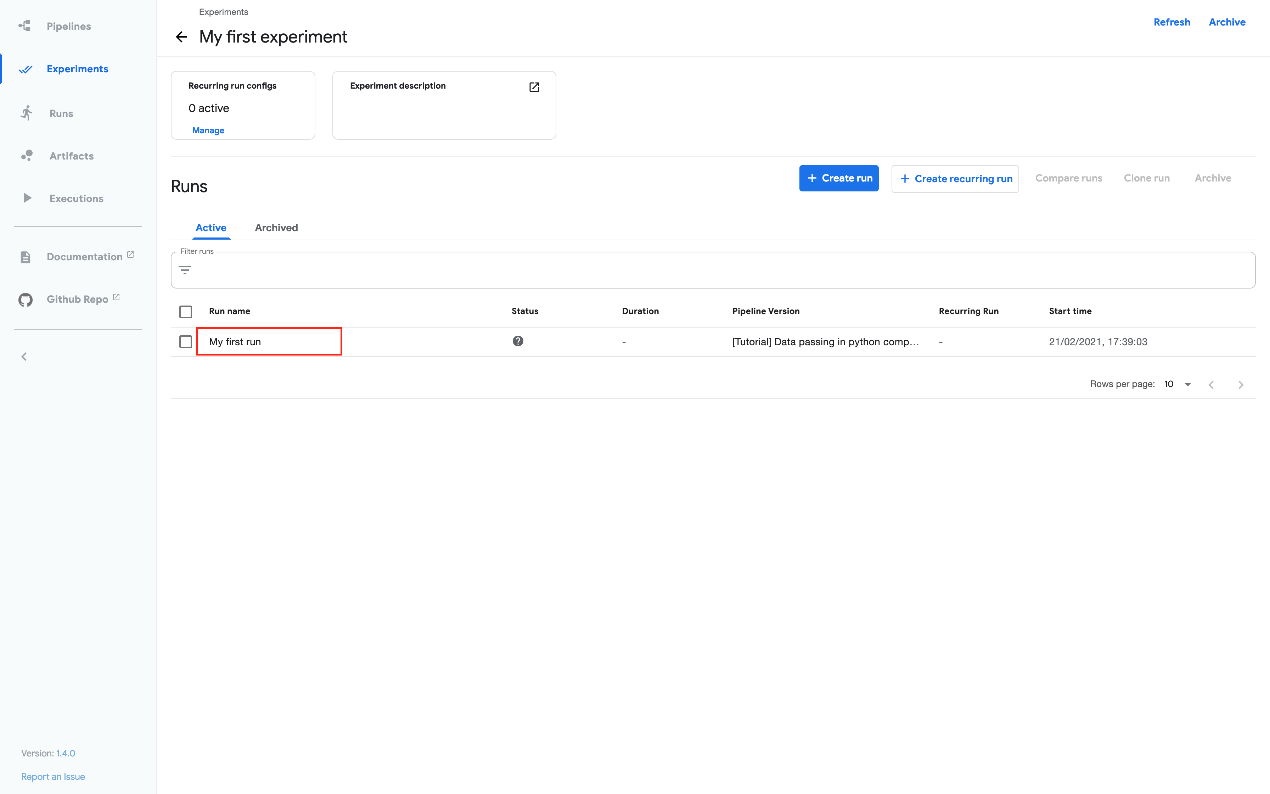

- 在实验仪表板上单击运行的名称:

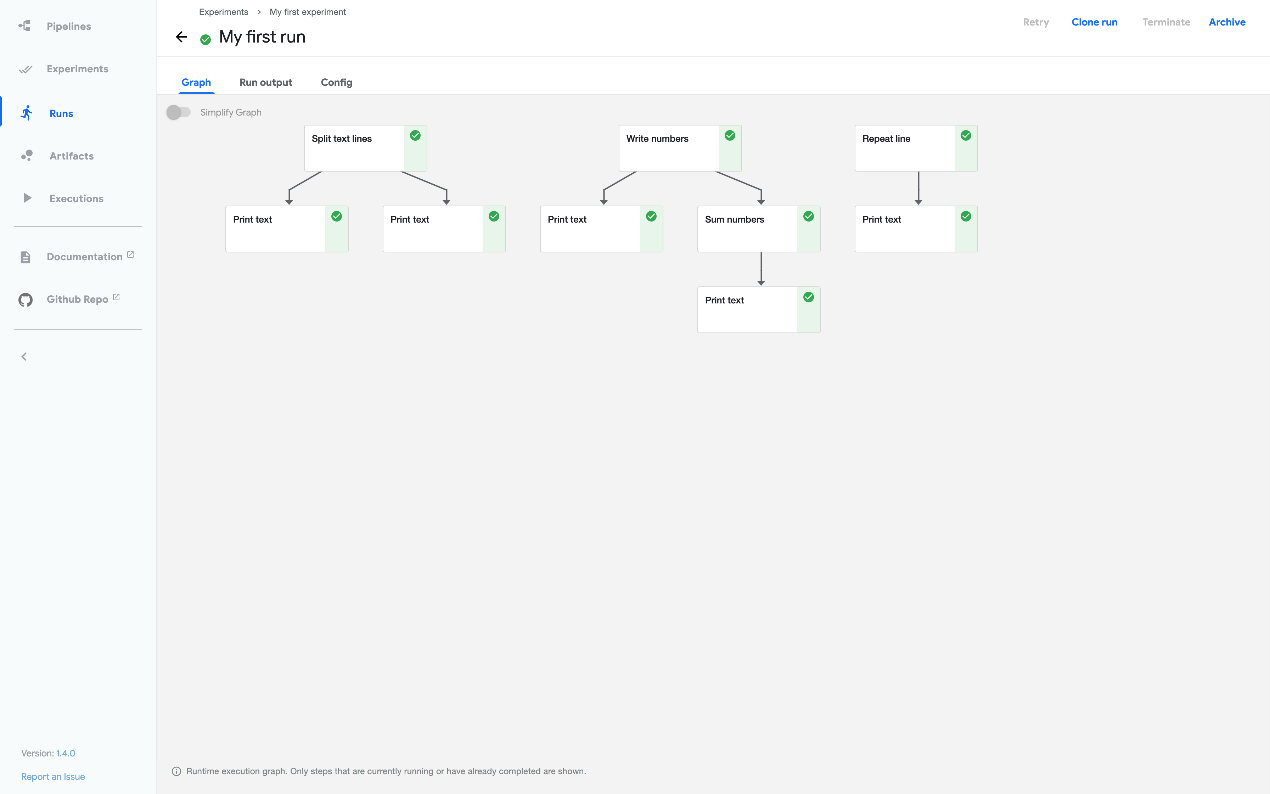

- 通过单击图形组件和其他 UI 元素,浏览图形和运行(run)的其他方面:

您可以在 Kubeflow Pipelines repo 中找到数据传入 python 组件教程的源代码^17 (opens new window)。

3.3.1.2.1.3.运行 ML 管道

本节向您展示如何从管道 UI 运行 XGBoost 示例。与上述基本示例不同,XGBoost 示例确实包含 ML 组件。按照以下步骤运行示例:

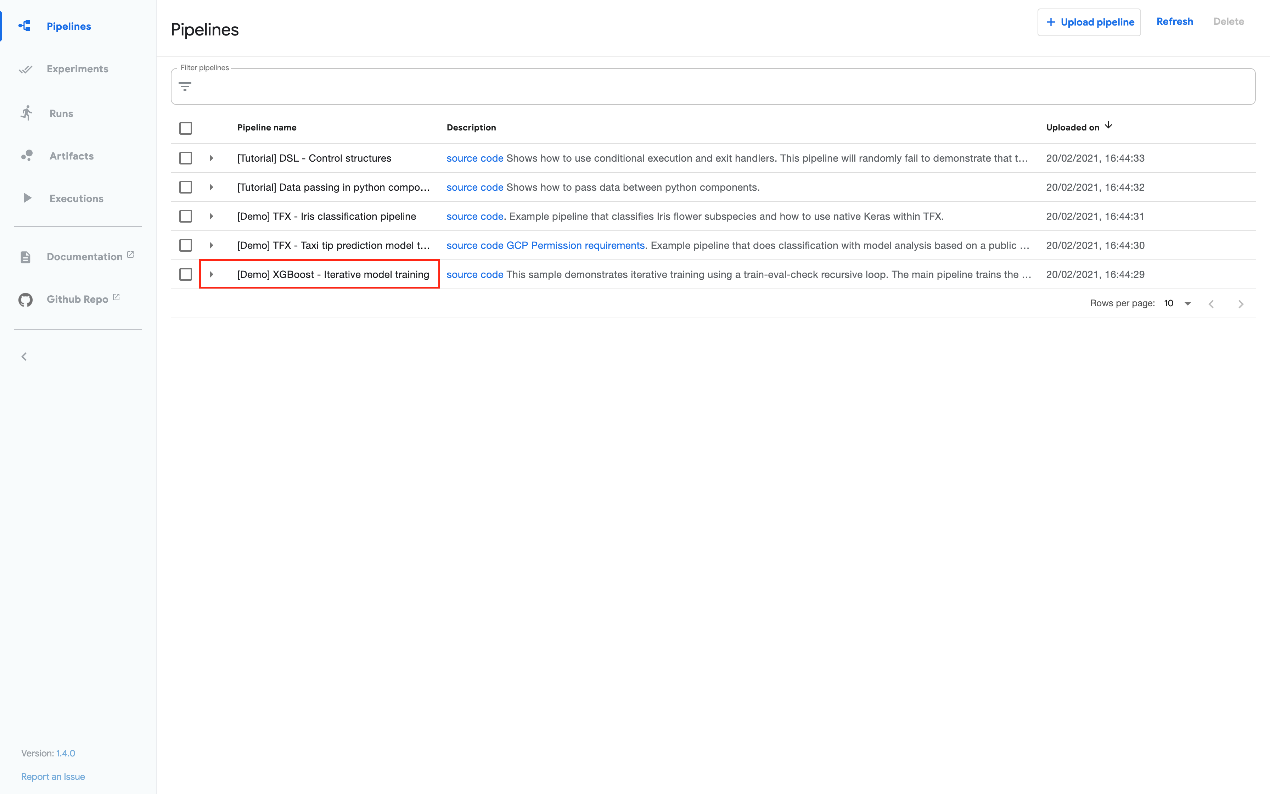

- 在管道 UI 上单击示例名称**[Demo] XGBoost - Iterative model training**训练:

- 单击创建实验(Create experiment)。

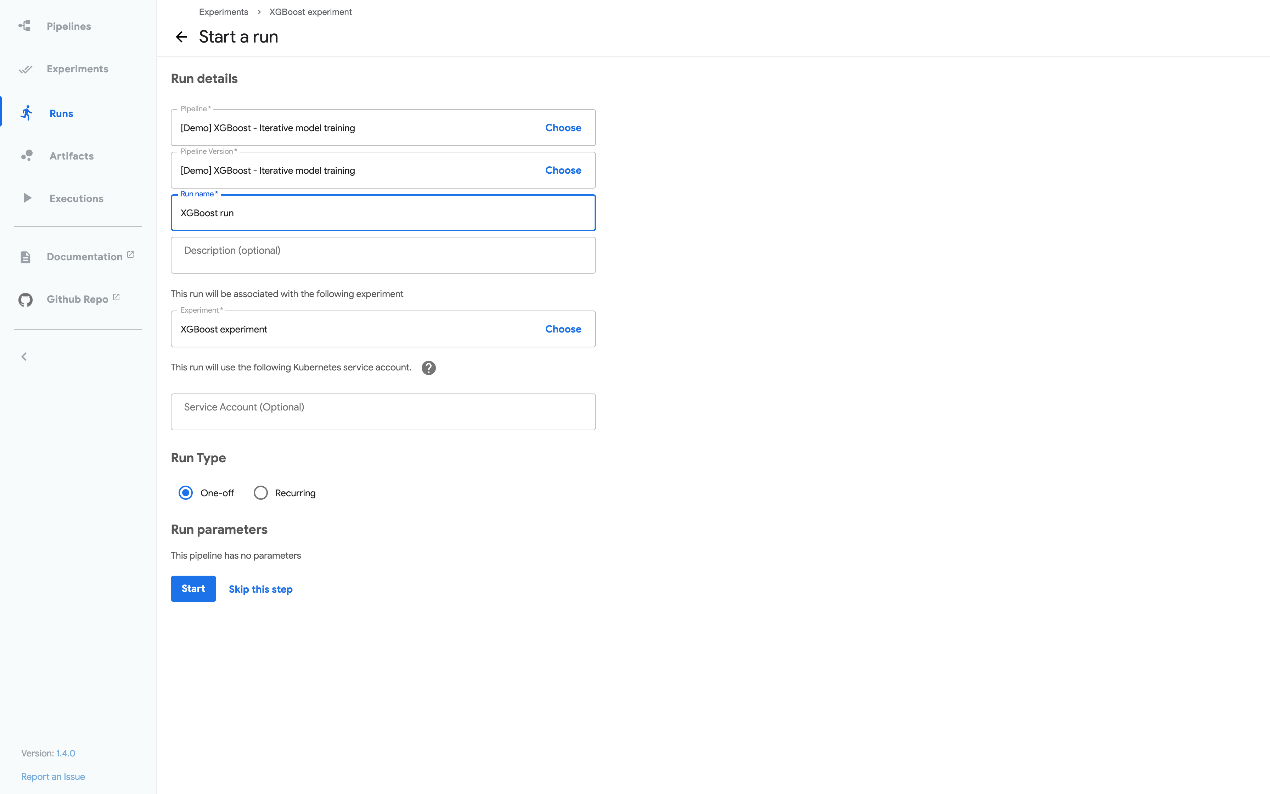

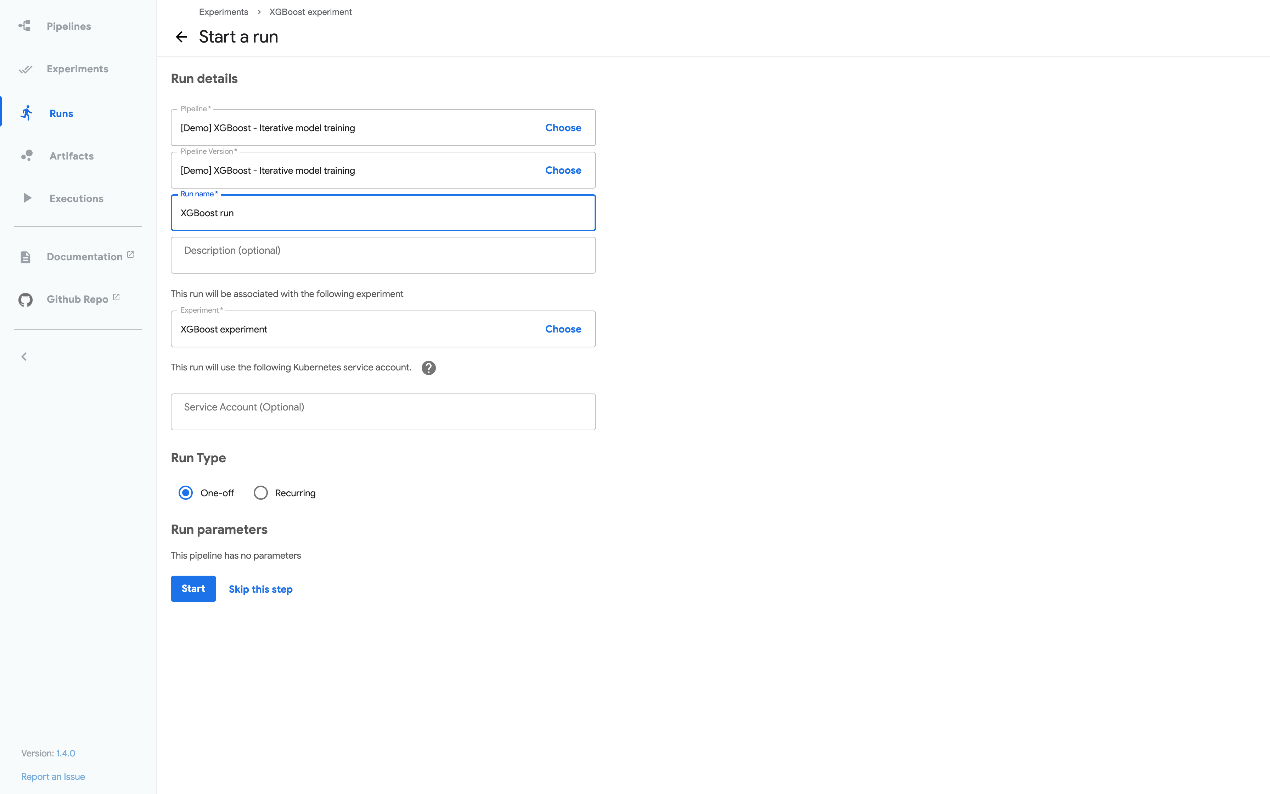

- 按照提示创建实验(experiment),然后创建运行( run)。以下屏幕截图显示了运行详细信息:

- 单击“开始”(Start)创建管路。

- 在实验仪表板上单击运行的名称。

- 通过单击图形组件和其他 UI 元素,浏览图形和跑步的其他方面。以下屏幕截图显示了管道运行完成后的部分图形:

您可以在 Kubeflow Pipelines repo 中找到 XGBoost - Iterative model training demo^18 (opens new window)源代码。

# 3.3.1.2.2.管道接口

您可以与 Kubeflow Pipelines 系统交互的方式。本页介绍了可用于使用 Kubeflow Pipelines 构建和运行机器学习(ML)工作流的界面。

3.3.1.2.2.1.用户界面(UI)

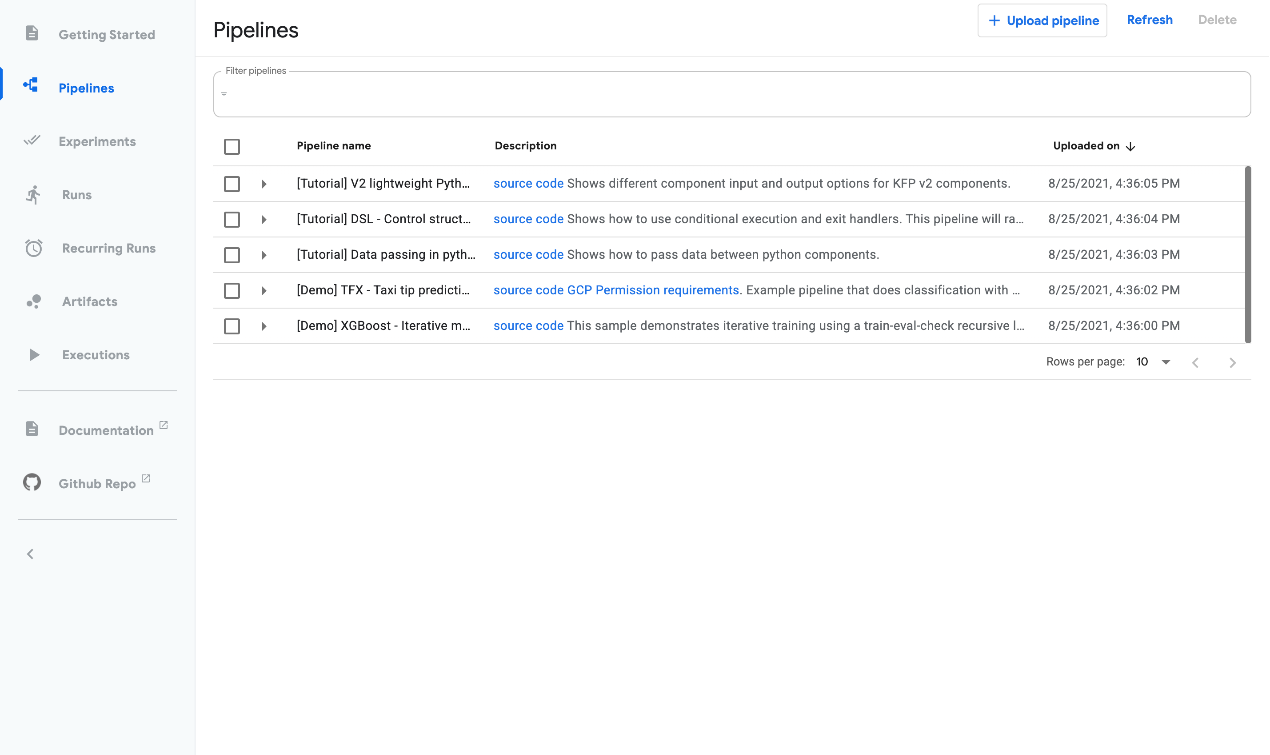

您可以通过单击 Kubeflow UI 上的 Pipeline Dashboard 来访问 Kubeflow Pipelines UI。Kubeflow Pipelines UI 如下所示:

从 Kubeflow Pipelines UI,您可以执行以下任务:

- 运行一个或多个预加载的样本以快速测试管道。

- 将管道作为压缩文件上载。管道可以是您已经构建的管道(参见如何构建管道^19 (opens new window)),也可以是某人与您共享的管道。

- 创建一个实验,对一个或多个管道运行进行分组。参见实验的定义^20 (opens new window)。

- 在实验中创建并开始跑步。运行是管道的一次执行。请参见运行的定义^21 (opens new window)。

- 查询浏览管道运行的配置、图形和输出。

- 比较实验中一次或多次运行的结果。

- 通过创建定期运行计划运行。

有关访问 Kubeflow Pipelines UI 和运行示例的更多信息,请参阅快速入门指南。

构建管道组件时,可以写出信息以显示在 UI 中。请参阅在 UI 中导出度量^22 (opens new window)和可视化结果的指南。

3.3.1.2.2.2.开发包

Kubeflow Pipelines SDK 提供了一组 Python 包,您可以使用这些包来指定和运行 ML 工作流。

请参阅 Kubeflow Pipelines SDK^23 (opens new window)的简介,了解如何使用 SDK 构建管道组件和管道。

3.3.1.2.2.3.REST API

Kubeflow Pipelines API 对于持续集成/部署系统非常有用,例如,您希望将管道执行合并到 shell 脚本或其他系统中。例如,您可能希望在新数据进入时触发管道运行。请参阅 Kubeflow Pipelines API^24 (opens new window)参考文档。

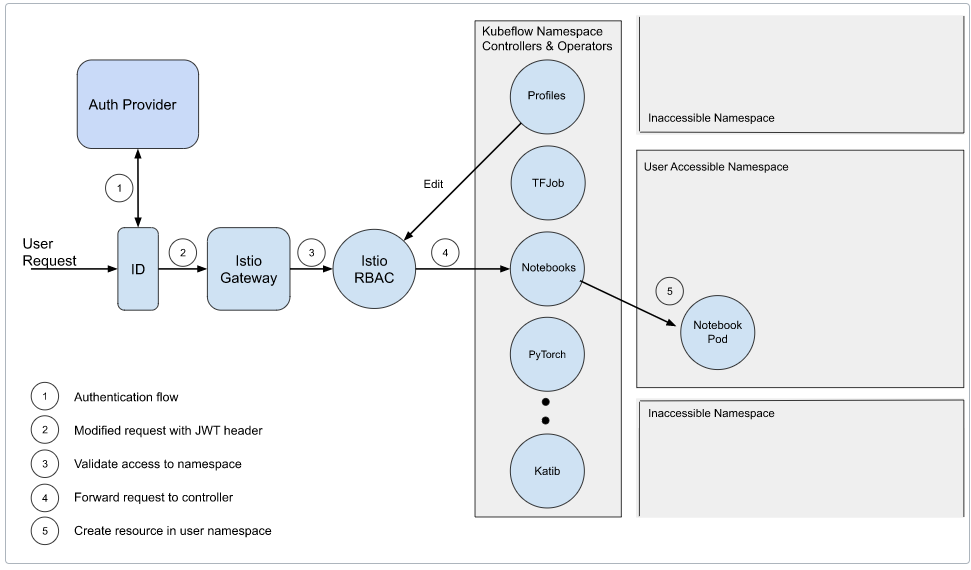

# 3.3.1.2.3.多用户隔离

Kubeflow Pipelines 中多用户隔离的工作原理。Kubeflow 管道的多用户隔离是 Kubeflow 整体多租户特性的一部分。

资源是如何分离的?

Kubeflow Pipelines 使用 Kubernetes 命名空间分离资源,这些命名空间由 Kubeflow 的 Profile 资源管理^25 (opens new window)。其他用户未经许可无法查看您的 Profile/Namespace 中的资源,因为 Kubeflow Pipelines API 服务器拒绝当前用户无权访问的命名空间请求。

“实验(Experiments)”直接属于命名空间,运行和重复运行属于其父实验的命名空间。

“管道运行(Pipeline Runs)”在用户命名空间中执行,因此用户可以利用 Kubernetes 命名空间隔离。例如,他们可以为不同命名空间中的其他服务配置不同的机密。

使用 UI 时

当您从 Kubeflow Dashboard 访问 Kubeflow Pipelines UI 时,它只显示所选命名空间中的“实验”、“运行”和“重复运行”。类似地,当您从 UI 创建资源时,它们也属于您选择的名称空间。

使用 SDK 时

如何将 Pipelines SDK 连接到 Kubeflow Pipelines 将取决于您的 Kubeflow 部署类型以及从何处运行代码。

- 完全 Kubeflow(来自集群内部)

- 完全 Kubeflow(来自集群外部)

- 独立的 Kubeflow 管道(来自集群内部)

- 独立 Kubeflow 管道(来自集群外部)

下面的 Python 代码将从完整的 Kubeflow 集群中的 Pod 创建一个实验(以及相关的运行)。

import kfp

# the namespace in which you deployed Kubeflow Pipelines

kubeflow_namespace = "kubeflow"

# the namespace of your pipelines user (where the pipeline will be executed)

user_namespace = "jane-doe"

# the KF_PIPELINES_SA_TOKEN_PATH environment variable is used when no `path` is set

# the default KF_PIPELINES_SA_TOKEN_PATH is /var/run/secrets/kubeflow/pipelines/token

credentials = kfp**.auth.ServiceAccountTokenVolumeCredentials(path=None)**

# create a client

client = kfp**.Client(host=f"http://ml-pipeline-ui.{kubeflow_namespace}",** credentials**=credentials)**

# create an experiment

client**.create_experiment(name="<YOUR_EXPERIMENT_ID>",** namespace**=user_namespace)**

print**(client.list_experiments(namespace=user_namespace))**

# create a pipeline run

client**.run_pipeline(**

experiment*id**="<YOUR_EXPERIMENT_ID>",***# the experiment determines the namespace_

job_name**="<YOUR_RUN_NAME>",**

pipelineid**=**"<YOUR_PIPELINE_ID>"# the pipeline definition to run_

)

print**(client.list_runs(experiment_id="<YOUR_EXPERIMENT_ID>"))**

print**(client.list_runs(namespace=user_namespace))**

使用 REST API 时

当调用 Kubeflow Pipelines REST API^26 (opens new window)时,实验 API 需要命名空间参数。命名空间由类型为 namespace 和 key 的“资源引用”指定。id 等于命名空间名称。以下代码使用生成的 pythonAPI 客户端创建实验和管道运行。

import kfp

from kfp_server_api import *

# the namespace in which you deployed Kubeflow Pipelines

kubeflow_namespace = "kubeflow"

# the namespace of your pipelines user (where the pipeline will be executed)

user_namespace = "jane-doe"

# the KF_PIPELINES_SA_TOKEN_PATH environment variable is used when no `path` is set

# the default KF_PIPELINES_SA_TOKEN_PATH is /var/run/secrets/kubeflow/pipelines/token

credentials = kfp**.auth.ServiceAccountTokenVolumeCredentials(path=None)**

# create a client

client = kfp**.Client(host=f"http://ml-pipeline-ui.{kubeflow_namespace}",** credentials**=credentials)**

# create an experiment

experiment**😗* ApiExperiment = client**._experiment_api.create_experiment(**

body**=ApiExperiment(**

name**="<YOUR_EXPERIMENT_ID>",**

resource_references**=[**

ApiResourceReference**(**

key**=ApiResourceKey(**

id**=user_namespace,**

type**=ApiResourceType.NAMESPACE,**

),

relationship**=ApiRelationship.OWNER,**

)

],

)

)

print**("-------- BEGIN: EXPERIMENT --------")**

print**(experiment)**

print**("-------- END: EXPERIMENT ----------")**

# get the experiment by name (only necessary if you comment out the `create_experiment()` call)

# experiment: ApiExperiment = client.get_experiment(

# experiment_name="<YOUR_EXPERIMENT_ID>",

# namespace=user_namespace

# )

# create a pipeline run

run**😗* ApiRunDetail = client**._run_api.create_run(**

body**=ApiRun(**

name**="<YOUR_RUN_NAME>",**

pipeline_spec**=ApiPipelineSpec(**

# replace <YOUR_PIPELINE_ID> with the UID of a pipeline definition you have previously uploaded

pipeline_id**="<YOUR_PIPELINE_ID>",**

),

resource_references**=[ApiResourceReference(**

key**=ApiResourceKey(**

id**=experiment.id,**

type**=ApiResourceType.EXPERIMENT,**

),

relationship**=ApiRelationship.OWNER,**

)

],

)

)

print**("-------- BEGIN: RUN --------")**

print**(run)**

print**("-------- END: RUN ----------")**

# view the pipeline run

runs**😗* ApiListRunsResponse = client**._run_api.list_runs(**

resource_reference_key_type**=ApiResourceType.EXPERIMENT,**

resource_reference_key_id**=experiment.id,**

)

print**("-------- BEGIN: RUNS --------")**

print**(runs)**

print**("-------- END: RUNS ----------")**

# 3.3.1.2.4.缓存

Kubeflow Pipelines 步骤缓存入门。

从 Kubeflow Pipelines 0.4 开始,Kubeflow pipelines 支持独立部署和 AI 平台管道中的步骤缓存功能。

开始之前

本指南告诉您 Kubeflow Pipelines 步骤缓存的基本概念以及如何使用它。本指南假设您已经安装了 Kubeflow Pipelines,或者希望使用 Kubeflow pipelines 部署指南中的选项来部署 Kubeflow Pipelines。

什么是步骤缓存?

Kubeflow Pipelines 缓存提供步骤级输出缓存。默认情况下,为通过 KFP 后端和 UI 提交的所有管道启用缓存。例外的是使用 TFXSDK 编写的管道,它有自己的缓存机制。缓存密钥计算基于组件(基本映像、命令行、代码)、传递给组件的参数(值或工件)以及任何其他自定义。如果组件完全相同,并且参数与之前的某些执行完全相同,则可以跳过该任务,并使用旧步骤的输出。可以控制缓存重用行为,管道作者可以指定考虑重用的缓存数据的最大过时性。启用缓存后,系统可以跳过已执行的步骤,从而节省时间和金钱。

禁用/启用缓存

默认情况下,在 Kubeflow Pipelines 0.4 之后启用缓存。以下是有关禁用和启用缓存服务的说明:

配置对 Kubeflow 集群的访问

使用以下说明配置 kubectl 以访问您的 Kubeflow 集群。

- 要检查是否安装了 kubectl,请运行以下命令:

which kubectl

答案应该是这样的:

/usr/bin/kubectl

如果没有安装 kubectl,请按照指南中的说明安装和设置 kubectl^27 (opens new window)。

- 按照指南配置对 Kubernetes 集群的访问。

在 Kubeflow Pipelines 部署中禁用缓存:

- 确保集群中存在更改网络连接配置(mutating webhook configuration):

export NAMESPACE=<Namespace where KFP is installed>

kubectl get mutatingwebhookconfiguration cache-webhook-${NAMESPACE}

- 更改更改 webhook 配置规则:

kubectl patch mutatingwebhookconfiguration cache-webhook-${NAMESPACE} --type='json' -p='[{"op":"replace", "path": "/webhooks/0/rules/0/operations/0", "value": "DELETE"}]'

启用缓存

- 确保集群中存在更改网络连接配置(mutatingwebhookconfiguration):

export NAMESPACE=<Namespace where KFP is installed>

kubectl get mutatingwebhookconfiguration cache-webhook-${NAMESPACE}

- 更改回更改 webhook 配置规则:

kubectl patch mutatingwebhookconfiguration cache-webhook-${NAMESPACE} --type='json' -p='[{"op":"replace", "path": "/webhooks/0/rules/0/operations/0", "value": "CREATE"}]'

管理缓存老化

默认情况下,缓存是启用的,如果您使用相同的参数执行了相同的组件,则将跳过该组件的任何新执行,并从缓存中获取输出。对于某些场景,某些组件的缓存输出数据可能会在一段时间后变得太过时,无法使用。要控制重用缓存数据的最大过时性,可以设置步骤的 max_cache_staleness 参数。max_cache_staleness 采用 RFC3339^28 (opens new window)持续时间格式(因此 30 天=“P30D”)。默认情况下,max_cache_staleness 设置为无限大,因此任何旧缓存数据都将被重用。

def some_pipeline():

# task is a target step in a pipeline

task = some_op()

task.execution_options.caching_strategy.max_cache_staleness = "P30D"

理想情况下,组件代码应该是纯的和确定性的,因为它在给定相同输入的情况下产生相同的输出。如果您的组件不是确定性的(例如,它在每次调用时返回不同的随机数),您可能希望通过将 max_cache_staleness 设置为 0 来禁用从该组件创建的任务的缓存:

def some_pipeline():

# task is a target step in a pipeline

task_never_use_cache = some_op()

task_never_use_cache.execution_options.caching_strategy.max_cache_staleness = "P0D"

更好的解决方案是使组件具有确定性。如果组件使用随机数生成,则可以将 RNG 种子作为组件输入公开。如果组件获取一些变化的数据,您可以添加时间戳或日期输入。

# 3.3.1.2.5.Caching v2

从 Kubeflow Pipelines SDK v2 和 Kubeflow pipelines 1.7.0 开始,Kubeflow Pipelines 支持独立部署和 AI 平台管道中的步骤缓存功能。

开始之前

本指南告诉您 Kubeflow Pipelines 缓存的基本概念以及如何使用它。本指南假设您已经安装了 Kubeflow Pipelines,或者希望使用《Kubeflow Pipelines 部署指南》中的独立或 AI 平台 Pipelines 选项来部署 Kubeflow Pipelines。

什么是步骤缓存?

Kubeflow Pipelines 缓存提供了步骤级输出缓存,该过程通过跳过在前一次管道运行中完成的计算来帮助降低成本。默认情况下,使用 kfp.dsl.PipelineExecutionMode.V2_COMPATIBLE 模式为使用 Kubeflow pipelines SDK v2^29 (opens new window)构建的管道的所有任务启用缓存。当 Kubeflow Pipeline 运行管道时,它会检查 Kubeflow Pipeline 中是否存在执行,以及每个管道任务的接口。任务的接口定义为管道任务规范(基本图像、命令、参数)、管道任务的输入(工件的名称和 id、参数的名称和值)和管道任务的输出规范(工件和参数)的组合。注意:如果生成工件的生产者任务未被缓存,则生产者任务将生成具有不同 ID 的新工件,而使用生产者任务生成的工件的下游任务将不会命中缓存。

如果 Kubeflow Pipelines 中有匹配的执行,则使用该执行的输出,并跳过该任务。缓存被命中的示例:

禁用/启用缓存

默认情况下,Kubeflow Pipelines SDK v2 使用 kfp.dsl.PipelineExecutionMode.V2_COMPATIBLE 启用缓存。

可以为使用 Python 创建的管道运行关闭执行缓存。使用 create_run_from_pipeline_func^30 (opens new window)或 create_run_from_pipeine_package^31 (opens new window)或 run_pipeline^32 (opens new window)运行管道时,可以使用 enable_caching 参数指定此管道运行不使用缓存。

# 3.3.1.2.6.Pipeline Root

从 Kubeflow Pipelines SDKv2 和 Kubeflow Pipelines 1.7.0 开始,Kubeflow Pipelines 支持一个新的中间工件库功能:独立部署^33 (opens new window)和 AI 平台管道^34 (opens new window)中的管道根。

3.3.1.2.6.1.开始之前

本指南告诉您 Kubeflow Pipelines 管道根的基本概念以及如何使用它。本指南假设您已经安装了 Kubeflow Pipelines,或者希望使用《Kubeflow Pipelines 部署指南》中的独立或 AI 平台 Pipelines 选项来部署 Kubeflow Pipelines。

3.3.1.2.6.2.什么是管道根?

Pipeline 根表示一个工件库,Kubeflow Pipelines 存储管道的工件。该功能支持使用 Go CDK^35 (opens new window)的 MinIO、S3 和 GCS。在 S3 和 GCS 中,当 Kubeflow Pipelines 与其他系统集成时,可以更容易地访问工件。

**注意:**对于 MinIO,不能更改 MinIO 实例。Kubeflow Pipelines 只能使用自己部署的 Minio 实例。(如果需要指定 Minio 实例,请点击此 GitHub 问题^36 (opens new window)。)

3.3.1.2.6.3.如何配置管道根身份验证

最小 IO

您不需要通过 MinIO 的身份验证。Kubeflow Pipelines 配置了与自己一起部署的 MinIO 实例的身份验证。

GCS

如果要指定 GCS 的管道根:检查身份验证管道^37 (opens new window)。

S3

如果要指定 S3 的管道根,请选择以下选项之一:

- 通过 AWS IRSA:

- 通过 kfp-sdk:dsl.get_pipeline_conf().add_op_transformer(aws.use_aws_secret('xxx'、'xxx'和'xxx'))

参考文献:

加法运算变压器

使用 aws 秘密

3.3.1.2.6.4.如何配置管道根

通过配置映射

您可以通过更改 Kubernetes 命名空间中 ConfigMaps kfp-launcher 的 defaultPipelineRoot 条目来为 Kubeflow Pipelines 配置默认管道根。

kubectl edit configMap kfp-launcher -n ${namespace}

此管道根将是 Kubernetes 命名空间中运行的所有管道的默认管道根,除非您使用以下选项之一覆盖它:

通过建筑管道

构建管道时^38 (opens new window),可以通过 kfp.dsl.pipeline 注释配置管道根

通过 SDK 提交管道

使用以下方法之一提交管道时,可以通过 pipeline_root 参数配置管道根:

- 创建 run_from_pipeline_func^39 (opens new window)

- 创建 run_from_pipeline_package^40 (opens new window)

- run_pipeline^41 (opens new window)。

3.3.1.2.6.5.通过提交管道直通 UI

在 UI 中提交管道运行时,可以通过 pipeline_root 运行参数配置管道根。

# 3.3.1.3.概念

# 3.3.1.3.1.管道

流水线是机器学习(ML)工作流的描述,包括工作流中的所有组件^42 (opens new window)以及这些组件如何以图^43 (opens new window)形的形式相互关联。管道配置包括运行管道所需的输入(参数)以及每个组件的输入和输出的定义。

当您运行管道时,系统会启动一个或多个 Kubernetes Pod,对应于工作流(管道)中的步骤^44 (opens new window)(组件)。Pods 启动 Docker 容器,容器反过来启动程序。开发完管道后,您可以使用 Kubeflow Pipelines UI 或 Kubeflow Pipelines SDK 上传管道。

# 3.3.1.3.2.部件 Component

管道组件是一组自包含的代码,用于执行 ML 工作流(管道)中的一个步骤,例如数据预处理、数据转换、模型训练等。组件类似于函数,因为它具有名称、参数、返回值和主体。

3.3.1.3.2.1.部件代码

每个组件的代码包括以下内容:

- 客户端代码:与端点对话以提交作业的代码。例如,与 Google Dataproc API 对话以提交 Spark 作业的代码。

- 运行时代码:执行实际作业并通常在集群中运行的代码。例如,将原始数据转换为预处理数据的 Spark 代码。

请注意名为“mytask”的任务的客户端代码和运行时代码的命名约定:

mytask.py 程序包含客户端代码。

mytask 目录包含所有运行时代码。

3.3.1.3.2.2.组件定义

YAML 格式的组件规范描述了 KubeflowPipelines 系统的组件。组件定义包含以下部分:

- 元数据(Metadata):名称、描述等。

- 接口(Interface):输入/输出规范(名称、类型、描述、默认值等)。

- 实现(Implementation):给定组件输入的一组参数值,说明如何运行组件。实现部分还描述了在组件完成运行后如何从组件获取输出值。

有关组件的完整定义,请参阅组件规范^45 (opens new window)。

3.3.1.3.2.3.集装箱化组件(Containerizing components)

您必须将组件打包为 Docker 映像^46 (opens new window)。组件表示容器内的特定程序或入口点。

管道中的每个组件都独立执行。这些组件不在同一进程中运行,并且不能直接共享内存数据。您必须将在组件之间传递的所有数据片段序列化(到字符串或文件),以便数据可以通过分布式网络传输。然后必须对数据进行反序列化,以便在下游组件中使用。

# 3.3.1.3.3.图表

Kubeflow 管道中图形的概念概述。

图形是 Kubeflow Pipelines UI 中管道运行时执行的图形表示。该图显示了管道运行已执行或正在执行的步骤,箭头指示了每个步骤所表示的管道组件之间的父/子关系。运行开始后即可查看图形。图中的每个节点对应于管道中的一个步骤,并相应地标记。

下面的屏幕截图显示了一个管道图示例:

每个节点的右上方都有一个图标,指示其状态:运行、成功、失败或跳过。(当节点的父级包含条件子句时,可以跳过该节点。)

# 3.3.1.3.4.实验

实验(experiment )是一个工作区,您可以在其中尝试不同的管道配置。您可以使用实验将跑步组织成逻辑组。实验可以包含任意运行,包括重复运行^47 (opens new window)(recurring runs)。

# 3.3.1.3.5.运行和定期运行(Run and Recurring Run)

Kubeflow 管道运行的概念概述

运行是管道的一次执行。运行包含您尝试的所有实验的不可变日志,并且设计为独立的,以允许重复性。您可以通过查看 Kubeflow Pipelines UI 上的详细信息页面来跟踪运行的进度,在那里可以看到运行时图形、输出工件和运行中每个步骤的日志。

Kubeflow Pipelines 后端 API 中的重复运行或作业是管道的可重复运行。循环运行的配置包括指定了所有参数值的管道副本和运行触发器。您可以在任何实验中开始重复运行,它将定期启动运行配置的新副本。您可以从 Kubeflow Pipelines UI 启用/禁用重复运行。您还可以指定并发运行的最大次数,以限制并行启动的运行次数。如果管道预计会运行很长一段时间,并且被触发频繁运行,这可能会很有帮助。

# 3.3.1.3.6.运行触发器(Run Trigger)

Kubeflow 管道中运行触发器的概念概述

运行触发器是一个标志,它告诉系统循环运行配置何时产生新的运行。以下类型的运行触发器可用:

- 周期性:用于基于间隔的运行调度(例如:每 2 小时或每 45 分钟)。

- Cron:用于为调度运行指定 Cron 语义。

# 3.3.1.3.7.步(step)

步骤是执行管道中的一个组件。步骤与其组件之间的关系是实例化的关系,非常类似于运行与其管道之间的关系。在复杂的管道中,组件可以在循环中多次执行,或者在解析管道代码中的 if/else 类子句后有条件地执行。

# 3.3.1.3.8.输出工件

Kubeflow Pipelines 中输出工件的概念概述

输出工件是由管道组件发出的输出,Kubeflow Pipelines UI 可以理解并呈现为丰富的可视化效果。管道组件包含工件是非常有用的,这样您就可以提供性能评估、运行的快速决策或不同运行之间的比较。人工制品还可以理解管道的各种组件是如何工作的。工件的范围可以从简单的数据文本视图到丰富的交互式可视化。

# 3.3.1.3.9.ML 元数据

Kubeflow Pipelines 中元数据的概念概述

**注意:**Kubeflow Pipelines 已经从使用 Kubeflow/metadata 转向使用 google/ml 元数据作为元数据依赖。

Kubeflow Pipelines 后端在元数据存储中存储管道运行的运行时信息。运行时信息包括任务的状态、工件的可用性、与执行或工件相关的自定义属性等。

如果不同运行中的多个执行正在使用一个工件,则可以查看管道运行中工件和执行之间的连接。这种连接可视化称为线型图。

# 3.3.1.4.安装 Installation

# 3.3.1.4.1.安装选项

Kubeflow Pipelines 提供了一些安装选项。本页介绍每个选项的选项和可用功能:

- Kubeflow Pipelines Standalone^48 (opens new window)是仅包含 Kubeflow 管道的最小便携式安装。

- Kubeflow Pipelines 作为完整 Kubeflow 部署的一部分^49 (opens new window),提供了所有 Kubeflow 组件以及与每个平台的更多集成。

- 测试版:谷歌云 AI 平台管道通过在谷歌云控制台上提供管理 UI,使在谷歌云上安装和使用 Kubeflow Pipelines 变得更加容易。

- 用于测试目的的本地^50 (opens new window)Kubeflow Pipelines 部署。

3.1.4.1.3.1.1.选择安装选项

- 除了管道之外,是否要使用其他 Kubeflow 组件?如果是,请选择完整的 Kubeflow 部署^51 (opens new window)。

- 您可以使用 cloud/prem Kubernetes 集群吗?如果不能,您应该尝试在本地 Kubernetes 集群上使用 Kubeflow Pipelines 进行学习和测试,方法是遵循在本地集群上部署 Kubeflow pipelines 中的步骤。

- 您想在多用户支持下使用 Kubeflow Pipelines 吗?如果是,请选择版本>=v1.1 的完整 Kubeflow 部署。

- 你在谷歌云上部署吗?

如果是,则部署 Kubeflow Pipelines Standalone。您还可以使用 Google Cloud AI Platform Pipelines 使用用户界面部署 Kubeflow Pipelines,但在可定制性和可升级性方面存在限制。有关详细信息,请阅读相应章节。

- 您可以在其他平台上部署。

在做出决定之前,请将您特定于平台的完整 Kubeflow 与 Kubeflow 独立管道进行比较。

**警告:**请谨慎选择安装选项,当前没有支持在不同安装选项之间迁移数据的路径。如果这对你很重要,请创建一个 GitHub 问题。

3.1.4.1.3.1.2.Kubeflow 独立管道

使用此选项可以将 Kubeflow Pipelines 部署到本地、云甚至本地 Kubernetes 集群,而不需要 Kubeflow 的其他组件。要部署 Kubeflow Pipelines Standalone,您只能使用 kustosize 清单。这个过程使得定制部署和将 Kubeflow Pipelines 集成到现有的 Kubernetes 集群中变得更加简单。

安装指南

Kubeflow Pipelines 独立部署指南

接口:

- Kubeflow 管道 UI

- Kubeflow 管道 SDK

- Kubeflow 管道 API

- Kubeflow Pipelines 端点仅为 Google Cloud 自动配置。

如果您希望在其他平台上部署 Kubeflow Pipelines,您可以通过 kubectl 端口转发访问它,也可以自己配置自己的特定于平台的授权端点。

发布时间表

Kubeflow Pipelines Standalone 可用于每个 Kubeflow Pipelines 版本。您将可以访问最新功能。

升级支持(Beta 版)

升级 Kubeflow Pipelines Standalone 介绍了如何就地升级。

谷歌云集成:

- 自动为您配置了具有身份验证支持的 Kubeflow Pipelines 公共端点。

- 通过云控制台 AI 平台管道仪表板中的开放管道仪表板链接打开 Kubeflow 管道 UI。

- (可选)您可以选择将数据保存在 Google 云管理存储(云 SQL 和云存储)中。

- 支持对 Google Cloud 进行身份验证的所有选项。

具体功能说明:

- 部署后,Kubernetes 集群仅包含 Kubeflow Pipelines。它不包括其他 Kubeflow 组件。例如,要使用 Jupyter 笔记本,您必须在云服务(如 AI 平台笔记本)中使用本地笔记本或托管笔记本。

- Kubeflow Pipelines 多用户支持在单机版中不可用,因为多用户支持依赖于其他 Kubeflow 组件。

完全 Kubeflow 部署

使用此选项可以将 Kubeflow Pipelines 部署到本地计算机、本地或云,作为完整 Kubeflow 安装的一部分。

安装指南

Kubeflow 安装指南

接口:

- Kubeflow 用户界面

- Kubeflow UI 内部或外部的 Kubeflow Pipelines UI

- Kubeflow 管道 SDK

- Kubeflow 管道 API

- 其他 Kubeflow API

- Kubeflow Pipelines 端点自动配置,每个平台都支持身份验证

发布时间表

完整的库贝洛每季度发布一次。它在接收 Kubeflow Pipelines 更新时有明显延迟。

| Kubeflow Version | Kubeflow Pipelines Version |

|---|---|

| 0.7.0 | 0.1.31 |

| 1.0.0 | 0.2.0 |

| 1.0.2 | 0.2.5 |

| 1.1.0 | 1.0.0 |

| 1.2.0 | 1.0.4 |

| 1.3.0 | 1.5.0 |

| 1.4.0 | 1.7.0 |

注意:Google Cloud、AWS 和 IBM Cloud 支持 Kubeflow Pipelines 1.0.0 和多用户分离。其他平台目前可能不是最新的,请参阅此 GitHub 问题以了解状态。

升级支持:请参阅 Google Cloud 指南中升级 Kubeflow Pipelines 的完整 Kubeflow 章节。

谷歌云集成:

- 使用云身份感知代理为您自动配置具有身份验证支持的 Kubeflow Pipelines 公共端点。

- 当前不支持将数据持久化在 Google 云托管存储(云 SQL 和云存储)中。有关最新状态,请参阅此 GitHub 问题。

- 您可以使用 Workload Identity 向 Google Cloud 进行身份验证。

具体功能说明:

- 部署后,Kubernetes 集群包括所有 Kubeflow 组件。例如,您可以使用与 Kubeflow 一起部署的 Jupyter 笔记本服务在 Kubeflow 集群中创建一个或多个笔记本服务器。

- Kubeflow Pipelines 多用户支持仅在完整的 Kubeflow 中可用。它支持使用一个 Kubeflow Pipelines 控制平面来协调多个用户命名空间中的用户管道运行,并获得授权。

- 最新的功能和 bug 修复可能不会很快出现,因为发布周期很长。

谷歌云 AI 平台管道

使用此选项将 Kubeflow Pipelines 部署到 Google 云市场中的 Google Kubernetes Engine(GKE)。您可以将 Kubeflow Pipelines 部署到现有或新的 GKE 集群,并在 GoogleCloud 中管理集群。

安装指南

Google Cloud AI 平台管道文档

接口:

- 用于管理 Kubeflow Pipelines 集群和其他 Google 云服务的 Google 云控制台

- 通过 Google 云控制台中的 Open Pipelines Dashboard 链接,Kubeflow Pipelines UI

- 云笔记本中的 Kubeflow Pipelines SDK

- 为您自动配置实例的 Kubeflow Pipelines 端点

发布时间表

AI Platform Pipelines 可用于一组选定的稳定 Kubeflow Pipelines 版本。您将收到比 Kubeflow Pipelines Standalone 稍慢的更新。

升级支持(Alpha)

不支持就地升级。

要通过重新安装(使用现有数据)升级 AI 平台管道,请参阅《升级 AI 平台管线》指南。

谷歌云集成:

- 您可以在云控制台 UI 上部署 AI 平台管道。

- 自动为您配置了具有身份验证支持的 Kubeflow Pipelines 公共端点。

- (可选)您可以选择将数据保存在 Google 云管理的存储服务(云 SQL 和云存储)中。

- 您可以使用计算引擎默认服务帐户向 Google Cloud 进行身份验证。但是,如果需要工作负载权限分离,则此方法可能不适用。

- 您可以在公共和私有 GKE 集群上部署 AI 平台管道,只要集群有足够的资源用于 AI 平台管道。

具体功能说明:

部署后,Kubernetes 集群仅包含 Kubeflow Pipelines。它不包括其他 Kubeflow 组件。例如,要使用 Jupyter 笔记本,可以使用 AI 平台笔记本。

Kubeflow Pipelines 多用户支持在 AI 平台 Pipelines 中不可用,因为多用户支持依赖于其他 Kubeflow 组件。

# 3.3.1.4.1.2.本地部署

Kubeflow 管道(种类、K3s、K3ai)的当地部署信息。本指南介绍了如何使用以下方法在本地 Kubernetes 集群上独立部署 Kubeflow Pipelines:

- kind

- K3 秒

- Windows Linux 子系统(WSL)上的 K3s

- K3ai[α]

此类部署方法可以是本地环境的一部分,使用提供的 kustosize 清单进行测试。本指南是部署 Kubeflow 管道(KFP)^52 (opens new window)。

3.1.4.1.3.3.开始之前

您应该熟悉 Kubernetes^53 (opens new window)、kubectl^54 (opens new window)和 kustomize^55 (opens new window)。

对于 kustomize 的本地支持,您需要 kubectl v1.14 或更高版本。您可以按照 kubectl 安装指南下载并安装 kubectl。

3.1.4.1.3.4.KIND

1.安装种类

kind^56 (opens new window)是一个使用 Docker 容器节点运行本地 Kubernetes 集群的工具。该类型主要用于测试 Kubernetes 本身。它也可用于本地开发或 CI。

您可以按照官方的快速入门来安装和配置种类。

从 Kind 开始:

在 Linux 上:

通过运行以下命令下载可执行文件并将其移动到 PATH 中的目录中:

curl -Lo ./kind https://kind.sigs.k8s.io/dl/**{**KIND_VERSION**}**/kind-linux-amd64 (opens new window) && \

chmod +x ./kind && \

mv ./kind /{YOUR_KIND_DIRECTORY}/kind

替换以下内容:

{KIND_VERSION}:种类版本;例如,自本指南编写之日起,v0.8.1

{YOUR_KIND_DIRECTORY}:PATH 中的目录

在 macOS 上:

您可以使用 Homebrew^57 (opens new window)安装种类:

brew install kind

在 Windows 上:

您可以使用管理 PowerShell 控制台运行以下命令,以下载可执行文件并将其移动到 PATH 中的目录:

PowerShell:运行以下命令下载 kind 可执行文件并将其移动到 PATH 中的目录:

curl**.exe -Lo kind-windows-amd64.exe https://kind.sigs.k8s.io/dl/{KIND_VERSION}/**kind-windows-amd64

Move-Item **.\kind-windows-amd64.exe c:\{YOUR_KIND_DIRECTORY}\kind.**exe

替换以下内容:

- {KIND_VERSION}:种类版本-例如 v0.9(查看种类发布页面上的最新稳定二进制版本)

- {YOUR_KIND_DIRECTORY}:PATH 中的种类目录

- {KIND_VERSION}:种类版本;例如,自本指南编写之日起,v0.8.1

- {YOUR_KIND_DIRECTORY}:PATH 中的目录

或者,您可以使用 Chocolateyhttps://chocolatey.org/packages/kind: (opens new window)

choco install kind

2.基于实物创建集群

安装了 kind 之后,可以使用以下命令在 kind 上创建 Kubernetes 集群:

kind create cluster

这将使用预构建的节点映像引导 Kubernetes 集群。您可以在 Docker Hub kindest/node 上找到该图像。如果您希望自己构建节点映像,可以使用 kind-build-node image 命令。有关详细信息,请参阅官方的构建映像部分。要指定另一个图像,请使用--image 标志。

默认情况下,集群将被命名为 kind。使用--name 标志为集群分配不同的上下文名称。

K3

1.在 K3s 上设置集群

K3s 是完全兼容的 Kubernetes 发行版,具有以下增强功能:

- 打包为单个二进制文件。

- 基于 sqlite3 作为默认存储机制的轻量级存储后端。etcd3、MySQL、Postgres 仍然可用。

- 包装在简单的启动器中,可以处理 TLS 和选项的许多复杂性。

- 对于轻量级环境,默认情况下使用合理的默认值确保安全。

- 添加了简单但功能强大的“电池内置”功能,例如:本地存储提供商、服务负载平衡器、Helm 控制器和 Traefik 入口控制器。

- 所有 Kubernetes 控制平面组件的操作都封装在一个二进制和进程中。这允许 K3 自动化和管理复杂的集群操作,如分发证书。

- 外部依赖性已经最小化(只需要一个现代内核和 cgroup 挂载)。K3s 包需要依赖项,包括:

- 集装箱 containerd

- Flannel

- Core DNS

- CNI

- 主机实用程序(iptables、socat 等)

- 入口控制器(traefik)

- 嵌入式服务负载平衡器

- 嵌入式网络策略控制器

您可以在 K3s 官方网站上找到官方 K3s 安装脚本,将其作为服务安装在基于 systemd 或 openrc 的系统上。要使用该方法安装 K3,请运行以下命令:

curl -sfL https://get.k3s.io (opens new window) | sh -

2.在 K3s 上创建集群

- 要在 K3s 上创建 Kubernetes 集群,请使用以下命令:

sudo k3s server &

这将引导 Kubernetes 集群 kubeconfig 写入/etc/rancher/k3s/k3s.yaml。

- (可选)检查群集:

sudo k3s kubectl get node

K3s 将流行的 kubectl 命令直接嵌入到二进制文件中,因此您可以立即通过它与集群交互。

- (可选)在其他节点上运行以下命令。NODE_TOKEN 来自服务器上的/var/lib/rrancher/k3s/server/NODE TOKEN:

- sudo k3s agent --server https://myserver:6443 (opens new window) --token {YOUR_NODE_TOKEN}

Windows Linux 子系统(WSL)上的 K3s

1.在 Windows Subsystem for Linux(WSL)上的 K3s 上设置群集

Windows Subsystem for Linux(WSL)允许开发人员在 GNU/Linux 环境中运行,包括大多数命令行工具、实用程序和应用程序-直接在 Windows 上运行,无需修改,而无需传统虚拟机或 dualbot 设置的开销。

安装 WSL 的完整说明可以在 Windows 官方网站上找到。

以下步骤总结了在 WSL 上设置 WSL 和 K3 所需的内容。

- 按照官方文档安装[WSL]。

- 根据官方说明,更新 WSL 并下载您的首选分发:

- SUSE Linux Enterprise Server 15 SP1

- openSUSE Leap 15.2

- Ubuntu 18.04 LTS

- Debian GNU/Linux

参考:WSL 上的 K3s:快速入门指南^58 (opens new window)

2.在 WSL 上的 K3s 上创建集群

以下是在 WSL 中的 K3s 上创建集群的步骤

要在 WSL 上的 K3s 上创建 Kubernetes 集群,请运行以下命令:

sudo ./k3s server

这将引导 Kubernetes 集群,但您将无法从 Windows 计算机访问集群本身。

注意:您不能使用 curl 脚本安装 K3,因为 WSL 中没有监控器(systemd 或 openrc)。

从下载 K3s 二进制文件https://github.com/rancher/k3s/releases/latest.然后,在下载K3s二进制文件的目录中,运行以下命令以向K3s二进制添加执行权限: (opens new window)

chmod +x k3s

3. 启动 K3s:

sudo ./k3s server

3.设置对 WSL 实例的访问

要设置对 WSL 实例的访问,请执行以下操作:

复制/etc/rancher/k3s/k3s。yaml 从 WSL 到$HOME/.kube/config。

通过更改服务器 URL 编辑复制的文件 https://localhost:6443 (opens new window) 到 WSL 实例的 IP(IP-addr show dev eth0)(例如,https://192.168.170.170:6443.) (opens new window)

在 Windows 终端中运行 kubectl。如果您没有安装 kubectl,请按照 Kubernetes 官方的 Windows 说明进行操作。

K3ai[α]

K3ai 是一种轻量级的“机箱中的基础设施”,专门用于在便携式硬件(如笔记本电脑和边缘设备)上安装和配置 AI 工具和平台。这使得用户能够在本地集群上使用 Kubeflow 进行快速实验。

K3ai 的主要目标是提供一种快速安装 Kubernetes(基于 K3s)和 Kubeflo Pipelines 的方法,支持 NVIDIA GPU 和 TensorFlow Serving。(对于 Kubeflow 和其他组件支持,请查看 K3ai 的网站以获取更新。)要使用 K3ai 安装 Kubeflow Pipelines,请运行以下命令:

仅支持 CPU:

curl -sfL https://get.k3ai.in (opens new window) | bash -s -- --cpu --plugin_kfpipelines

具有 GPU 支持:

curl -sfL https://get.k3ai.in (opens new window) | bash -s -- --gpu --plugin_kfpipelines

有关 K3ai 的更多信息,请参阅官方文档^59 (opens new window)。

部署 Kubeflow 管道

Kubeflo 管道的安装过程对于本指南中涵盖的所有三种环境都是相同的:kind、K3s 和 K3ai。

注意:进程命名空间共享(PNS)在 Argo 中尚未成熟-有关更多信息,请访问 Argo 执行器,并在使用 PNS 时可能遇到的任何问题中引用“PNS 执行器”。

1.要部署 KubeflowPipelines,请运行以下命令:

# env/platform-agnostic-pns hasn't been publically released, so you will install it from master

export PIPELINE_VERSION**=**1.8.5

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/cluster-scoped-resources?ref=$PIPELINE_VERSION"

kubectl wait --for condition**=established --timeout=**60s crd/applications.app.k8s.io

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/platform-agnostic-pns?ref=$PIPELINE_VERSION"

KubeflowPipelines 的部署可能需要几分钟才能完成。

2.验证端口转发是否可以访问 Kubeflow Pipelines UI:

kubectl port-forward -n kubeflow svc/ml-pipeline-ui 8080:80

然后,在 http://localhost:8080/或者-如果您在虚拟机中使用种类或 (opens new window) K3-http://{YOUR_VM_IP_ADDRESS}:8080/ (opens new window)

请注意,K3ai 将在安装过程结束时自动打印 web UI 的 URL。

注意:kubectl apply-k 接受本地路径和格式化为 hashicorp/go-getter URL 的路径。虽然前面命令中的路径看起来像 URL,但它们不是有效的 URL。

卸载 Kubeflow 管道

以下是在 K3s 或 K3ai 上的移除 Kubeflow 管道的步骤:

- 要使用清单文件卸载 Kubeflow Pipelines,请运行以下命令,将{your_manifest_file}替换为清单文件的名称:

kubectl delete -k {YOUR_MANIFEST_FILE}`

- 要使用 KubeflowPipelines 的 GitHub 存储库中的清单卸载 KubeflowPipelines,请运行以下命令:

export PIPELINE_VERSION**=**1.8.5

kubectl delete -k "github.com/kubeflow/pipelines/manifests/kustomize/env/platform-agnostic-pns?ref=$PIPELINE_VERSION"

kubectl delete -k "github.com/kubeflow/pipelines/manifests/kustomize/cluster-scoped-resources?ref=$PIPELINE_VERSION"

- 要使用本地存储库或文件系统中的清单卸载 Kubeflow Pipelines,请运行以下命令:

kubectl delete -k manifests/kustomize/env/platform-agnostic-pns

kubectl delete -k manifests/kustomize/cluster-scoped-resources

# 3.3.1.4.1.3.独立部署

关于 Kubeflow 管道独立部署的信息

作为部署 Kubeflow Pipelines(KFP)作为 Kubeflow 部署的一部分的替代方案,您还可以选择只部署 Kubeflow Pipelines。按照以下说明使用提供的 kustosize 清单独立部署 Kubeflow Pipelines。

您应该熟悉 Kubernetes、kubectl 和 kustomize。

Kubeflow Pipelines 单机版的安装选项

本指南目前介绍了如何在谷歌云平台(GCP)上独立安装 Kubeflow Pipelines。您还可以在其他平台上独立安装 Kubeflow Pipelines。本指南需要更新。见问题 1253。

3.3.1.4.1.3.1.开始之前

使用 Kubeflow Pipelines Standalone 需要 Kubernetes 集群以及 kubectl 安装。

下载并安装 kubectl

按照 kubectl 安装指南下载并安装 kubectl^60 (opens new window)。

您需要 kubectl 1.14 或更高版本才能支持 kustosize。

设置群集

如果您有一个现有的 Kubernetes 集群,请继续执行配置 kubectl 以与集群通信的说明^61 (opens new window)。

请参阅 GKE 指南,了解如何为 Google 云平台(GCP)创建集群^62 (opens new window)。

使用 gcloud container clusters create^63 (opens new window)命令创建一个可以运行所有 Kubeflow Pipelines 示例的集群:

# The following parameters can be customized based on your needs.

CLUSTER_NAME="kubeflow-pipelines-standalone"

ZONE="us-central1-a"

MACHINE_TYPE="e2-standard-2" # A machine with 2 CPUs and 8GB memory.

SCOPES="cloud-platform" # This scope is needed for running some pipeline samples. Read the warning below for its security implication

gcloud container clusters create $CLUSTER_NAME \

--zone $ZONE \

--machine-type $MACHINE_TYPE \

--scopes $SCOPES

注意:e2-standard-2 不支持 GPU。您可以参考云机器系列中的指南来选择满足您需求的机器类型^64 (opens new window)。

警告:使用 SCOPES="cloud-platform"授予集群所有 GCP 权限。有关更安全的群集设置,请参阅向 GCP 验证管道^65 (opens new window)。

注意,一些遗留的管道示例可能需要少量代码更改才能在 SCOPES="cloud-platform"的集群上运行,请参阅编写管道以使用默认服务帐户^66 (opens new window)。

参考文献:

- GCP 区域和区域文件^67 (opens new window)

- gcloud 命令行工具指南^68 (opens new window)

- gcloud 命令参考^69 (opens new window)

配置 kubectl 以与集群通信

请参阅 Google Kubernetes Engine(GKE)指南,以配置 kubectl 的集群访问^70 (opens new window)。

3.3.1.4.1.3.2.部署 Kubeflow 管道

- 部署 Kubeflow 管道:

export PIPELINE_VERSION=1.8.5

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/cluster-scoped-resources?ref=$PIPELINE_VERSION"

kubectl wait --for condition=established --timeout=60s crd/applications.app.k8s.io

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=$PIPELINE_VERSION"

Kubeflow Pipelines 部署大约需要 3 分钟才能完成。

注:以上命令适用于 Kubeflow Pipelines 0.4.0 及更高版本。

对于 Kubeflow Pipelines 版本 0.2.0~0.3.0,请使用:

export PIPELINE_VERSION=<kfp-version-between-0.2.0-and-0.3.0>

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/base/crds?ref=$PIPELINE_VERSION"

kubectl wait --for condition=established --timeout=60s crd/applications.app.k8s.io

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=$PIPELINE_VERSION"

对于 Kubeflow Pipelines 版本<0.2.0,请使用:

export PIPELINE_VERSION=<kfp-version-0.1.x>

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=$PIPELINE_VERSION"

注意:kubectl apply -k 接受本地路径和格式化为 hashicorp/go-getter URL 的路径。虽然前面命令中的路径看起来像 URL,但这些路径不是有效的 URL。

2. 获取 KubeflowPipelines UI 的公共 URL,并使用它访问 Kubeflowpipelines UI:

kubectl describe configmap inverse-proxy-config -n kubeflow | grep googleusercontent.com

3.3.1.4.1.3.3.升级 Kubeflow 管道

1.有关发布通知和中断更改,请参阅升级 Kubeflow 管道^71 (opens new window)。

2.查看 Kubeflow Pipelines GitHub^72 (opens new window)存储库以获取可用版本。

3.要升级到 Kubeflow Pipelines 0.4.0 或更高版本,请使用以下命令:

export PIPELINE_VERSION=<version-you-want-to-upgrade-to>

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/cluster-scoped-resources?ref=$PIPELINE_VERSION"

kubectl wait --for condition=established --timeout=60s crd/applications.app.k8s.io

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=$PIPELINE_VERSION"

要升级到 Kubeflow Pipelines 0.3.0 或更低版本^73 (opens new window),请使用部署说明升级 Kubeflow pipelines 集群。

4.手动删除过时的资源。

根据您要升级的版本和您要升级到的版本,某些 Kubeflow Pipelines 资源可能已过时。

如果要从 Kubeflow Pipelines<0.4.0 升级到 0.4.0 或更高版本,则可以在升级后删除以下过时资源:元数据部署、元数据服务。

运行以下命令以检查群集上是否存在这些资源:

kubectl -n <KFP_NAMESPACE> get deployments | grep metadata-deployment

kubectl -n <KFP_NAMESPACE> get service | grep metadata-service

如果集群上存在这些资源,请运行以下命令删除它们:

kubectl -n <KFP_NAMESPACE> delete deployment metadata-deployment

kubectl -n <KFP_NAMESPACE> delete service metadata-service

对于其他版本,您无需执行任何操作。

3.3.1.4.1.3.4.自定义 Kubeflow 管道

Kubeflow 管道可通过 kustomize 覆盖层进行配置。

首先,首先克隆 Kubeflow Pipelines GitHub 存储库,并将其用作工作目录。

使用云 SQL 和 Google 云存储在 GCP 上部署

注意:建议用于生产环境。有关为 GCP 定制环境的更多详细信息,请参阅 Kubeflow Pipelines GCP 清单^74 (opens new window)。

更改部署命名空间

要在命名空间< my namespace >中独立部署 Kubeflow Pipelines,请执行以下操作:

1.在 dev/kustomization 中将 namespace 字段设置为< my namespace >。yaml 或 gcp/kustomization.yaml。

2.在集群范围的 resources/kustomization.yaml 中,将 namespace 字段设置为<my namespace>

应用更改以更新 KubeflowPipelines 部署:

kubectl apply -k manifests/kustomize/cluster-scoped-resources

kubectl apply -k manifests/kustomize/env/dev

注意:如果使用 GCP Cloud SQL 和 Google Cloud Storage,请在 manifest/kustomize/env/GCP/params.env 中设置正确的值。然后使用以下命令应用:

kubectl apply -k manifests/kustomize/cluster-scoped-resources

kubectl apply -k manifests/kustomize/env/gcp

禁用公共终结点

默认情况下,KFP 独立部署安装一个公开公共 URL 的反向代理。如果要跳过反向代理的安装,请完成以下操作:

1.注释出基础 kustomization.yaml 中的代理组件。例如 manifest/kustomize/env/dev/kustomization。yaml 注释掉 inverse-proxy。

2.应用更改以更新 Kubeflow Pipelines 部署:

kubectl apply -k manifests/kustomize/env/dev

注意:如果使用 GCP Cloud SQL 和 Google Cloud Storage,请在 manifest/kustomize/env/GCP/params.env 中设置正确的值。然后使用以下命令应用:

kubectl apply -k manifests/kustomize/env/gcp

3.验证端口转发是否可以访问 Kubeflow Pipelines UI:

kubectl port-forward -n kubeflow svc/ml-pipeline-ui 8080:80

4.打开 Kubeflow Pipelines UIhttp://localhost:8080/ (opens new window)

3.3.1.4.1.3.5.卸载 Kubeflow 管道

要卸载 Kubeflow Pipelines,请运行kubectl delete-k < manifest file >。

例如,要使用 GitHub 存储库中的清单卸载 KFP,请运行:

export PIPELINE_VERSION=1.8.5

kubectl delete -k "github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=$PIPELINE_VERSION"

kubectl delete -k "github.com/kubeflow/pipelines/manifests/kustomize/cluster-scoped-resources?ref=$PIPELINE_VERSION"

要使用本地存储库或文件系统中的清单卸载 KFP,请运行:

kubectl delete -k manifests/kustomize/env/dev

kubectl delete -k manifests/kustomize/cluster-scoped-resources

**注意:**如果您正在使用 GCP Cloud SQL 和 Google Cloud Storage,请运行:

kubectl delete -k manifests/kustomize/env/gcp

kubectl delete -k manifests/kustomize/cluster-scoped-resources

3.3.1.4.1.3.6.维护清单的最佳实践

与源代码类似,配置文件属于源代码控制。存储库管理对清单文件的更改,并确保您可以重复部署、升级和卸载组件。

在源代码管理中维护清单

创建或自定义部署清单后,将清单保存到本地或远程源代码管理存储库。例如,保存以下 kustomization.yaml:

# kustomization.yaml

apiVersion: kustomize.config.k8s.io/v1beta1

kind: Kustomization

# Edit the following to change the deployment to your custom namespace.

namespace: kubeflow

# You can add other customizations here using kustomize.

# Edit ref in the following link to deploy a different version of Kubeflow Pipelines.

bases:

- github.com/kubeflow/pipelines/manifests/kustomize/env/dev?ref=1.8.5

3.3.1.4.1.3.6.故障排除

如果您的管道卡在 ContainerCreating 状态,并且它有 pod 事件,如:

MountVolume.SetUp failed for volume "gcp-credentials-user-gcp-sa" : secret "user-gcp-sa" not found

您应该删除 use_gcp_secret 用法,如“向 gcp 验证管道”中所述^75 (opens new window)。

# 3.3.1.4.1.4.选择 Argo 工作流执行器

如何选择 Argo 工作流执行器

Argo 工作流执行器是一个符合特定接口的过程,该接口允许 Argo 执行某些操作,如监视 pod 日志、收集工件、管理容器生命周期等。

Kubeflow Pipelines 作为工作流引擎运行在 Argo Workflows^76 (opens new window)上,因此 KubeflowPipelines 用户需要选择工作流执行器。

3.3.1.4.1.4.1.选择工作流执行器

一些用户可能看重稳定性和向后兼容性。例如,如果您正在生产集群中运行 KubeflowPipelines,或者您维护的生产管道不希望中断或迁移。

在这种情况下,我们建议您使用 docker 执行器,并将 Kubernetes 节点配置为使用 docker 容器运行时。

然而,Kubernetes 反对将 docker 作为容器运行时,因此我们建议开始尝试使用 emissiary,并在其稳定时为迁移做好准备。

对于不太关心稳定性和向后兼容性的用户,我们建议尝试新的使者执行器。

注意,Argo 工作流支持其他工作流执行器,但 Kubeflow Pipelines 团队只建议在 docker 执行器和使者执行器之间进行选择。

Docker 执行器

Docker 执行器是默认的工作流执行器。但 Kubeflow Pipelines v1.8 将切换到 Emissary Executor 作为默认执行器。

- 容器运行时:仅 docker。然而,Kubernetes 在 v1.20 之后反对 Docker 作为容器运行时。在 Google Kubernetes Engine(GKE)1.19+上,容器运行时已经默认为 containerd。

- 可靠性:测试最充分、最流行的 argo 工作流执行器

- 安全性:最不安全

- 它需要对要装载的主机的 docker.sock 进行特权访问。通常被开放政策代理(OPA)或您的 Pod 安全政策(PSP)拒绝。GKE 自动驾驶模式也拒绝它,因为没有特权吊舱。

- 它可以逃脱 pod 服务帐户的特权。

为 Docker Executor 准备 GKE 集群

对于 GKE,节点映像决定使用哪个容器运行时。要使用 docker 容器运行时,需要使用 docker 指定节点映像。

必须使用以下节点映像之一:

- 容器优化操作系统与 Docker(cos)

- Ubuntu 与 Docker(Ubuntu)

如果您的节点没有将 docker 用作容器运行时,那么当您运行管道时,总会发现错误消息,如:

此步骤处于错误状态,并显示以下消息:未能保存输出:后台进程的错误响应:没有这样的容器:XXXXXX

代理执行器

特使执行器是一个新的工作流执行器。它首次发布于 Argo Workflows v3.1(2021 6 月)。然而,Kubeflow Pipelines 团队认为,其架构和可移植性的改进可以使其成为大多数人将来应该使用的默认执行器。

因此,团队承诺积极收集反馈并为特使执行者修复 bug,以便我们更快地稳定它。在代理执行器 github 问题中提交您的反馈^77 (opens new window)。

- 到目前为止,Kubeflow Pipelines 测试基础设施在特使执行者的支持下一直稳定运行。

- 容器运行时:任意

- 可靠性:尚未经过良好测试,也尚未普及,但 Kubeflow Pipelines 团队对此表示支持。

- 安全性:更安全

- 无特权访问。

- 无法逃脱 pod 服务帐户的特权。

- 迁移:命令必须在 Kubeflow Pipelines 组件规范中指定。

注意,Kubeflow Pipelines v2 兼容模式需要相同的迁移要求,请参阅已知的警告和突破性更改。

迁移到代理执行器

前提条件:代理执行器仅在 Kubeflow Pipelines 后端版本 1.7+中可用。若要升级,请参阅升级 Kubeflow Pipelines。

配置现有的 KubeflowPipelines 集群以使用特使执行器

1.安装 kubectl^78 (opens new window)。

2.通过 kubectl 连接到集群。

3.切换到安装了 Kubeflow Pipelines 的命名空间:

kubectl config set-context --current --namespace <your-kfp-namespace>

注意,通常是 Kubeflow 或默认值。

4.确认当前工作流执行者:

kubectl describe configmap workflow-controller-configmap | grep -A 2 containerRuntimeExecutor

使用 docker 执行器时,您将看到如下输出:

containerRuntimeExecutor:

----

docker

5.将工作流执行器配置为特使:

kubectl patch configmap workflow-controller-configmap --patch '{"data":{"containerRuntimeExecutor":"emissary"}}'

6.确认工作流执行器已成功更改:

kubectl describe configmap workflow-controller-configmap | grep -A 2 containerRuntimeExecutor

您将看到如下输出:

containerRuntimeExecutor:

----

emissary

使用特使执行器部署一个新的 Kubeflow Pipelines 集群

对于 AI 平台管道,请在安装期间选中“使用特使执行器”复选框。

对于 Kubeflow Pipelines Standalone,安装 env/平台不可知使者:

kubectl apply -k "github.com/kubeflow/pipelines/manifests/kustomize/env/platform-agnostic-emissary?ref=$PIPELINE_VERSION"

如果有疑问,您可以先部署 Kubeflow Pipelines 集群,并在安装后使用现有集群的说明配置工作流执行器。

迁移管道组件以在委托执行器上运行

某些管道组件需要手动更新才能在授权执行器上运行。对于 Kubeflow Pipelines 组件规范 YAML,必须指定命令字段。

分步组件迁移教程:

- 有一个 hello world 组件:

name: hello-world

implementation:

container:

image: hello-world

2.我们可以在没有命令/args 的情况下运行容器:

\$ docker run hello-world

Hello from Docker!

...

3 查找图像中的默认 ENTRYPOINT 和 CMD:

\$ docker image inspect -f '{{\.Config.Entrypoint}} {{\.Config.Cmd}}' hello-world

[] [/hello]

因此未指定 ENTRYPOINT,CMD 为[“/hello”]。注意,ENTRYPOINT 大致表示命令,CMD 大致表示参数。命令和参数被连接为用户命令。

4.更新组件 YAML:

name: hello-world

implementation:

container:

image: hello-world

command: ["/hello"]

5. 更新的组件现在可以在使者执行器上运行。

注意:Kubeflow Pipelines SDK 编译器总是为基于 python 函数的组件指定一个命令。因此,这些组件将继续在使者执行器上工作,无需修改。

# 3.3.1.4.1.5.兼容性矩阵

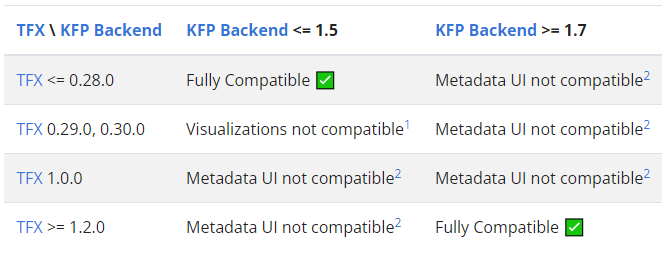

Kubeflow Pipelines 与 TensorFlow Extended(TFX)的兼容性矩阵

Kubeflow Pipelines 后端和 TFX 兼容性

在 TensorFlow Extended(TFX)的任何版本中编写的管道都将在 Kubeflow Pipelines(KFP)后端的任何版本上执行。但是,如果 TFX 和 Kubeflow Pipelines 后端版本不兼容,某些 UI 功能可能无法正常运行。

下表显示了 TFX 和 Kubeflow Pipelines 后端版本的 UI 功能兼容性:

详细说明:

1.可视化不兼容:Kubeflow Pipelines UI 和 TFDV、TFMA 可视化不兼容。可视化在 Kubeflow Pipelines UI 中引发错误。

2.元数据 UI 不兼容:Kubeflow Pipelines UI 和 TFX 记录的 ML 元数据不兼容。运行详细信息页面中的 ML 元数据选项卡显示错误消息“未找到对应的 ML 元数据”。因此,基于 ML 元数据的可视化也不会显示在可视化选项卡中。

# 3.3.1.5.Pipelines SDK

# 3.3.1.5.1.Pipelines SDK 简介

使用 SDK 构建组件和管道概述

Kubeflow 组件状态稳定。请参阅 Kubeflow 版本控制策略。

Kubeflow Pipelines SDK 提供了一组 Python 包,您可以使用这些包来指定和运行机器学习(ML)工作流。管道是对 ML 工作流的描述,包括组成工作流步骤的所有组件以及组件之间的交互方式。

注意:这里的 SDK 文档是指默认的 Kubeflow Pipelines with Argo^79 (opens new window)。如果您使用 Tekton 运行 Kubeflow Pipelines^80 (opens new window),请遵循 Kubeflow Pipelines SDK for Tekton^81 (opens new window)文档。

3.3.1.5.1.1.SDK 包

Kubeflow Pipelines SDK 包括以下包:

- Kfp.compiler 包含用于将管道 Python DSL 编译为工作流 yaml 规范的类和方法。此包中的方法包括但不限于以下内容:

- kfpcompiler.compiler.compile 将 Python DSL 代码编译为一个静态配置(YAML 格式),Kubeflow Pipelines 服务可以处理该配置。Kubeflow Pipelines 服务将静态配置转换为一组 Kubernetes 资源以供执行。

- kfp.components 包括用于与管道组件交互的类和方法。本包中的方法包括但不限于以下内容:

- kfp.components.func_to_container_op 将 Python 函数转换为管道组件并返回工厂函数。然后可以调用工厂函数来构造管道任务(ContainerOp)的实例,该任务在容器中运行原始函数。

- kfp.components.load_component_from_file 从文件加载管道组件并返回工厂函数。然后,您可以调用工厂函数来构造运行组件容器映像的管道任务(ContainerOp)的实例。

- kfp.components.load_component_from_url 从 url 加载管道组件并返回工厂函数。然后,您可以调用工厂函数来构造运行组件容器映像的管道任务(ContainerOp)的实例。

- kfp.dsl 包含域特定语言(dsl),您可以使用它来定义管道和组件并与之交互。此包中的方法、类和模块包括但不限于以下内容:

- kfp.dls.PipelineParam 表示可以从一个管道组件传递到另一个管道的管道参数。请参见管道参数指南。

- kfp.dls.component 是 dsl 函数的装饰器,它返回一个管道组件。(集装箱操作)。

- kfp.dsl.pipeline 是 Python 函数的装饰器,它返回一个管道。

- kfp.dsl.python_component 是 python 函数的装饰器,它将管道组件元数据添加到函数对象中。

- kfp.dls.types 包含 Kubeflow Pipelines SDK 定义的类型列表。类型包括基本类型,如 String、Integer、Float 和 Bool,以及特定于域的类型,如 GCPProjectID 和 GCRPath。请参阅 DSL 静态类型检查指南。

- kfp.ds.ResourceOp 表示一个管道任务(op),它允许您直接操作 Kubernetes 资源(创建、获取、应用…)。

- kfp.dls.VolumeOp 表示创建新的 Persistent Volume Claim(PVC)的管道任务(op)。它的目的是使创建 Persistent Volume Claim 的常见情况变得更快。

- kfp.ds.VolumeSnapshotOp 表示创建新 Volume Snapshot 的管道任务(op)。它旨在使创建 Volume Snapshot 的常见情况变得快速。

- kfp.dds.PipelineVolume 表示用于在管道步骤之间传递数据的卷。ContainerOps 可以通过构造函数的参数 pvolumes 或 add_pvolumes()方法装载 PipelineVolume。

- kfp.ds.ParallelFor 表示管道中静态或动态项集上的并行 for 循环。for 循环的每个迭代都是并行执行的。

- kfp.dsl.ExitHandler 表示退出管道时调用的退出处理程序。ExitHandler 的典型用法是垃圾收集。

- kfp.ddsl.Condition 表示一组操作,只有在满足特定条件时才会执行。需要在运行时通过在布尔表达式中至少包含一个任务输出或 Pipeline Param 来确定指定的条件。

- kfp.Client 包含 Kubeflow Pipelines API 的 Python 客户端库。本包中的方法包括但不限于以下内容:

- kfp.Client.create_experiment 创建一个管道实验并返回一个实验对象。

- kfp.Client.run_pipeline 运行管道并返回运行对象。

- kfp.Client.create_run_from_pipeline_func 编译一个管道函数,并将其提交给 Kubeflow Pipelines 执行。

- kfp.Client.create_run_from_pipeline_package 在 Kubeflow Pipelines 上运行本地管道包。

- kfp.Client.upload_pipeline 上载一个本地文件,以在 Kubeflow Pipelines 中创建一个新管道。

- kfp.Client.upload_pipeline_version 上载本地文件以创建管道版本。通过示例了解有关创建管道版本的更多信息。

- Kubeflow Pipelines 扩展模块^82 (opens new window)包括用于特定平台的类和函数,您可以在这些平台上使用 Kubeflow Pipelines。示例包括本地、Google 云平台(GCP)、Amazon Web Services(AWS)和 Microsoft Azure 的实用程序功能。

- Kubeflow Pipelines diagnose_me 模块^83 (opens new window)包括帮助执行环境诊断任务的类和函数。

- kfp.li.diagnos_me.dev_env 报告开发环境中的诊断元数据,例如 python 库版本。

- kfp.li.diagnose_me.kubenetes_cluster 报告来自 kubernetes 集群的诊断数据,例如 Kubernetes secrets。

- kfp.li.diagnose_me.gcp 报告与 gcp 环境相关的诊断数据。

3.3.1.5.1.2.Kubeflow Pipelines CLI 工具

Kubeflow Pipelines CLI 工具使您能够直接从命令行使用 Kubeflow Pipelines SDK 的一个子集。Kubeflow Pipelines CLI 工具提供以下命令:

kfp diagnose_me 使用指定的参数运行环境诊断。

- --json -表示此命令必须以 json 形式返回结果。否则,结果将以可读格式返回。

- --namespace TEXT-指定要使用的 Kubernetes 命名空间。所有名称空间都是默认值。

- --project-id TEXT-对于 GCP 部署,此值指定要使用的 GCP 项目。如果未指定此值,则使用环境默认值。

kfp pipeline <COMMAND>提供以下命令来帮助您管理管道。

- get -从 Kubeflow Pipelines 集群获取有关 Kubeflow pipeline 的详细信息。

- list -列出已上载到 Kubeflow Pipelines 集群的管道。

- upload -将管道上传到 Kubeflow Pipelines 集群。

kfp run <COMMAND>提供以下命令来帮助您管理管道运行。

- get -显示管道运行的详细信息。

- list -列出最近的管道运行。

- submit -提交管道运行。

kfp--endpoint<endpoint>-指定 Kubeflow Pipelines CLI 应连接到的端点。

3.3.1.5.1.3.安装开发工具包

遵循安装 Kubeflow Pipelines SDK 的指南^84 (opens new window)。

3.3.1.5.1.4.建筑管道和组件

本节总结了使用 SDK 构建管道和组件的方法。

Kubeflow 管道是 ML 工作流的可移植和可扩展的定义。ML 工作流中的每个步骤,例如准备数据或训练模型,都是管道组件的实例。

了解有关构建管道的更多信息^85 (opens new window)。

管道组件是一组自包含的代码,在 ML 工作流中执行一个步骤。组件在组件规范中定义,该规范定义了以下内容:

- 组件的接口、输入和输出。

- 组件的实现、容器映像和要执行的命令。

- 组件的元数据,例如组件的名称和描述。

使用以下选项创建或重用管道组件。

- 您可以通过为容器化应用程序定义组件规范来构建组件。了解有关构建管道组件的详细信息^86 (opens new window)。

- 基于 Python 函数的轻量级组件通过使用 Kubeflow Pipelines SDK 生成 Python 函数的组件规范,可以更容易地构建组件。了解如何构建基于 Python 函数的组件。

- 您可以在管道中重用预构建的组件。了解有关重用预构建组件的更多信息。

3.3.1.5.1.5.安装 Kubeflow Pipelines SDK

设置 Kubeflow Pipelines 开发环境

本指南告诉您如何安装 Kubeflow Pipelines SDK^87 (opens new window),您可以使用它来构建机器学习管道。您可以使用 SDK 来执行管道,也可以将管道上传到 Kubeflow Pipelines UI 以执行。

自动生成的 SDK 参考文档中描述了 SDK 的所有类和方法^88 (opens new window)。

注意:如果您使用 Tekton 运行 Kubeflow Pipelines,而不是使用 Argo 运行默认的 Kubeflow Pipelines,则应使用 Tekton 的 Kubeflow Pipelines SDK。

设置 Python

您需要 Python 3.5 或更高版本才能使用 Kubeflow Pipelines SDK。本指南使用 Python 3.7。

如果您还没有设置 Python3 环境,请立即设置。本指南推荐 Miniconda,但您可以使用自己选择的虚拟环境管理器,例如virtualenv。

按照以下步骤使用 Miniconda 设置 Python:

1.根据您的环境,选择以下方法之一安装 Miniconda:

- Debian/Uubuntu/Cloud Shell:

apt-get update**;** apt-get install -y wget bzip2

wget https://repo.continuum.io/miniconda/Miniconda3-latest-Linux-x86_64.sh (opens new window)

bash Miniconda3-latest-Linux-x86_64.sh

- Windows:下载安装程序,并确保在安装过程中选择了将 Miniconda 添加到 PATH 环境变量的选项。

- MacOS:下载安装程序并运行以下命令:

bash Miniconda3-latest-MacOSX-x86_64.sh

- 检查 conda 命令是否可用:

which conda

如果找不到 conda 命令,请将 Miniconda 添加到路径中:

export PATH**=**<YOUR_MINICONDA_PATH>/bin:$PATH

3.使用您选择的名称创建一个干净的 Python 3 环境。此示例使用 Python 3.7 和环境名 mlpipeline。:

conda create --name mlpipeline python**=**3.7

conda activate mlpipeline

安装 Kubeflow Pipelines SDK

运行以下命令以安装 Kubeflow Pipelines SDK:

pip3 install kfp --upgrade

注意:如果在安装 Kubeflow Pipelines SDK 时未使用虚拟环境(如 conda),则可能会收到以下错误:

ERROR: Could not install packages due to an EnvironmentError: [Errno 13] Permission denied: '/usr/local/lib/python3.5/dist-packages/kfp-<version>.dist-info'

Consider using the `--user` option or check the permissions.

如果出现此错误,请使用--user 选项安装 kfp:

pip3 install kfp --upgrade --user

该命令将 dsl compile 和 kfp 二进制文件安装在~/.local/bin 下,这在某些 Linux 发行版(如 Ubuntu)中不是 PATH 的一部分。您可以将~/.local/bin 添加到 PATH 中,方法是在.bashrc 文件末尾的新行中附加以下内容:

export PATH**=**$PATH:~/.local/bin

成功安装后,命令 dsl compile 应该可用。您可以使用此命令验证它:

which dsl-compile

答案应该是这样的:

pip3 install kfp --upgrade --user

该命令将 dsl compile 和 kfp 二进制文件安装在~/.local/bin 下,这在某些 Linux 发行版(如 Ubuntu)中不是 PATH 的一部分。您可以将~/.local/bin 添加到 PATH 中,方法是在.bashrc 文件末尾的新行中附加以下内容:

export PATH**=**$PATH:~/.local/bin

成功安装后,命令 dsl compile 应该可用。您可以使用此命令验证它:

which dsl-compile

答案应该是这样的:

/<PATH_TO_YOUR_USER_BIN>/miniconda3/envs/mlpipeline/bin/dsl-compile

3.3.1.5.1.6.将 Pipelines SDK 连接到 Kubeflow Pipelines

如何以各种方式将 Pipelines SDK 连接到 Kubeflow Pipelines

如何将 Pipelines SDK 连接到 Kubeflow Pipelines 将取决于您的 Kubeflow 部署类型以及从何处运行代码。

- 完全 Kubeflow(来自集群内部)^89 (opens new window)

- 完全 Kubeflow(来自集群外部)^90 (opens new window)

- 独立的 Kubeflow 管道(来自集群内部)^91 (opens new window)

- 独立 Kubeflow 管道(来自集群外部)^92 (opens new window)

3.3.1.5.1.7.构建管道(Pipeline)

关于构建管道以协调 ML 工作流的教程

在 Google Colab 中运行

在 GitHub 上查看源代码

Kubeflow 管道是机器学习(ML)工作流的可移植和可扩展的定义。ML 工作流中的每个步骤,例如准备数据或训练模型,都是管道组件的实例。本文档提供了管道概念和最佳实践的概述,以及描述如何构建 ML 管道的说明。

开始之前

1.运行以下命令以安装 Kubeflow Pipelines SDK。如果在 Jupyter 笔记本中运行此命令,请在安装 SDK 后重新启动内核。

$ pip install kfp **--**upgrade

2.导入 kfp 和 kfp.components 包。

import kfp

import kfp.components as comp

理解管道

Kubeflow 管道是基于容器的 ML 工作流的可移植和可扩展的定义。管道由一组输入参数和此工作流中的步骤列表组成。管道中的每个步骤都是一个组件的实例,该组件表示为 ContainerOp 的实例。

您可以使用管道:

- 协调可重复的 ML 工作流。

- 通过使用不同的超参数集运行工作流来加速实验。

了解管道组件

管道组件是一个容器化应用程序,它执行管道工作流中的一个步骤。管道组件在组件规范中定义,其中定义了以下内容:

- 组件的接口、输入和输出。

- 组件的实现、容器映像和要执行的命令。

- 组件的元数据,例如组件的名称和描述。

您可以通过为容器化应用程序定义组件规范来构建组件,也可以使用 Kubeflow Pipelines SDK 为 Python 函数生成组件规范。您还可以重用管道中的预构建组件。

了解管道图

管道的工作流中的每个步骤都是组件的实例。定义管道时,指定每个步骤的输入源。可以从管道的输入参数、常量或步骤输入中设置步骤输入。步骤输入可以取决于此管道中其他步骤的输出。Kubeflow Pipelines 使用这些依赖关系将管道的工作流定义为图形。

例如,考虑具有以下步骤的管道:接收数据、生成统计信息、预处理数据和训练模型。以下描述了每个步骤之间的数据依赖关系。

- **摄取数据:**此步骤从使用管道参数指定的外部源加载数据,并输出数据集。由于此步骤不依赖于任何其他步骤的输出,因此可以先运行此步骤。

- **生成统计信息:**此步骤使用摄取的数据集生成并输出一组统计信息。由于此步骤取决于摄取数据步骤生成的数据集,因此它必须在摄取数据步骤之后运行。

- **预处理数据:**此步骤对摄取的数据集进行预处理,并将数据转换为预处理的数据集。由于此步骤取决于摄取数据步骤生成的数据集,因此它必须在摄取数据步骤之后运行。

- **训练模型:**此步骤使用预处理的数据集、生成的统计数据和管道参数(如学习率)训练模型。由于此步骤依赖于预处理数据和生成的统计信息,因此它必须在预处理数据与生成统计信息步骤完成后运行。

由于生成统计数据和预处理数据步骤都依赖于摄取的数据,因此生成统计数据与预处理数据的步骤可以并行运行。一旦数据依赖性可用,则执行所有其他步骤。

设计您的管道

在设计管道时,请考虑如何将 ML 工作流拆分为管道组件。将 ML 工作流拆分为管道组件的过程类似于将单片脚本拆分为可测试函数的过程。以下规则可以帮助您定义构建管道所需的组件。

- 组件应具有单一责任。拥有一个单一的职责可以更容易地测试和重用组件。例如,如果您有一个加载数据的组件,则可以将其用于加载数据的类似任务。如果您有一个加载和转换数据集的组件,那么该组件可能不太有用,因为您只能在需要加载和转换该数据集时使用它。

- 尽可能重复使用组件。Kubeflow Pipelines 为常见的管道任务和访问云服务提供组件。

- 考虑调试管道所需的知识,并研究管道生成的模型的谱系。Kubeflow Pipelines 存储每个管道步骤的输入和输出。通过询问管道运行产生的工件,您可以更好地了解运行之间模型质量的变化,或者跟踪工作流中的错误。

通常,您应该在设计组件时考虑到可组合性。

管道由组件实例(也称为步骤)组成。步骤可以根据另一步骤的输出定义其输入。步骤之间的依赖关系定义了管道工作流图。

建筑管道组件

Kubeflow 管道组件是容器化的应用程序,在 ML 工作流中执行一个步骤。以下是定义管道组件的方法:

如果您有一个要用作管道组件的容器化应用程序,请创建一个组件规范,将此容器映像定义为管道组件。

该选项提供了在管道中包含任何语言编写的代码的灵活性,只要您可以将应用程序打包为容器映像即可。了解有关构建管道组件的详细信息^93 (opens new window)。

如果组件代码可以表示为 Python 函数,请评估组件是否可以构建为基于 Python 函数^94 (opens new window)的组件。Kubeflow Pipelines SDK 通过节省创建组件规范的工作量,使构建基于 Python 函数的轻量级组件变得更加容易。

尽可能重用预构建的组件^95 (opens new window),以节省构建自定义组件的工作量。

本指南中的示例演示了如何构建使用基于 Python 函数的组件并重用预构建组件的管道。

了解数据如何在组件之间传递

当 Kubeflow Pipelines 运行组件时,在 Kubernetes Pod 中启动容器映像,并将组件的输入作为命令行参数传入。组件完成后,组件的输出将作为文件返回。

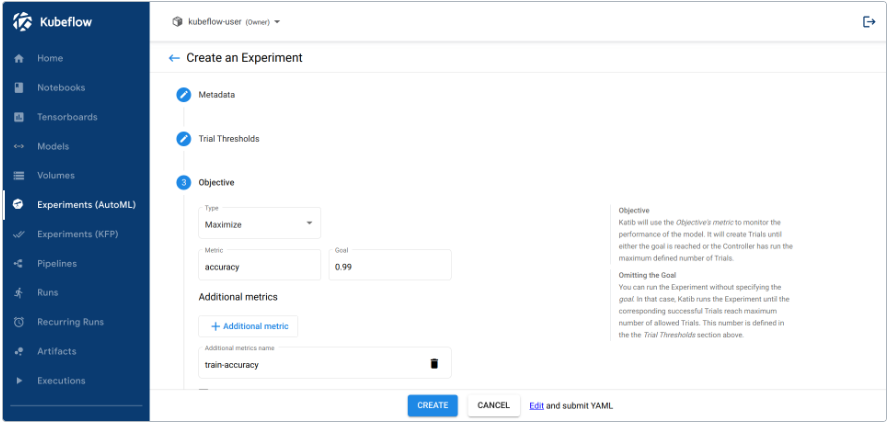

在组件的规范中,您定义了组件输入和输出,以及如何将输入和输出路径作为命令行参数传递给程序。您可以按值将小输入(如短字符串或数字)传递给组件。大型输入(如数据集)必须作为文件路径传递给组件。输出被写入 Kubeflow Pipelines 提供的路径。